La inteligencia artificial, o IA, ha irrumpido en nuestro mundo, transformando industrias y ofreciendo soluciones innovadoras a problemas que antes parecían insuperables. En el corazón de muchas de estas avanzadas capacidades se encuentran las redes neuronales artificiales, sistemas computacionales diseñados para aprender y adaptarse de manera continua, emulando la asombrosa complejidad del cerebro humano.

Estas redes no son una invención reciente; sus orígenes se remontan a mediados del siglo XX, cuando pioneros como Warren McCulloch y Walter Pitts sentaron las bases teóricas. Sin embargo, ha sido el auge de la capacidad de cómputo y la disponibilidad de enormes volúmenes de datos lo que ha permitido que las redes neuronales pasen de ser un concepto teórico a una herramienta práctica y poderosa que impulsa gran parte de la IA que vemos hoy.

- Definición y Origen: Un Vistazo al Pasado

- Estructura y Funcionamiento: Las Capas del Pensamiento Artificial

- El Proceso de Aprendizaje: Ajustando los Pesos

- Clasificación por Estructura: Diversidad Neuronal

- Aplicaciones Prácticas: Las Redes Neuronales en Nuestro Día a Día

- Tabla Comparativa: Tipos de Redes (Basado en Estructura)

- Preguntas Frecuentes sobre Redes Neuronales en IA

- ¿Cuál es la principal inspiración detrás de las redes neuronales artificiales?

- ¿Cómo aprenden las redes neuronales?

- ¿Qué papel juegan las funciones de activación?

- ¿Qué diferencia hay entre una red neuronal monocapa y una multicapa?

- ¿Para qué se utilizan principalmente las Redes Neuronales Convolucionales (CNN)?

- ¿Pueden las redes neuronales tener memoria?

- ¿Qué significa el término "peso" en una red neuronal?

Definición y Origen: Un Vistazo al Pasado

Las redes neuronales artificiales son, en esencia, modelos computacionales inspirados en la arquitectura y el funcionamiento de las redes neuronales biológicas presentes en el cerebro. Su propósito fundamental es procesar información, reconocer patrones y aprender de la experiencia, de una manera que recuerda cómo lo hacemos los seres humanos.

La idea de crear modelos artificiales que imitaran la función neuronal comenzó a tomar forma en la década de 1940. McCulloch y Pitts propusieron un modelo matemático simple para una neurona artificial, sentando las bases para lo que eventualmente se convertiría en el campo de las redes neuronales. Aunque los primeros modelos eran limitados, abrieron el camino para futuras investigaciones y desarrollos. Con el tiempo, surgieron nuevos modelos y algoritmos de aprendizaje, superando las limitaciones iniciales y dando lugar a las redes neuronales multicapa y los algoritmos de retropropagación que son fundamentales en la IA moderna.

Estructura y Funcionamiento: Las Capas del Pensamiento Artificial

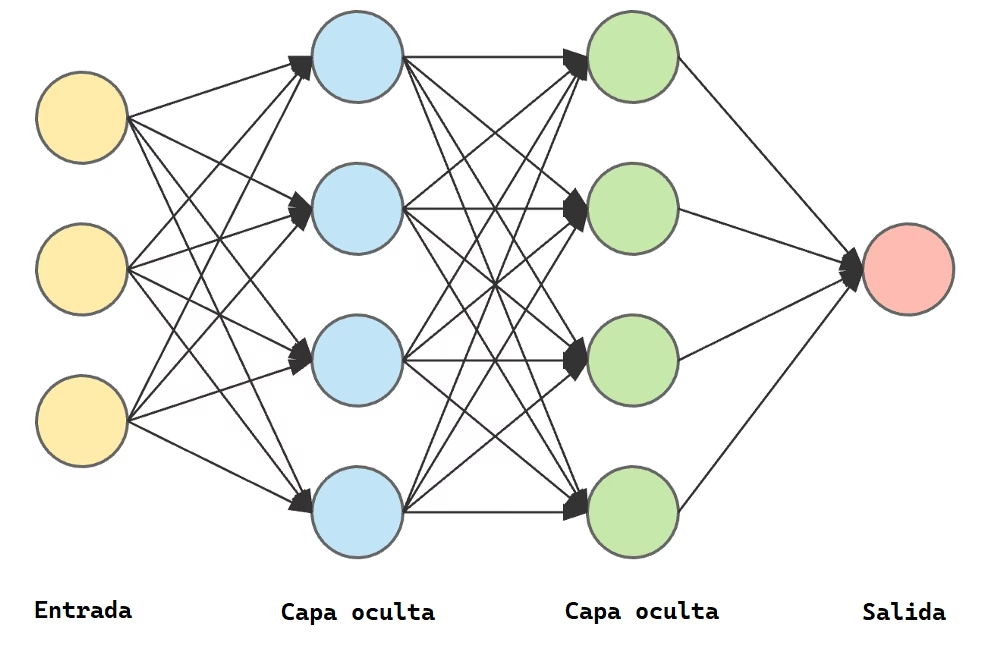

Una red neuronal artificial típica está organizada en capas interconectadas de neuronas o nodos. Cada neurona es una unidad de procesamiento básica que recibe entradas, realiza un cálculo simple y produce una salida. La forma en que estas neuronas están conectadas y procesan la información es lo que permite a la red aprender y realizar tareas complejas.

La estructura básica de una red neuronal se compone generalmente de tres tipos de capas:

- Capa de Entrada: Es la primera capa de la red y recibe los datos brutos del exterior. Estos datos pueden ser variados, desde píxeles de una imagen hasta palabras de un texto o valores numéricos. Las neuronas en esta capa no realizan un procesamiento complejo; simplemente actúan como conductos que transmiten la información a la siguiente capa.

- Capas Ocultas: Se encuentran entre la capa de entrada y la capa de salida. Una red puede tener una o varias capas ocultas, y cuantas más capas ocultas tenga (y más neuronas por capa), mayor será su capacidad para aprender patrones complejos, aunque también aumenta la complejidad computacional. En estas capas, las neuronas reciben señales de la capa anterior, aplican una función de activación y transmiten el resultado a la capa siguiente. Las funciones de activación son cruciales porque introducen no linealidades, permitiendo que la red modele relaciones no lineales en los datos.

- Capa de Salida: Es la última capa de la red y produce el resultado final del procesamiento. La naturaleza de la salida depende del problema que la red esté tratando de resolver. Por ejemplo, en un problema de clasificación de imágenes, la capa de salida podría indicar la probabilidad de que la imagen pertenezca a diferentes categorías. En un problema de regresión, podría producir un valor numérico continuo.

Cada conexión entre neuronas tiene asociado un peso, un valor numérico que determina la fuerza e influencia de esa conexión. Además, cada neurona suele tener un 'sesgo' (bias), que es otro valor numérico que se suma a la entrada ponderada antes de aplicar la función de activación. El aprendizaje en una red neuronal consiste esencialmente en ajustar estos pesos y sesgos para que la red produzca la salida deseada para un conjunto dado de entradas.

Funciones Clave de una Neurona Artificial

Dentro de cada neurona artificial, o nodo, se llevan a cabo varias operaciones fundamentales, gobernadas por funciones matemáticas:

- Función de Propagación: Esta función combina las entradas recibidas por la neurona con sus respectivos pesos y el sesgo. Típicamente, se calcula la suma ponderada de las entradas, a la que se le añade el sesgo. Esta suma ponderada representa la señal total que llega a la neurona.

- Función de Activación: Después de que la función de propagación ha calculado la suma ponderada, la función de activación determina la salida de la neurona. Esta función introduce la no linealidad necesaria para que la red pueda aprender patrones complejos. Si la suma ponderada supera un cierto umbral (o si la función de activación lo permite), la neurona se "activa" y produce una salida. Existen varias funciones de activación comunes, como ReLU (Rectified Linear Unit), Sigmoide o Tanh.

- Función de Transferencia: Aunque a menudo se usa indistintamente con la función de activación, la función de transferencia puede referirse más específicamente a cómo la señal de salida de una neurona se prepara para ser enviada a la siguiente capa. En muchos casos, es simplemente el resultado de la función de activación, pero en algunos modelos puede haber un paso adicional.

El valor de salida de una neurona se convierte en una de las entradas para las neuronas en la capa siguiente, multiplicada por el peso de la conexión correspondiente. Este flujo de información a través de las capas es lo que permite a la red procesar los datos de entrada y generar una salida.

El Proceso de Aprendizaje: Ajustando los Pesos

Para que una red neuronal sea útil, debe aprender a realizar una tarea específica, como reconocer objetos en imágenes o traducir texto. Este aprendizaje se logra mediante un proceso de entrenamiento en el que la red procesa grandes cantidades de datos de ejemplo y ajusta sus pesos y sesgos para minimizar el error entre su salida predicha y la salida correcta conocida.

El algoritmo de aprendizaje más común y fundamental es la retropropagación (backpropagation). Funciona de la siguiente manera:

- Se presenta a la red un conjunto de datos de entrenamiento con sus salidas correctas conocidas.

- La red procesa los datos de entrada a través de sus capas (propagación hacia adelante) para producir una salida.

- Se calcula el error entre la salida producida por la red y la salida correcta.

- El error se propaga hacia atrás a través de la red, desde la capa de salida hasta la capa de entrada.

- Durante esta propagación hacia atrás, el algoritmo calcula cómo contribuyó cada peso y sesgo al error total.

- Se ajustan los pesos y sesgos de cada conexión de manera que se reduzca el error en la próxima iteración.

Este proceso se repite miles o millones de veces con diferentes ejemplos de datos de entrenamiento hasta que la red aprende a producir resultados precisos de manera consistente. La capacidad de ajustar finamente millones o incluso miles de millones de pesos es lo que confiere a las redes neuronales su poder de aprendizaje y adaptación.

Tipos de Aprendizaje

El entrenamiento de las redes neuronales puede clasificarse según cómo se presentan los datos y la información de corrección:

- Aprendizaje Supervisado: Es el tipo más común. La red se entrena con pares de datos de entrada y sus correspondientes salidas correctas (etiquetas). El objetivo es que la red aprenda a mapear las entradas a las salidas correctas. La retropropagación es un algoritmo típico de aprendizaje supervisado, donde el error se calcula directamente comparando la salida de la red con la etiqueta conocida.

- Aprendizaje No Supervisado: En este caso, la red se entrena con datos de entrada sin etiquetas de salida correspondientes. El objetivo es que la red descubra patrones, estructuras o relaciones ocultas dentro de los datos. Técnicas como el clustering (agrupación de datos similares) son ejemplos de aprendizaje no supervisado.

- Aprendizaje por Refuerzo: La red (o agente) aprende interactuando con un entorno. En lugar de recibir etiquetas correctas, recibe una señal de "recompensa" o "penalización" en función de la calidad de sus acciones. El objetivo es que la red aprenda una estrategia (política) para maximizar la recompensa total a lo largo del tiempo. Aunque no se mencionó explícitamente en la fuente como un método de ajuste de pesos para redes neuronales *per se*, es una paradigma de aprendizaje donde las redes neuronales a menudo actúan como el "cerebro" del agente.

Clasificación por Estructura: Diversidad Neuronal

Las redes neuronales no son todas iguales; varían significativamente en su arquitectura, lo que las hace adecuadas para diferentes tipos de problemas. La estructura se refiere principalmente a cómo se organizan las neuronas en capas y cómo se interconectan:

- Redes Monocapa: Son las más simples, consisten en una única capa de neuronas que recibe las entradas y produce las salidas directamente. Las neuronas dentro de esta capa no tienen interconexiones entre sí. Su capacidad de procesamiento es limitada, adecuadas solo para problemas linealmente separables.

- Redes Multicapa (MLP - Multilayer Perceptron): Son las más extendidas. Tienen una capa de entrada, una o varias capas ocultas y una capa de salida. En una MLP estándar, cada neurona de una capa está completamente conectada a todas las neuronas de la capa siguiente. Esta arquitectura les permite aprender patrones complejos y no lineales.

- Redes Neuronales Convolucionales (CNN - Convolutional Neural Networks): Son un tipo especializado de red multicapa, particularmente efectivas para procesar datos con una estructura de cuadrícula, como imágenes. La diferencia clave es que las neuronas en capas sucesivas no están completamente interconectadas; en su lugar, se conectan a subconjuntos locales de neuronas en la capa anterior. Esto permite a la red detectar características espaciales (como bordes o texturas) de manera eficiente. También introducen el concepto de "especialización" de grupos de neuronas.

- Redes Neuronales Recurrentes (RNN - Recurrent Neural Networks): A diferencia de las redes feedforward (donde la información fluye en una sola dirección), las RNN tienen conexiones que forman bucles, permitiendo que la información de pasos de tiempo anteriores influya en el procesamiento actual. Esto les otorga una forma de "memoria", haciéndolas ideales para trabajar con secuencias de datos, como texto o series temporales.

- Redes Radiales: Otro tipo de arquitectura, a menudo usadas en funciones de base radial.

La elección de la arquitectura de red neuronal depende en gran medida del tipo de datos y del problema que se desea resolver.

Aplicaciones Prácticas: Las Redes Neuronales en Nuestro Día a Día

Las redes neuronales artificiales han trascendido el ámbito académico para convertirse en el motor de numerosas aplicaciones prácticas que ya forman parte de nuestra vida cotidiana. Su capacidad para aprender de grandes volúmenes de datos las hace ideales para tareas que requieren reconocimiento de patrones y toma de decisiones complejas.

Algunos ejemplos notables mencionados en la información proporcionada incluyen:

- Sistemas de Reconocimiento de Voz: Tecnologías como Siri, Alexa o Cortana se basan en redes neuronales para entender y procesar el lenguaje hablado, permitiendo la interacción por voz con dispositivos.

- Vehículos Autónomos: Empresas como Tesla y Uber utilizan redes neuronales (particularmente CNNs) para procesar datos de sensores y cámaras, permitiendo que los vehículos perciban su entorno, identifiquen objetos y tomen decisiones de navegación.

- Chatbots y Asistentes Virtuales: Los sistemas capaces de mantener conversaciones coherentes y responder preguntas utilizan redes neuronales para comprender el lenguaje natural y generar respuestas apropiadas.

- Sistemas de Seguridad: Las redes neuronales se emplean en videovigilancia para detectar intrusiones o actividades sospechosas en tiempo real mediante el análisis de imágenes y videos.

Además de estos, las redes neuronales se aplican en campos tan diversos como el diagnóstico médico (análisis de imágenes médicas), la detección de fraude financiero, la recomendación de productos en plataformas de comercio electrónico, la traducción automática de idiomas y la investigación farmacéutica.

Tabla Comparativa: Tipos de Redes (Basado en Estructura)

| Tipo de Red | Estructura | Interconexiones | Capacidad de Memoria | Aplicaciones Típicas |

|---|---|---|---|---|

| Monocapa | Entrada + Salida (1 capa de neuronas) | Entrada a Salida (no entre neuronas de la capa) | No | Problemas simples, linealmente separables |

| Multicapa (MLP) | Entrada + Capas Ocultas (≥1) + Salida | Completamente conectadas entre capas sucesivas | No | Clasificación, regresión, reconocimiento de patrones generales |

| Convolucional (CNN) | Entrada + Capas Convolucionales/Pooling + Capas Densas + Salida | Locales entre capas sucesivas (subconjuntos) | No | Procesamiento de imágenes y video |

| Recurrente (RNN) | Entrada + Capas Recurrentes + Salida | Conexiones con bucles (información de retorno) | Sí (memoria de secuencia) | Procesamiento de lenguaje natural, series temporales |

Esta tabla resume las principales características estructurales de algunos tipos comunes de redes neuronales, destacando cómo su arquitectura influye en su funcionalidad y las tareas para las que son más adecuadas.

Preguntas Frecuentes sobre Redes Neuronales en IA

A continuación, abordamos algunas preguntas comunes sobre las redes neuronales artificiales:

¿Cuál es la principal inspiración detrás de las redes neuronales artificiales?

La principal inspiración proviene de la estructura y el funcionamiento del cerebro humano y sus redes neuronales biológicas. Se busca emular la capacidad del cerebro para procesar información, reconocer patrones y aprender de la experiencia.

¿Cómo aprenden las redes neuronales?

Aprenden ajustando los pesos de las conexiones entre sus neuronas. Este ajuste se realiza típicamente mediante algoritmos de optimización, como la retropropagación, que minimizan el error entre la salida predicha y la salida correcta para los datos de entrenamiento.

¿Qué papel juegan las funciones de activación?

Las funciones de activación son cruciales porque introducen no linealidad en el modelo. Sin ellas, una red neuronal, sin importar cuántas capas tenga, solo podría aprender relaciones lineales. Las funciones de activación permiten a la red modelar patrones y relaciones complejas en los datos.

¿Qué diferencia hay entre una red neuronal monocapa y una multicapa?

Una red monocapa solo tiene una capa de neuronas que procesa la entrada directamente a la salida. Una red multicapa tiene una o más capas ocultas entre la entrada y la salida, lo que le confiere una mayor capacidad para aprender y representar funciones complejas.

¿Para qué se utilizan principalmente las Redes Neuronales Convolucionales (CNN)?

Las CNN son especialmente efectivas para procesar datos con estructura de cuadrícula, como imágenes. Se utilizan ampliamente en tareas de visión por computadora, como clasificación de imágenes, detección de objetos y reconocimiento facial.

¿Pueden las redes neuronales tener memoria?

Sí, algunos tipos de redes neuronales, como las Redes Neuronales Recurrentes (RNN), están diseñadas con conexiones que forman bucles, permitiéndoles mantener información de pasos de tiempo anteriores. Esto les da una forma de memoria que es útil para procesar secuencias de datos.

¿Qué significa el término "peso" en una red neuronal?

El peso es un valor numérico asociado a cada conexión entre neuronas. Determina la fuerza y la influencia de la señal que pasa a través de esa conexión. Los pesos son los parámetros que se ajustan durante el proceso de aprendizaje.

En resumen, las redes neuronales artificiales son una tecnología fundamental en el campo de la inteligencia artificial, inspiradas en la biología del cerebro pero implementadas en software y hardware. Su capacidad para aprender de los datos y su versatilidad en diferentes arquitecturas las convierten en una herramienta indispensable para resolver algunos de los desafíos computacionales más complejos de la actualidad, desde entender el lenguaje hasta permitir que las máquinas "vean" y "piensen". A medida que la capacidad de cómputo continúa creciendo, el potencial y las aplicaciones de las redes neuronales solo seguirán expandiéndose, impulsando la próxima ola de innovación en IA.

Si quieres conocer otros artículos parecidos a ¿Qué son las Redes Neuronales en la IA? puedes visitar la categoría Neurociencia.