El cerebro humano, esa máquina prodigiosa de procesamiento de información, opera de maneras que a menudo desafían nuestra comprensión intuitiva. Lejos de ser un sistema estático y perfectamente ordenado, la investigación en neurociencia revela que su dinamismo, su variabilidad inherente, es fundamental para su funcionamiento. Aquí es donde entra en juego un concepto poderoso tomado de la física y la termodinámica: la entropía. Aplicada al cerebro, la entropía cerebral se convierte en una herramienta esencial para cuantificar esta complejidad y desentrañar los misterios de la conciencia, el envejecimiento y la dinámica de las redes neuronales.

La entropía, en su sentido más general, es una medida del desorden o la aleatoriedad en un sistema. La segunda ley de la termodinámica postula que la entropía de un sistema aislado tiende siempre a aumentar, moviéndose hacia un estado de máximo desorden o equilibrio térmico, la "muerte" del sistema. Sin embargo, los sistemas vivos, incluido el cerebro, parecen desafiar esta ley localmente. Somos sistemas abiertos que consumimos energía y materia de nuestro entorno para mantener un estado altamente organizado y lejos del equilibrio termodinámico. La vida, en esencia, puede verse como una constante lucha contra la entropía, disminuyendo nuestro desorden interno a expensas de aumentar el desorden en nuestro entorno.

- Entropía como Medida de Información y Complejidad

- El Cerebro como Sistema Complejo

- Entropía y Estados de Conciencia

- Entropía y el Cerebro que Envejece

- Entropía y la Dinámica de las Redes Cerebrales

- De la Homeostasis a la Homeoquinesis: La Importancia de la Variabilidad

- Preguntas Frecuentes sobre la Entropía Cerebral

- Conclusión

Entropía como Medida de Información y Complejidad

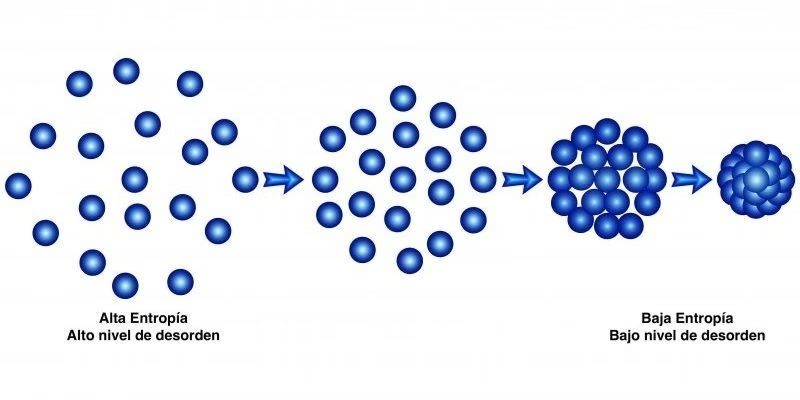

Más allá de la termodinámica, la entropía también es un concepto central en la teoría de la información. En este contexto, la entropía mide la incertidumbre o la cantidad de información inherente a las posibles salidas de un sistema. Un sistema con alta entropía es aquel con muchas posibles configuraciones o estados, y por lo tanto, más impredecible. Un sistema con baja entropía es más predecible, con menos variabilidad.

La neurociencia ha encontrado una correspondencia directa entre la variabilidad de la señal cerebral y la cantidad de información que puede procesar el cerebro. Esta variabilidad no es ruido aleatorio; surge de la compleja interacción entre neuronas y circuitos neuronales a través de diversas escalas espaciotemporales. Se ha demostrado que esta variabilidad está relacionada con un estado de criticidad auto-organizada, un punto óptimo donde el sistema maximiza su capacidad de información. Por lo tanto, la entropía cerebral se convierte en una métrica crucial para cuantificar esta capacidad de procesamiento de información y la complejidad dinámica del cerebro.

El Cerebro como Sistema Complejo

Para entender la entropía cerebral, es vital reconocer que el cerebro es un sistema complejo. A diferencia de los sistemas simples (causa-efecto lineal, la suma de las partes explica el todo) o complicados (muchas partes, pero aún lineales y predecibles con suficiente conocimiento), los sistemas complejos se caracterizan por interacciones no lineales entre sus componentes, lo que da lugar a propiedades emergentes que no pueden predecirse solo a partir de las partes individuales. El comportamiento colectivo de las aves o insectos, los ecosistemas, o el clima son ejemplos de sistemas complejos.

El cerebro, con sus miles de millones de neuronas interconectadas, encaja perfectamente en esta descripción. Su dinámica no es lineal; pequeños cambios en las condiciones iniciales pueden tener efectos significativos y a menudo impredecibles. Esta característica es propia de lo que se conoce como sistemas caóticos (en el sentido técnico, no de desorden total, sino de sensibilidad a las condiciones iniciales y patrones deterministas subyacentes, aunque difíciles de predecir). La vida, y por extensión la función cerebral, parece operar en un estado fascinante que se describe como "al borde del caos".

Estar al borde del caos no significa estar desorganizado, sino estar en un punto óptimo de equilibrio entre el orden rígido y el desorden aleatorio. En este estado, un sistema posee la máxima capacidad para la auto-organización, la adaptación y la generación de nuevos patrones (propiedades emergentes). Los sistemas demasiado ordenados son inflexibles, incapaces de responder a cambios inesperados. Los sistemas demasiado caóticos son impredecibles hasta el punto de la disfunción. El cerebro sano parece residir en este punto intermedio, manteniendo una variabilidad compleja y ordenada que le permite adaptarse y procesar información de manera eficiente.

Entropía y Estados de Conciencia

Una de las áreas donde la entropía cerebral ha demostrado ser particularmente útil es en el estudio de la conciencia y sus estados alterados. Las medidas de entropía pueden diferenciar de manera robusta entre estados como la vigilia, la anestesia o el síndrome de vigilia sin respuesta. Se ha propuesto la hipótesis del "cerebro entrópico", sugiriendo que la entropía de la actividad cerebral espontánea podría ser un marcador del estado de conciencia.

La investigación utilizando entropía ha apoyado modelos teóricos que postulan que la conciencia está asociada con un aumento significativo en el intercambio de información a gran escala entre regiones cerebrales distribuidas, especialmente a distancias medias y largas. Esta conectividad funcional compleja y distribuida parece ser una firma consistente del procesamiento consciente. Reducciones o ausencias de procesamiento consciente se asocian con una menor coordinación interregional y dinámicas cerebrales más restringidas o con patrones que se asemejan más a la conectividad anatómica subyacente, como se observa bajo anestesia.

Durante el ciclo del sueño, la entropía cerebral muestra cambios dependientes de la escala temporal. El sueño de ondas lentas, asociado con una menor conciencia, muestra una complejidad reducida en escalas de tiempo cortas pero un aumento en escalas largas. Esto sugiere que la entropía a diferentes escalas puede reflejar distintos aspectos del procesamiento local versus global de la información.

La anestesia, un estado de pérdida controlada de conciencia, se correlaciona con una disminución notable de la entropía cerebral. Las medidas de entropía pueden rastrear el efecto cualitativo de los agentes anestésicos, diferenciando entre estados de vigilia, sedación y anestesia profunda. Se ha observado que la anestesia reduce la entropía, aumenta la conectividad funcional (en algunos casos) y altera la variabilidad de la señal de manera dependiente de la escala.

Incluso estados como la hipnosis, que alteran la percepción y la conciencia sin pérdida total, muestran cambios medibles en la entropía. Se han identificado efectos de la hipnosis en el contenido de información (entropía) de diferentes bandas de frecuencia (theta, alpha, beta) y cambios en la conectividad funcional, sugiriendo que la hipnosis influye en cómo se procesa y transfiere la información en el cerebro.

Entropía y el Cerebro que Envejece

El proceso de envejecimiento también está íntimamente ligado a cambios en la complejidad y entropía cerebral. Mientras que durante el desarrollo temprano la variabilidad de la señal cerebral aumenta, correlacionándose con un mejor rendimiento cognitivo y adaptabilidad, el envejecimiento normal se asocia con una pérdida de esta complejidad inherente.

Estudios comparando adultos jóvenes y mayores han encontrado que características de la dinámica cerebral asociadas con la complejidad, como la escala de ley de potencias (que indica correlaciones temporales de largo alcance), están presentes en los jóvenes pero disminuyen o desaparecen en los mayores. Esta pérdida de complejidad se correlaciona con una capacidad reducida para responder a estímulos externos y se propone como un factor contribuyente al declive funcional asociado al envejecimiento.

La Red Neuronal por Defecto (DMN), activa durante el estado de reposo, muestra una complejidad reducida en adultos mayores en comparación con los jóvenes, especialmente en regiones clave como el giro cingulado posterior y el hipocampo. Esto apoya la hipótesis de que el envejecimiento implica una reducción en la complejidad de la red y la integración de información.

Además, el envejecimiento parece afectar de manera diferente el procesamiento local y distribuido de la información. Mientras que algunas regiones cerebrales pueden mostrar un aumento en el procesamiento local de información, la complejidad del procesamiento distribuido, especialmente entre hemisferios, tiende a reducirse con la edad. Esto se relaciona con la hipótesis de la desdiferenciación, que sugiere que el declive cognitivo y conductual relacionado con la edad está intrínsecamente ligado a la pérdida de complejidad cerebral.

Entropía y la Dinámica de las Redes Cerebrales

La entropía también proporciona una lente para cuantificar cómo las diferentes regiones cerebrales interactúan y forman redes funcionales. Al medir la entropía o la transferencia de información entre regiones, los neurocientíficos pueden entender cómo emerge la organización funcional a partir de la actividad global del cerebro. Se ha demostrado que subconjuntos de regiones cerebrales interactúan más fuertemente entre sí que con el resto del cerebro, lo que podría ser crucial para la formación de límites funcionales.

Los patrones de variabilidad de la señal no son uniformes en todo el cerebro y se expresan de manera diferente en distintas redes funcionales (como la DMN, la red cingulo-opercular, etc.). La complejidad de estas redes puede estar asociada de manera diferente con la conectividad funcional en distintas escalas temporales. Por ejemplo, la DMN parece acomodar un mayor grado de procesamiento de información a través de conexiones distribuidas, y su complejidad podría ser un índice de la capacidad del cerebro para pasar entre diferentes estados y redes, promoviendo así un mayor procesamiento de información.

La relación entre la conectividad funcional y la entropía no siempre es simple; puede haber correlaciones negativas o positivas dependiendo de la escala temporal y el estado (ej. vigilia vs. anestesia). La anestesia, por ejemplo, puede fortalecer la conectividad funcional en algunos aspectos, pero reducir la entropía, lo que sugiere una dinámica menos compleja y más rígida.

De la Homeostasis a la Homeoquinesis: La Importancia de la Variabilidad

Los conceptos de complejidad y entropía nos llevan a reevaluar ideas tradicionales en fisiología, como la homeostasis. La homeostasis postula que el cuerpo mantiene parámetros fisiológicos dentro de rangos estrechos y estables. Sin embargo, una visión más moderna, alineada con la teoría de sistemas complejos, sugiere que los sistemas vivos operan en un estado de "homeoquinesis".

La homeoquinesis describe la capacidad de un organismo para mantener un entorno interno altamente organizado a través de fluctuaciones controladas y disipación de energía en un estado de no-equilibrio. La variabilidad compleja y ordenada, lejos del equilibrio, es vista como una característica definitoria de la salud y la capacidad adaptativa. La pérdida de esta variabilidad, una rigidez en los patrones dinámicos, se asocia con la enfermedad y el envejecimiento. Por ejemplo, la reducción de la variabilidad de la frecuencia cardíaca se ha relacionado con un mayor riesgo de eventos cardiovasculares.

En este sentido, la entropía cerebral, al cuantificar esta variabilidad y complejidad dinámica, puede ser un indicador de la salud y la capacidad de adaptación del cerebro. Un cerebro sano no es un sistema estático, sino uno que explora activamente un amplio repertorio de estados posibles, manteniendo una dinámica flexible y eficiente "al borde del caos".

Preguntas Frecuentes sobre la Entropía Cerebral

- ¿La entropía cerebral alta es buena o mala?

- En general, una mayor entropía (o complejidad) en la actividad cerebral espontánea se asocia con estados de conciencia despierta y cerebros más jóvenes y saludables. Se relaciona con una mayor capacidad de procesamiento de información y adaptabilidad. Sin embargo, la relevancia de la entropía puede depender de la escala temporal y la región cerebral específica estudiada. La rigidez o baja entropía se asocia más a menudo con estados de conciencia reducida o envejecimiento.

- ¿Cómo se mide la entropía cerebral?

- Se mide utilizando diversas técnicas de análisis de señales cerebrales como EEG (electroencefalografía), MEG (magnetoencefalografía) o fMRI (resonancia magnética funcional). Se aplican algoritmos matemáticos (como Entropía de Permutación, Entropía Multiescala, Entropía Diferencial, etc.) a las series temporales de datos cerebrales para cuantificar su complejidad o variabilidad.

- ¿La entropía cerebral cambia con la edad?

- Sí, la investigación sugiere que la complejidad y entropía de la actividad cerebral tienden a disminuir con el envejecimiento normal, especialmente en ciertas redes como la DMN y en el procesamiento de información distribuido a través de los hemisferios. Esta pérdida de complejidad se relaciona con el declive funcional asociado a la edad.

- ¿Qué relación tiene la entropía cerebral con la conciencia?

- Existe una fuerte hipótesis, la del "cerebro entrópico", que propone que la entropía de la actividad cerebral espontánea es un marcador clave del estado de conciencia. Los estados de conciencia despierta se asocian con mayor entropía y un intercambio de información más distribuido a gran escala, mientras que los estados de conciencia reducida (anestesia, sueño profundo) muestran menor entropía y dinámicas más restringidas.

- ¿Es la entropía cerebral lo mismo que el desorden aleatorio?

- No. Aunque la entropía mide el desorden, en el contexto de los sistemas complejos y caóticos como el cerebro, se refiere a un tipo de desorden organizado o complejidad dinámica. No es simple aleatoriedad (ruido), sino una variabilidad estructurada que permite la adaptabilidad y el procesamiento eficiente de la información. El cerebro sano opera "al borde del caos", un estado que equilibra orden y desorden.

Conclusión

La entropía cerebral es mucho más que un concepto abstracto de la física; es una ventana a la naturaleza fundamental de cómo funciona nuestro cerebro. Nos enseña que la variabilidad y la complejidad dinámica no son meras características secundarias, sino propiedades esenciales que subyacen a la conciencia, la capacidad de adaptación y la salud a lo largo de la vida. Al alejarnos de modelos puramente lineales y estáticos, y abrazar la visión del cerebro como un sistema complejo operando al borde del caos, la neurociencia está abriendo nuevas vías para entender y abordar los desafíos de la salud cerebral, desde los estados alterados de conciencia hasta el impacto del envejecimiento. Este enfoque complejo nos recuerda que la vida, en su esencia más profunda, es una danza dinámica entre el orden y el desorden, y que en esa danza reside nuestra capacidad de ser y de evolucionar.

Si quieres conocer otros artículos parecidos a Entropía Cerebral: El Caos que nos Define puedes visitar la categoría Neurociencia.