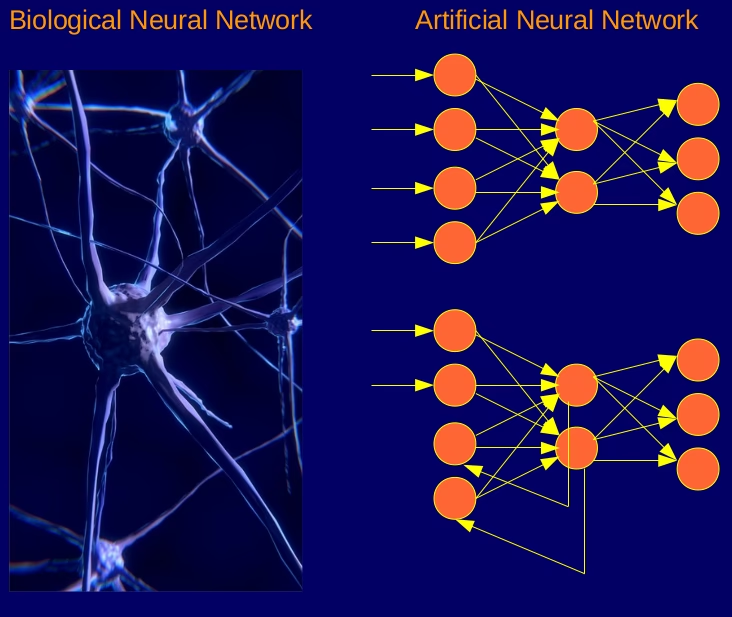

En el fascinante campo de la inteligencia artificial y el aprendizaje automático, a menudo nos encontramos con problemas que los modelos lineales simples no pueden resolver de manera efectiva. Imagina intentar separar puntos de diferentes colores en un gráfico donde la frontera entre ellos no es una línea recta, sino una forma curva o compleja. Aquí es donde entran en juego las redes neuronales artificiales, una arquitectura de modelo inspirada vagamente en la estructura del cerebro humano, diseñada específicamente para detectar y aprender patrones complejos y no lineales en los datos.

- ¿Por Qué Necesitamos Redes Neuronales? La Limitación Lineal

- Los Componentes Fundamentales de una Red Neuronal

- Cómo Hacen Predicciones: El Proceso de Inferencia

- Cómo Aprenden: El Entrenamiento y la Propagación Inversa

- Aplicaciones y Clasificación Multiclase

- Ventajas y Consideraciones

- Tabla Comparativa: Modelos Lineales vs. Redes Neuronales (Patrones Complejos)

- Preguntas Frecuentes (FAQ)

¿Por Qué Necesitamos Redes Neuronales? La Limitación Lineal

Los modelos lineales, como la regresión lineal o la regresión logística simple, funcionan muy bien cuando la relación entre las características de entrada y la salida deseada es, precisamente, lineal. Es decir, cuando puedes trazar una línea (o un plano, o un hiperplano en dimensiones superiores) que separe limpiamente las diferentes categorías o prediga el valor objetivo con precisión.

Sin embargo, muchos problemas del mundo real no son así. Considera un conjunto de datos donde los puntos de dos clases diferentes están distribuidos en un patrón circular o en forma de 'X'. Un modelo lineal intentaría trazar una línea recta para separarlos, lo cual resultaría en muchos errores de clasificación. Para estos problemas, que son inherentemente no lineales, los modelos lineales básicos son insuficientes.

Una técnica para abordar esto con modelos lineales es la ingeniería de atributos, que implica crear nuevas características a partir de las existentes, como combinaciones de atributos (feature crosses). Por ejemplo, si tienes atributos x1 y x2, podrías crear un nuevo atributo x3 = x1 * x2. A veces, al agregar estas combinaciones, un modelo lineal puede aprender a capturar la relación no lineal original. Sin embargo, identificar qué combinaciones de atributos son las correctas para un problema dado, especialmente con muchos atributos, requiere mucha experimentación y conocimiento del dominio. Es un proceso laborioso y no siempre obvio.

Las redes neuronales artificiales ofrecen una solución elegante a este desafío. Están diseñadas para aprender automáticamente las representaciones complejas y las combinaciones de atributos necesarias directamente a partir de los datos de entrada. Durante el entrenamiento, una red neuronal ajusta sus parámetros internos para encontrar la mejor manera de transformar los datos de entrada de manera que las relaciones no lineales se vuelvan separables o modelables en capas posteriores.

Los Componentes Fundamentales de una Red Neuronal

Para entender cómo funcionan las redes neuronales, es crucial conocer sus partes principales:

Nodos (Neuronas Artificiales)

En el núcleo de una red neuronal se encuentran los nodos, también llamados neuronas artificiales o unidades. Cada nodo es una unidad de procesamiento simple que recibe una o más entradas, realiza un cálculo y produce una salida. La operación principal dentro de un nodo es una suma ponderada de sus entradas, a la cual se le añade un sesgo (bias). Matemáticamente, esto se vería algo así como suma = (entrada1 * peso1) + (entrada2 * peso2) + ... + sesgo.

Capas

Los nodos se organizan en capas. Hay típicamente tres tipos de capas en una red neuronal básica:

- Capa de Entrada: Es la primera capa de la red. Recibe directamente los datos crudos del exterior. El número de nodos en esta capa suele ser igual al número de atributos en tus datos de entrada.

- Capas Ocultas: Son las capas intermedias entre la capa de entrada y la capa de salida. Aquí es donde ocurre la mayor parte del procesamiento complejo y el aprendizaje de representaciones. Una red con una o más capas ocultas se conoce como red neuronal profunda (Deep Neural Network). Los nodos en una capa oculta reciben entradas de la capa anterior (ya sea la capa de entrada u otra capa oculta) y pasan su salida a la siguiente capa (otra capa oculta o la capa de salida). Estas capas son fundamentales porque permiten a la red aprender características de alto nivel y patrones complejos a partir de las características de bajo nivel recibidas.

- Capa de Salida: Es la última capa de la red. Produce el resultado final del modelo. El número de nodos en la capa de salida depende del tipo de problema; por ejemplo, para clasificación binaria podría ser un nodo, y para clasificación multiclase podría ser un nodo por cada clase.

Funciones de Activación

Después de realizar la suma ponderada y añadir el sesgo en un nodo, el resultado pasa a través de una función de activación. Esta función es crucial por dos razones principales:

- Introducir No Linealidad: Sin funciones de activación no lineales, incluso una red con muchas capas ocultas sería equivalente a un solo modelo lineal. La función de activación introduce la capacidad de modelar relaciones no lineales, lo que permite a la red aprender patrones complejos.

- Controlar la Magnitud de la Salida: Algunas funciones de activación (como Sigmoide o Tanh) comprimen la salida de un nodo dentro de un rango específico (por ejemplo, entre 0 y 1, o entre -1 y 1), lo que puede ser útil para ciertos tipos de problemas o para evitar que los valores crezcan indefinidamente. Otras funciones (como ReLU - Rectified Linear Unit) simplemente ponen a cero las entradas negativas y dejan las positivas sin cambios, siendo muy populares por su eficiencia.

La combinación de sumas ponderadas y sesgos (operaciones lineales) con funciones de activación no lineales en múltiples capas es lo que otorga a las redes neuronales su inmenso poder para aprender mapeos complejos de entrada a salida.

Cómo Hacen Predicciones: El Proceso de Inferencia

Realizar una predicción con una red neuronal entrenada es un proceso relativamente sencillo conocido como inferencia o pase hacia adelante (forward pass). Funciona de la siguiente manera:

- Los datos de entrada se introducen en la capa de entrada de la red.

- Los nodos de la capa de entrada pasan estos datos a la primera capa oculta.

- Cada nodo en la primera capa oculta recibe las entradas de la capa anterior, calcula la suma ponderada con sus propios pesos y sesgo, y aplica su función de activación. El resultado es la salida de ese nodo.

- Las salidas de la primera capa oculta se convierten en las entradas para la siguiente capa oculta (si existe), y el proceso se repite.

- Este flujo de información continúa a través de todas las capas ocultas hasta llegar a la capa de salida.

- La capa de salida realiza sus cálculos finales (suma ponderada + sesgo + función de activación) y produce el resultado final de la red, que es la predicción del modelo para los datos de entrada dados.

Este proceso es directo y eficiente una vez que la red ha sido entrenada, ya que solo implica una serie de multiplicaciones, sumas y aplicaciones de funciones.

Cómo Aprenden: El Entrenamiento y la Propagación Inversa

El verdadero desafío y el poder de las redes neuronales reside en cómo aprenden. El aprendizaje es el proceso de ajustar los pesos y sesgos de todos los nodos en la red para que, dada una entrada, la red produzca la salida correcta (o una salida muy cercana). Este proceso se realiza utilizando un conjunto de datos de entrenamiento que contiene ejemplos de entrada emparejados con sus salidas correctas (etiquetas).

El entrenamiento de una red neuronal es un proceso iterativo que generalmente sigue estos pasos:

- Pase hacia adelante (Inferencia): La red recibe un ejemplo de entrenamiento y realiza un pase hacia adelante para producir una predicción, como se describió anteriormente.

- Cálculo del Error (Pérdida): La predicción de la red se compara con la salida correcta (etiqueta real) del ejemplo de entrenamiento. Se calcula una medida de la diferencia entre la predicción y la realidad, conocida como función de pérdida o costo. Esta función cuantifica cuán mal se equivocó la red en esa predicción.

- Pase hacia atrás (Retropropagación o Backpropagation): Aquí es donde ocurre la magia del aprendizaje. El algoritmo de propagación inversa calcula el gradiente de la función de pérdida con respecto a cada peso y sesgo en la red. En términos simples, determina cuánto contribuyó cada parámetro (peso o sesgo) al error total de la red. La idea es que si un peso contribuyó positivamente al error, debe ser disminuido, y si contribuyó negativamente, debe ser aumentado.

- Actualización de Pesos y Sesgos: Utilizando los gradientes calculados por la propagación inversa, un algoritmo de optimización (como el descenso de gradiente) ajusta los pesos y sesgos de la red. Los parámetros se actualizan en la dirección que se espera que disminuya la función de pérdida.

Estos pasos se repiten para muchos ejemplos de entrenamiento, a menudo en pequeños lotes (mini-batches), y el proceso completo sobre todo el conjunto de datos de entrenamiento se conoce como una época. A medida que el entrenamiento avanza a través de múltiples épocas, la red aprende gradualmente a ajustar sus pesos y sesgos de manera que la función de pérdida se minimiza, lo que significa que sus predicciones se vuelven cada vez más precisas en el conjunto de entrenamiento. La red aprende a extraer y combinar características relevantes automáticamente para realizar la tarea.

Aplicaciones y Clasificación Multiclase

Las redes neuronales son increíblemente versátiles y se utilizan en una amplia gama de aplicaciones, incluyendo reconocimiento de imágenes, procesamiento de lenguaje natural, detección de anomalías, previsión de series temporales y, por supuesto, clasificación. Su capacidad para aprender representaciones complejas las hace ideales para tareas donde los datos tienen una estructura intrincada.

En el contexto de la clasificación, las redes neuronales pueden manejar fácilmente problemas de clasificación multiclase (donde hay más de dos categorías posibles). La capa de salida típicamente tiene un nodo por cada clase, y una función de activación como softmax se utiliza para producir probabilidades para cada clase, indicando la confianza de la red en que la entrada pertenece a cada una de ellas. La clase con la mayor probabilidad se selecciona como la predicción final.

Aunque la red neuronal aprende a mapear las entradas a estas probabilidades, internamente puede estar utilizando estrategias similares a las de "uno contra todos" (One-vs-All) o "uno contra uno" (One-vs-One) que se usan en otros clasificadores, pero las aprende de forma implícita a través del proceso de entrenamiento y la estructura de sus capas ocultas y la capa de salida.

Ventajas y Consideraciones

La principal ventaja de las redes neuronales es su capacidad para aprender automáticamente representaciones complejas y manejar datos no lineales sin necesidad de una ingeniería manual de atributos exhaustiva. Son modelos muy potentes que pueden lograr un rendimiento de vanguardia en muchas tareas.

Sin embargo, también tienen sus consideraciones. A menudo requieren grandes cantidades de datos etiquetados para ser entrenadas eficazmente. Pueden ser computacionalmente costosas de entrenar, especialmente las redes profundas con muchas capas y nodos. Además, debido a su complejidad y al gran número de parámetros, a menudo se les considera modelos de "caja negra", ya que puede ser difícil interpretar exactamente por qué la red tomó una decisión particular.

Tabla Comparativa: Modelos Lineales vs. Redes Neuronales (Patrones Complejos)

| Aspecto | Modelos Lineales | Redes Neuronales |

|---|---|---|

| Patrones No Lineales | Dificultad intrínseca, requiere ingeniería manual de atributos (feature crosses) para intentar abordarlos. | Diseñadas intrínsecamente para aprender y modelar automáticamente patrones no lineales complejos a través de sus capas y funciones de activación. |

| Ingeniería de Atributos | Altamente dependiente de la selección y combinación manual de atributos. El rendimiento mejora significativamente con buenos atributos diseñados por expertos. | Aprenden automáticamente representaciones jerárquicas de datos y 'feature crosses' internos en sus capas ocultas. Reduce drásticamente la necesidad de ingeniería manual. |

| Complejidad de Modelo | Relativamente simple, con pocos parámetros. Generalmente más fáciles de interpretar. | Puede ser muy compleja, con millones o miles de millones de parámetros. A menudo vistas como una 'caja negra', más difíciles de interpretar. |

| Datos Requeridos | Generalmente requieren menos datos para entrenar modelos razonables. | Requieren grandes cantidades de datos etiquetados para entrenar modelos profundos y potentes que generalicen bien. |

| Coste Computacional | Generalmente bajo. | Puede ser muy alto, especialmente durante el entrenamiento de redes profundas. |

Preguntas Frecuentes (FAQ)

¿Son las redes neuronales un modelo del cerebro humano?

Las redes neuronales artificiales están inspiradas en la estructura y función de las neuronas biológicas, pero son una simplificación y abstracción considerable. No son un modelo exacto del cerebro humano, que es exponencialmente más complejo.

¿Qué significa que una red neuronal sea 'profunda'?

Una red neuronal se considera 'profunda' cuando tiene una o más capas ocultas entre la capa de entrada y la capa de salida. Las redes profundas pueden aprender representaciones de datos más complejas y jerárquicas.

¿Por qué es tan importante la función de activación?

La función de activación introduce no linealidad en la red. Sin ella, apilar múltiples capas de nodos solo resultaría en otra transformación lineal, limitando la capacidad de la red para aprender y modelar patrones complejos y no lineales en los datos.

¿Qué es la propagación inversa?

La propagación inversa es el algoritmo clave utilizado para entrenar redes neuronales. Permite calcular cómo el error en la salida de la red se relaciona con cada peso y sesgo en la red, haciendo posible ajustar estos parámetros para reducir el error durante el entrenamiento.

En resumen, las redes neuronales artificiales son herramientas poderosas para el aprendizaje automático, destacando por su capacidad para aprender automáticamente patrones complejos y manejar problemas no lineales que desafían a los modelos tradicionales. A través de la interacción de sus nodos organizados en capas y el proceso de entrenamiento iterativo basado en la propagación inversa, son capaces de descubrir representaciones de datos sofisticadas que permiten resolver tareas difíciles en campos como la visión artificial, el procesamiento del lenguaje y más.

Si quieres conocer otros artículos parecidos a Fundamentos de Redes Neuronales puedes visitar la categoría Neurociencia.