La capacidad del cerebro para aprender y recordar ha fascinado a la humanidad durante siglos. ¿Cómo es posible que experiencias, conocimientos y habilidades queden grabados en la compleja red neuronal? Una de las teorías más influyentes y fundamentales para responder a esta pregunta es la postulada por el neuropsicólogo canadiense Donald Hebb en su seminal libro de 1949, "The Organization of Behavior". La teoría de Hebb ofreció una explicación coherente sobre cómo la actividad neuronal podría ser la base de fenómenos psicológicos complejos como la percepción, la emoción, el pensamiento y, crucialmente, la memoria. Su enfoque, que integraba experimentos con humanos y animales, estudios clínicos y observaciones lógicas, sentó las bases de la biopsicología moderna y desafió la idea de que el funcionamiento mental era demasiado abstracto para ser explicado por la fisiología cerebral.

- El Principio Fundamental: "Las Neuronas que Disparan Juntas se Conectan"

- Asambleas Neuronales y Engramas: La Arquitectura de la Memoria

- Evidencia Experimental y Modelos de Aprendizaje

- Aplicaciones en Neurociencia Cognitiva y Neuronas Espejo

- Limitaciones de la Teoría Clásica

- Desarrollos Contemporáneos e Impacto en la IA

- Preguntas Frecuentes sobre la Teoría de Hebb

El Principio Fundamental: "Las Neuronas que Disparan Juntas se Conectan"

El núcleo de la teoría de Hebb reside en un principio sorprendentemente simple pero profundamente impactante. Hebb propuso que la base del aprendizaje y la memoria se encuentra en los cambios que ocurren en la sinapsis, el punto de conexión entre dos neuronas. Su famoso principio, a menudo parafraseado como "las neuronas que disparan juntas se conectan" (Neurons that fire together, wire together), establece formalmente:

"Cuando el axón de una célula A está lo suficientemente cerca de una célula B como para excitarla y participa repetida o persistentemente en su disparo, ocurre algún proceso de crecimiento o cambio metabólico, en una o ambas células, de tal modo que la eficacia de A en disparar a B se ve aumentada."

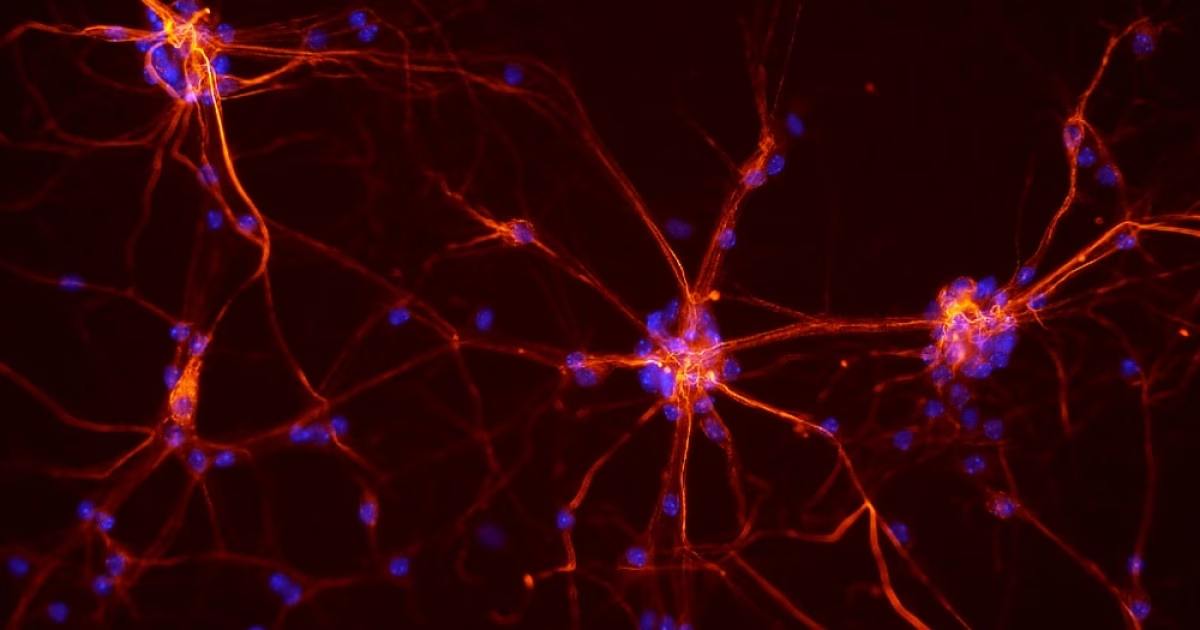

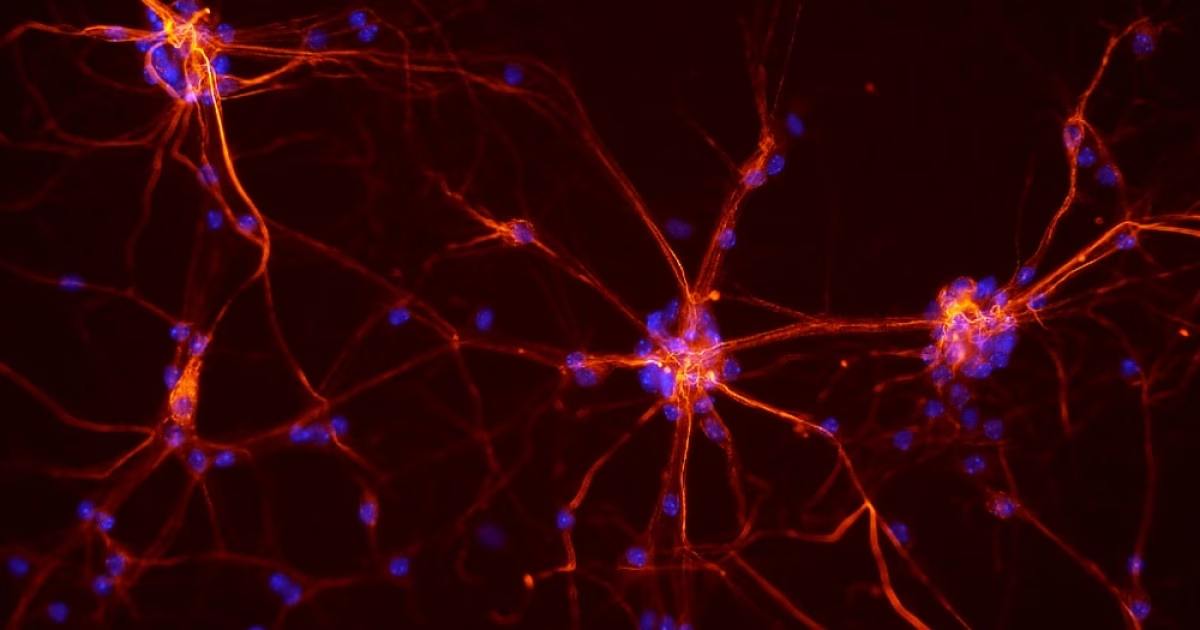

Este principio sugiere que la coincidencia en la actividad de dos neuronas (una presináptica que dispara y una postsináptica que responde) no es casual, sino que provoca un fortalecimiento de la conexión sináptica entre ellas. Inicialmente, Hebb especuló que este cambio podría implicar el desarrollo o agrandamiento de los botones sinápticos en el axón de la neurona presináptica. Investigaciones posteriores han confirmado que, efectivamente, ocurren cambios significativos en las sinapsis durante el aprendizaje, incluyendo el aumento de la velocidad de liberación de neurotransmisores o modificaciones en los receptores de la neurona postsináptica. Lo crucial es que estos cambios incrementan la probabilidad de que, en el futuro, la actividad de la neurona A por sí sola sea suficiente para activar a la neurona B. Este fortalecimiento sináptico basado en la actividad correlacionada es la esencia de lo que hoy conocemos como plasticidad hebbiana.

Asambleas Neuronales y Engramas: La Arquitectura de la Memoria

Partiendo de su principio básico, Hebb desarrolló la idea de las "asambleas neuronales" (cell assemblies). Una asamblea neuronal es un grupo o sistema de células neuronales que se activan repetidamente al mismo tiempo debido a una experiencia particular. La activación concurrente de estas neuronas, según el principio hebbiano, lleva a un fortalecimiento de las conexiones sinápticas entre ellas. Con el tiempo, estas conexiones se vuelven tan fuertes que la activación de una parte de la asamblea es suficiente para activar al resto, haciendo que el grupo dispare como una unidad.

Hebb propuso que estas asambleas neuronales fuertemente interconectadas son la base biológica de las representaciones mentales, como ideas, percepciones o incluso conceptos. Cuando un conjunto particular de neuronas que representan un objeto o una experiencia se activa repetidamente, se forma una asamblea neuronal que codifica esa información específica. A esta representación neuronal consolidada, Hebb la llamó engrama. Los engramas, por lo tanto, son las huellas físicas de la memoria en el cerebro, almacenados en estas asambleas neuronales superpuestas.

La formación de un engrama puede entenderse mediante el concepto de auto-asociación. Si los estímulos sensoriales entrantes provocan repetidamente el mismo patrón de actividad en un conjunto de neuronas, las conexiones dentro de ese conjunto se fortalecerán progresivamente. Esto significa que cada elemento (neurona) en el patrón tenderá a activar a los otros elementos dentro del mismo patrón y, potencialmente, a inhibir aquellos que no forman parte de él. De esta manera, el patrón completo se vuelve "auto-asociado", permitiendo que la activación parcial de la asamblea neuronal (por ejemplo, ver una parte de un objeto) active la asamblea completa y "recupere" la representación completa (recordar el objeto entero).

Evidencia Experimental y Modelos de Aprendizaje

Aunque la teoría de Hebb fue inicialmente conceptual, la investigación neurocientífica posterior ha proporcionado evidencia significativa que apoya sus principios. Los trabajos pioneros de Eric Kandel con el gasterópodo marino Aplysia californica demostraron que mecanismos de aprendizaje hebbiano operan a nivel sináptico. En este organismo simple, se observó que la potenciación a largo plazo (LTP), un aumento duradero en la fuerza de la conexión sináptica, junto con la facilitación presináptica dependiente de la actividad, eran cruciales para la plasticidad sináptica y el condicionamiento clásico, un proceso de aprendizaje que encaja perfectamente con el marco hebbiano (la asociación repetida de un estímulo neutro con uno significativo).

Si bien gran parte de la investigación inicial en vertebrados utilizó estimulación experimental no fisiológica, estudios más recientes han identificado mecanismos de modificación sináptica fisiológicamente relevantes que parecen ser ejemplos de procesos hebbianos. La investigación contemporánea sigue explorando cómo los cambios sinápticos a largo plazo en cerebros de vertebrados se inducen por actividad sináptica relevante, involucrando tanto mecanismos hebbianos como no hebbianos.

Además de su relevancia biológica, el principio de Hebb ha sido fundamental en el campo de las redes neuronales artificiales. En estos modelos computacionales, el aprendizaje hebbiano se utiliza como un algoritmo para ajustar los "pesos" de las conexiones entre neuronas artificiales. La regla básica dicta que el peso entre dos neuronas aumenta si ambas se activan simultáneamente y disminuye si se activan por separado. Esto puede representarse matemáticamente de diversas formas, una de las más simples para el cambio de peso entre la neurona j e i es:

Δw_ij = η * x_i * x_j

donde Δw_ij es el cambio en el peso, η es una tasa de aprendizaje, x_i es la actividad de la neurona i, y x_j es la actividad de la neurona j. Esta regla permite a la red aprender patrones y asociaciones directamente de los datos de entrada.

Aunque esta forma simple de aprendizaje hebbiano puede ser inestable (los pesos pueden crecer exponencialmente), ha demostrado capturar propiedades estadísticas de los datos de entrada, lo que lo relaciona con el aprendizaje no supervisado. Se ha demostrado matemáticamente que, bajo ciertas condiciones, una red que aprende con una regla hebbiana simple puede extraer el primer componente principal (el eje de mayor varianza) de los datos de entrada, un proceso conocido como Análisis de Componentes Principales (PCA). Modelos más sofisticados, como la regla de Oja o el algoritmo hebbiano generalizado, abordan los problemas de estabilidad.

Aplicaciones en Neurociencia Cognitiva y Neuronas Espejo

La teoría de Hebb no se limita a explicar la formación básica de asociaciones, sino que también tiene implicaciones para procesos cognitivos más complejos. Se ha explorado su vínculo con la toma de decisiones y el aprendizaje social. Investigaciones recientes en neurociencia cognitiva investigan cómo los principios hebbianos podrían operar en regiones cerebrales asociadas con el procesamiento de recompensa y la cognición social, como el estriado y la corteza prefrontal. Se hipotetiza que la plasticidad hebbiana en estas áreas podría subyacer a la formación de hábitos, el aprendizaje por refuerzo e incluso el desarrollo de vínculos sociales.

Una aplicación particularmente influyente de la teoría de Hebb (y su refinamiento, la plasticidad dependiente del tiempo de disparo o STDP) es la explicación de cómo emergen las neuronas espejo. Estas neuronas, que se activan tanto cuando un individuo realiza una acción como cuando observa a otro realizar una acción similar, son cruciales para comprender las acciones ajenas y la imitación. La teoría hebbiana sugiere que la observación de una acción activa las mismas regiones cerebrales que se usarían para realizarla. Las señales sensoriales (vista, sonido) de la acción observada coinciden temporalmente con la actividad de las neuronas motoras que se activarían si se realizara la acción. Esta coincidencia repetida, según Hebb, fortalece las sinapsis entre las representaciones sensoriales y motoras de la acción. Con el tiempo, la conexión se vuelve tan fuerte que la simple percepción de la acción (el sonido o la visión) es suficiente para activar las neuronas motoras correspondientes, creando así una neurona espejo.

Un ejemplo ilustrativo es el de los pianistas. Personas sin experiencia previa no activan regiones motoras al escuchar música de piano. Sin embargo, después de solo cinco horas de lecciones donde el sonido del piano se empareja consistentemente con la ejecución motora, la simple audición de música de piano es suficiente para activar esas regiones motoras, lo que sugiere que se ha formado una asociación hebbiana entre el estímulo auditivo y el programa motor.

Limitaciones de la Teoría Clásica

A pesar de su influencia, la teoría original de Hebb presenta ciertas limitaciones y no abarca todas las formas de plasticidad sináptica. Hebb no propuso reglas explícitas para las sinapsis inhibitorias, que son fundamentales para la función cerebral. Tampoco abordó las secuencias de disparo anti-causales (donde la neurona postsináptica dispara antes que la presináptica), un fenómeno que sí considera la STDP.

Además, la plasticidad sináptica no siempre se limita a las sinapsis directamente involucradas en la actividad conjunta de A y B. Existen formas de plasticidad heterosináptica (cambios en una sinapsis debido a la actividad en otra sinapsis cercana) y plasticidad homeostática (mecanismos que regulan la excitabilidad general de una neurona o red) que no se explican completamente por el principio hebbiano simple. La señalización retrógrada (donde la neurona postsináptica envía una señal de vuelta a la presináptica), a menudo mediada por sustancias como el óxido nítrico, puede afectar sinapsis vecinas a través de un tipo de "aprendizaje de volumen" que escapa al modelo hebbiano clásico.

| Concepto | Descripción según Hebb |

|---|---|

| Principio Hebbiano | La actividad conjunta repetida de neuronas fortalece su conexión sináptica. |

| Ensambles Neuronales | Grupos de neuronas fuertemente interconectadas por actividad conjunta, base de representaciones mentales. |

| Engrama | La huella física de la memoria, almacenada en un ensamble neuronal auto-asociado. |

| Plasticidad Sináptica | Cambios en la fuerza o eficacia de las sinapsis (aumento de botones, liberación de neurotransmisores, etc.). |

| Auto-asociación | La capacidad de una asamblea neuronal para recuperar el patrón completo a partir de una activación parcial. |

Desarrollos Contemporáneos e Impacto en la IA

La investigación moderna ha ampliado y refinado las ideas originales de Hebb. La Plasticidad Dependiente del Tiempo de Disparo (STDP) es un ejemplo clave, que incorpora la sincronización precisa entre los potenciales de acción pre y postsinápticos para determinar la dirección y magnitud del cambio sináptico. Si la neurona presináptica dispara justo antes que la postsináptica, la conexión se fortalece (potenciación); si dispara justo después, se debilita (depresión).

La teoría de Hebb sigue siendo una piedra angular en el desarrollo de algoritmos de aprendizaje en la inteligencia artificial (IA). Se ha aplicado en diversas arquitecturas de redes neuronales. Aunque la regla hebbiana pura es simple, ha inspirado modelos más complejos utilizados en algoritmos de aprendizaje por refuerzo y en la creación de modelos más biológicamente plausibles del aprendizaje en sistemas artificiales. Estos enfoques buscan mejorar la eficiencia y convergencia de los modelos de IA.

Un área emergente es la aplicación de principios hebbianos en la computación cuántica. Aunque las redes neuronales clásicas son el foco principal, se está explorando cómo las ideas hebbianas podrían informar algoritmos inspirados en la cuántica que aprovechen la superposición y el entrelazamiento para mejorar los procesos de aprendizaje. La investigación actual busca cómo los principios hebbianos podrían contribuir al desarrollo de modelos de aprendizaje automático cuántico más eficientes.

Finalmente, la investigación reciente ha puesto un foco importante en el papel de las neuronas inhibitorias, que a menudo se pasaban por alto en los modelos hebbianos tradicionales. Los modelos más completos ahora consideran la interacción equilibrada entre sinapsis excitatorias e inhibitorias. Los estudios sugieren que las neuronas inhibitorias son cruciales para mantener la estabilidad en los circuitos neuronales y prevenir la retroalimentación positiva descontrolada que podría ocurrir con un aprendizaje hebbiano puramente excitatorio. Esta integración de la inhibición proporciona una comprensión más matizada de cómo opera el aprendizaje hebbiano en el cerebro real.

Preguntas Frecuentes sobre la Teoría de Hebb

¿Cuál es la principal contribución de Donald Hebb a la neurociencia?

Su principal contribución es la teoría de la plasticidad sináptica, resumida en el principio "neuronas que disparan juntas se conectan", que explica cómo la actividad neuronal conjunta modifica las conexiones sinápticas y es la base del aprendizaje y la memoria.

¿Qué son los engramas según Hebb?

Los engramas son las huellas físicas de la memoria en el cerebro, representadas por ensambles de neuronas cuyas conexiones sinápticas se han fortalecido mediante la actividad conjunta repetida.

¿Cómo se aplica la teoría de Hebb en la inteligencia artificial?

El principio hebbiano se utiliza como un algoritmo para ajustar los pesos de las conexiones entre neuronas artificiales en redes neuronales, permitiendo que la red aprenda patrones y asociaciones a partir de los datos.

¿La teoría de Hebb explica toda forma de aprendizaje en el cerebro?

No, aunque es fundamental, la teoría original tiene limitaciones. No explica completamente el papel de las neuronas inhibitorias, ciertos tipos de plasticidad sináptica como la heterosináptica o homeostática, o la influencia del tiempo preciso de disparo (abordado por la STDP).

¿Qué son las asambleas neuronales?

Son grupos de neuronas cuyas conexiones sinápticas se han fortalecido significativamente debido a su activación simultánea repetida. Se considera que estas asambleas representan ideas, percepciones o recuerdos específicos.

La teoría de Donald Hebb sigue siendo una piedra angular en nuestra comprensión de la plasticidad cerebral y cómo el aprendizaje y la memoria se materializan a nivel neuronal. Aunque los desarrollos posteriores han refinado y ampliado sus ideas, el principio básico de que la actividad conjunta fortalece las conexiones neuronales sigue siendo una verdad fundamental en neurociencia.

Si quieres conocer otros artículos parecidos a Teoría de Hebb: Neuronas que Disparan Juntas puedes visitar la categoría Neurociencia.