La neurociencia es un campo vasto y fascinante que busca desentrañar los misterios del cerebro. Para comprender cómo funciona este órgano complejo, los investigadores utilizan una variedad de herramientas y conceptos. Entre ellos, los tetrodes permiten registrar la actividad eléctrica neuronal con detalle espacial, mientras que la entropía ofrece una perspectiva abstracta pero profunda sobre la complejidad y el procesamiento de la información cerebral.

Los Tetrodes: Ventanas a la Actividad Neuronal Individual

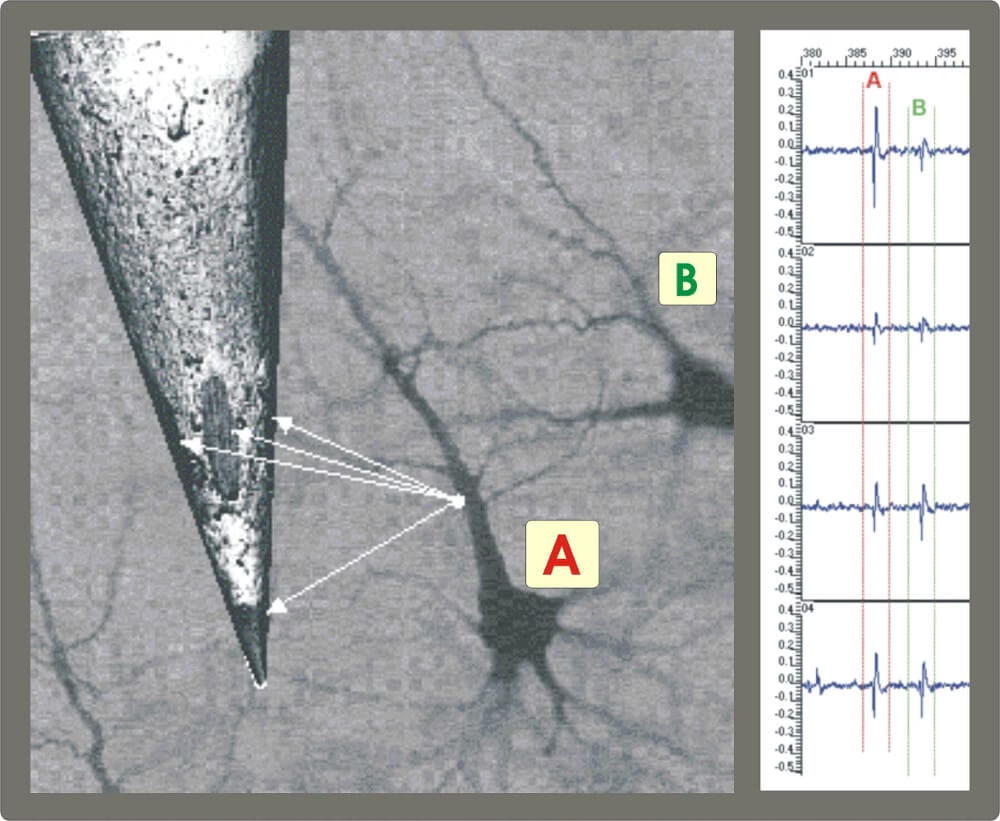

En el estudio de la actividad eléctrica del tejido nervioso, como el cerebro, una herramienta fundamental son los electrodos. Permiten a los neurocientíficos medir los potenciales de campo extracelulares generados por las neuronas. Un tipo especializado de electrodo, conocido como tetrode, lleva esta capacidad a un nivel superior, permitiendo discriminar la actividad de neuronas individuales que se encuentran muy cerca unas de otras.

¿Qué es un Tetrode?

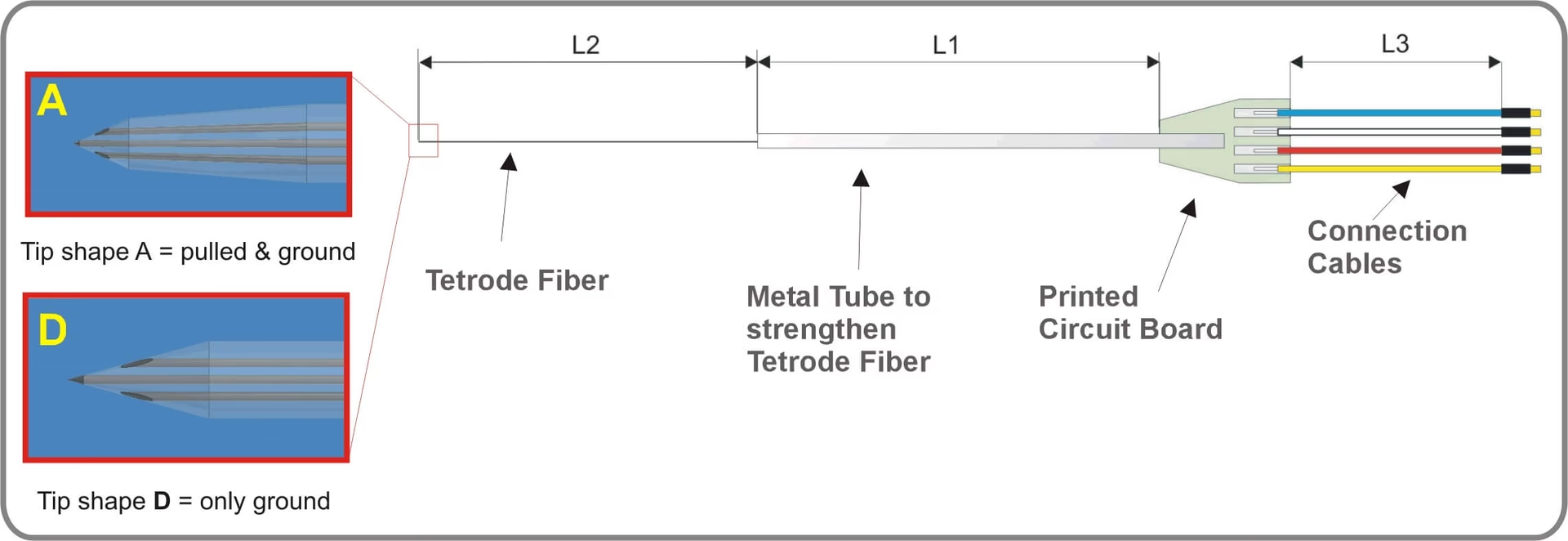

Un tetrode se construye agrupando cuatro electrodos muy pequeños. Cada uno de estos cables suele tener un diámetro inferior a 30 micrómetros. Esta configuración de cuatro puntas, dispuestas muy próximas entre sí, es la clave de su utilidad en el registro de alta resolución.

Función Principal: Clasificación de Potenciales de Acción (Spike Sorting)

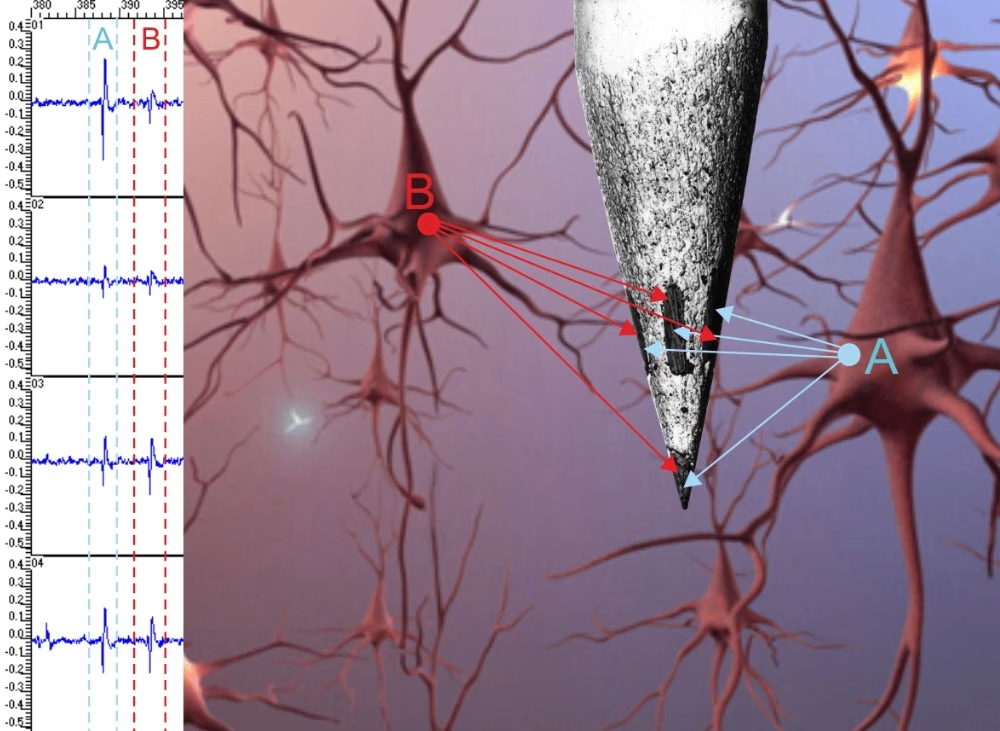

La función principal de un tetrode es ayudar a clasificar los potenciales de acción (también conocidos como spikes) registrados en el espacio extracelular, atribuyéndolos a neuronas individuales. Dado que los cuatro canales del tetrode están muy cerca de una célula, los potenciales de acción emitidos por esa neurona suelen ser detectados en cada uno de los cuatro canales.

Sin embargo, debido a la ligera distribución espacial de los canales individuales del tetrode, la amplitud de la señal registrada varía en cada uno de ellos. Una neurona más cercana a un canal específico producirá un potencial de acción de mayor amplitud en ese canal que en los otros. Una neurona diferente, ubicada en una posición ligeramente distinta respecto al tetrode, generará un patrón de amplitudes diferente a través de los cuatro canales.

Este patrón distintivo de amplitudes a través de los cuatro canales permite a los investigadores diferenciar los potenciales de acción generados por una neurona de los generados por otra. Este proceso se conoce como spike sorting o clasificación de espigas. Es una tarea crucial para analizar la actividad de poblaciones neuronales densas, donde múltiples células contribuyen a la señal registrada por el tetrode.

La regularidad en las diferencias de las formas de onda registradas en los distintos electrodos proporciona mucha más información sobre la identidad de los axones que generan los potenciales que la que se podría obtener de un registro realizado con un solo electrodo.

Comparación: Electrodo vs. Tetrode

Para entender mejor el valor de un tetrode, es útil compararlo con un electrodo monopolar simple:

- Electrodo Monopolar: Un solo punto de registro. Registra la suma de los potenciales de campo de todas las neuronas cercanas. Es difícil distinguir la actividad de neuronas individuales si hay varias cerca. La amplitud de un potencial de acción registrado depende principalmente de la distancia de la neurona al electrodo.

- Tetrode: Cuatro puntos de registro muy cercanos. Registra la actividad en cuatro ubicaciones ligeramente diferentes simultáneamente. Permite el spike sorting al analizar el patrón de amplitudes a través de los cuatro canales. Esto facilita la identificación y seguimiento de neuronas individuales, incluso en zonas con alta densidad neuronal.

En esencia, el tetrode aprovecha la información espacial para descomponer una señal compleja (la suma de la actividad de varias neuronas) en sus componentes individuales (la actividad de cada neurona).

Aplicaciones de los Tetrodes

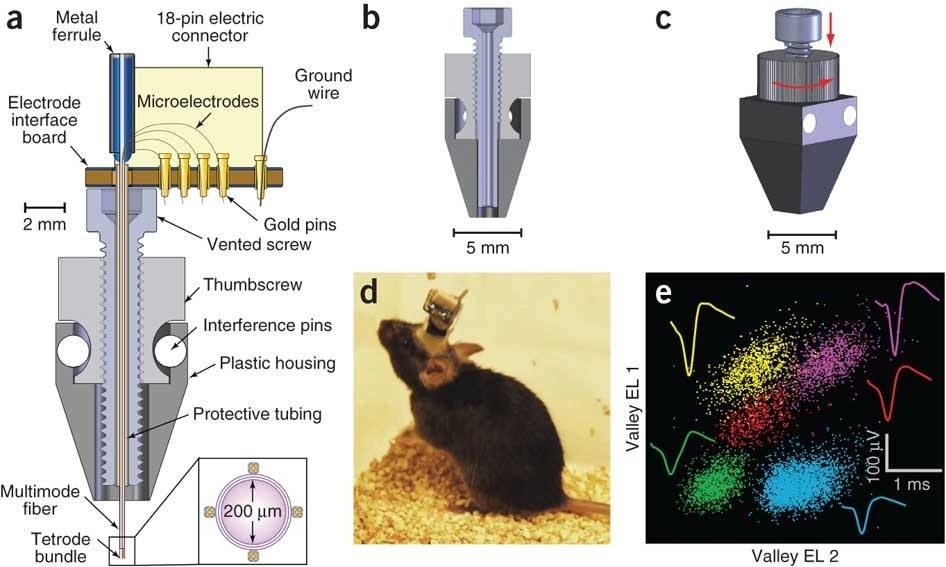

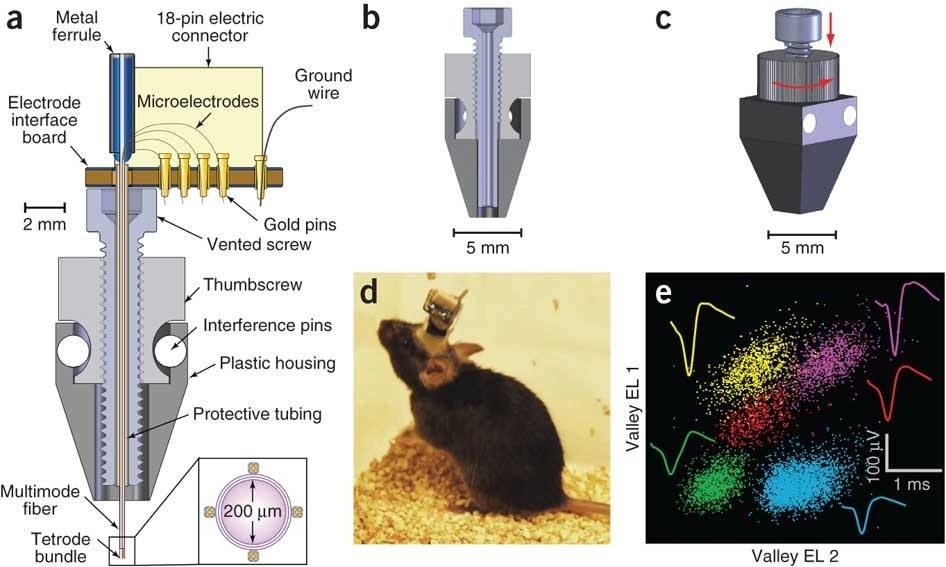

Los tetrodes se utilizan ampliamente en la investigación de la electrofisiología extracelular en animales experimentales. A menudo se integran en dispositivos implantables llamados micro-drives. Estos micro-drives permiten mover los tetrodes con gran precisión hacia arriba y hacia abajo dentro del cerebro del animal, lo que posibilita a los investigadores buscar y optimizar el registro de neuronas específicas en diferentes profundidades.

Preguntas Frecuentes sobre Tetrodes

¿Por qué se usan cuatro electrodos en lugar de tres o cinco?

Aunque el concepto se puede aplicar a cualquier número 'n' de electrodos cercanos (n-trode), cuatro (tetrode) es una configuración que se ha demostrado muy efectiva. Permite triangular la posición aproximada de la neurona respecto a las puntas y proporciona suficientes puntos de referencia para diferenciar patrones de amplitud de distintas neuronas cercanas.

¿Cuál es el principal desafío al usar tetrodes?

El principal desafío es el proceso de spike sorting, que puede ser complejo, especialmente en registros con muchas neuronas activas simultáneamente o con bajo nivel de señal. Requiere algoritmos sofisticados para agrupar correctamente los potenciales de acción por neurona.

¿Se pueden usar tetrodes en humanos?

Principalmente se utilizan en investigación con animales debido a su naturaleza invasiva. En humanos, los registros suelen realizarse con electrodos de superficie (EEG) o, en casos clínicos específicos (como cirugía de epilepsia), con electrodos implantados, pero la tecnología de tetrodes individuales para investigación detallada de neuronas únicas es más común en modelos animales.

La Entropía: Cuantificando la Información y Complejidad Cerebral

Más allá de la actividad eléctrica individual, la neurociencia busca comprender los principios organizativos y de procesamiento de información a gran escala en el cerebro. Aquí es donde conceptos de la teoría de la información, como la entropía, resultan herramientas poderosas.

¿Qué es la Entropía en Neurociencia?

En el contexto de la teoría de la información, la entropía de una variable aleatoria se define como el nivel promedio de "información", "sorpresa" o "incertidumbre" inherente a sus posibles resultados. Es una medida de información como medida de incertidumbre. En palabras de Shannon, mide "cuánta 'elección' está involucrada en la selección del evento o cuán inciertos estamos sobre el resultado".

En neurociencia, la entropía se utiliza para cuantificar la complejidad y la capacidad de procesamiento de información de la actividad cerebral. Dada la correspondencia directa entre la varianza (o variabilidad) y la cantidad de información, la entropía se convierte en una métrica clave para estudiar la variabilidad de la señal cerebral, que se ha demostrado crucial para su función.

Entropía y Variabilidad de la Señal Cerebral

La variabilidad de la señal cerebral emerge de la interacción entre neuronas individuales y sus circuitos, extendiéndose a través de amplias escalas espacio-temporales. Investigaciones sustanciales relacionan esta variabilidad con la criticidad autoorganizada del cerebro, un estado en el que el cerebro maximiza su capacidad de información. La entropía captura precisamente esta idea, cuantificando la "riqueza" de los posibles estados en los que el cerebro puede encontrarse.

Aplicaciones Clave de la Entropía en Neurociencia

El uso de la entropía para cuantificar la función cerebral abarca desde la capacidad de información de la memoria de trabajo y la codificación neuronal hasta la interacción entre la adaptación neuronal y el comportamiento, la interactividad funcional entre regiones cerebrales y, de manera destacada, el estado de conciencia.

Tres áreas de investigación en las que el uso de la entropía ha arrojado resultados particularmente prometedores son:

1. El Estado (Alterado) de Conciencia

Los enfoques clásicos para estudiar la conciencia a menudo se centran en áreas cerebrales específicas. Sin embargo, la modulación de la información no siempre implica un cambio en el poder o la actividad regional. Las medidas basadas en entropía, diseñadas para cuantificar la cantidad de información, abordan esta limitación, identificando la complejidad de la señal cerebral como una propiedad fundamental de la experiencia consciente.

- Estados de Inconsciencia: La entropía ha demostrado ser capaz de diferenciar estados como el síndrome de vigilia sin respuesta, el estado mínimamente consciente y el estado consciente. Un aumento notable en el intercambio de información distribuida, particularmente en la conectividad de medio y largo alcance, se asocia con el estado consciente. La entropía de las trayectorias de Markov ha sugerido que la conciencia humana se basa en un circuito temporal caracterizado por la accesibilidad equilibrada y recíproca de la red de modo por defecto (DMN) y la red de atención dorsal (DAT).

- Anestesia: El cambio en la entropía ha rastreado el efecto cualitativo de los fármacos anestésicos, desde el estado de vigilia hasta la sedación/anestesia ligera y, finalmente, la anestesia profunda. Los índices basados en entropía han demostrado ser robustos, eficientes computacionalmente y resistentes a artefactos.

- Hipnosis: La entropía ha proporcionado una medida unificadora para reproducir observaciones previas basadas en múltiples biomarcadores sobre el efecto de la hipnosis en el cerebro. Ha identificado un efecto bihemisférico significativo de la sugestionabilidad hipnótica en el contenido de información de las bandas de frecuencia theta, alfa y beta, alineándose con hallazgos previos sobre el papel de estas bandas en el procesamiento y transferencia de información.

Estos estudios sugieren que las medidas entrópicas pueden servir como biomarcadores potenciales para diferenciar estados de conciencia.

2. El Cerebro que Envejece

Una creciente cantidad de estudios apunta a la interacción entre la complejidad fisiológica y la capacidad de adaptación del cerebro. La pérdida de esta complejidad a través del proceso de envejecimiento se reconoce como un factor que contribuye a diversos deterioros cognitivos relacionados con la edad.

- Variabilidad y Desarrollo: La variabilidad de la señal cerebral aumenta con la edad durante el desarrollo y se correlaciona con una reducción de la variabilidad conductual y un rendimiento más preciso en tareas cognitivas. Esto valida que la maduración del sistema neuronal promueve una mayor variabilidad fisiológica, permitiendo una mejor adaptabilidad ambiental.

- Escala de Ley de Potencia: Se ha identificado un aumento significativo en la complejidad de la señal cerebral en adultos jóvenes en respuesta a la estimulación, lo que corresponde a una correlación temporal de largo alcance. Esta propiedad de escala de ley de potencia parece disminuir o estar ausente en el cerebro de adultos mayores, lo que sugiere una relación entre la complejidad intrínseca y la capacidad de respuesta a estímulos externos.

- Entropía y DMN: La red de modo por defecto (DMN) en individuos mayores exhibe una complejidad reducida en comparación con los adultos jóvenes, particularmente en componentes clave como el giro cingulado posterior. Esto respalda la hipótesis de que el envejecimiento subyace a la reducción de la complejidad de la red y la integración de información en el cerebro.

- Procesamiento Local vs. Distribuido: Mientras que la mayoría de las regiones cerebrales muestran un aumento en el procesamiento de información local con la edad, el cambio en la complejidad distribuida relacionada con la edad se reduce a través de los hemisferios. Esto podría explicar la mayor modularidad cerebral observada en adultos mayores como una consecuencia de su mayor procesamiento local y reducida capacidad de procesamiento distribuido.

En conjunto, estos hallazgos respaldan la hipótesis de la dediferenciación, que postula que el declive cerebral y conductual relacionado con la edad y la pérdida de complejidad cerebral son sinónimos e integrados.

3. Cuantificación del Procesamiento de Información en Redes Cerebrales

La correspondencia de la entropía cerebral con la conciencia y el envejecimiento surge de la asociación entre la complejidad inherente del cerebro y su capacidad para procesar información.

- Emergencia de Redes Funcionales: Índices de conectividad funcional basados en entropía han mostrado que ciertos subconjuntos de regiones cerebrales interactúan más fuertemente entre sí que con el resto del cerebro. Estas variaciones pueden ser cruciales para la emergencia de límites funcionales a partir de la conectividad global generalizada.

- Variabilidad en Redes Distribuidas: Los patrones de variabilidad de la señal cerebral son distintos del ruido y se expresan de manera diferente en redes distribuidas como la DMN y las redes de atención frontoparietales. La complejidad de estas redes se asocia negativamente/positivamente con la conectividad funcional en escalas de tiempo pequeñas/grandes, sugiriendo que la DMN podría acomodar un mayor grado de procesamiento de información a través de conexiones distribuidas.

- Variabilidad y Sincronía Funcional: Se ha observado una fuerte correlación lineal espacio-temporal negativa entre la conectividad funcional y la entropía. Esto sugiere que la anestesia afecta la función cerebral al reducir su entropía, fortalecer su conectividad funcional y disminuir/aumentar su variabilidad de señal en escalas de tiempo pequeñas/grandes.

Estos estudios convergen en la utilidad de la complejidad cerebral en su función y procesamiento de información.

Tipos de Medidas de Entropía

Aunque existen varias formulaciones, algunas de las medidas de entropía comúnmente utilizadas en neurociencia incluyen:

- Entropía Diferencial (DE): Se refiere a la entropía de una variable aleatoria continua. Su cálculo se basa en la estimación de la distribución de probabilidad subyacente a la serie temporal observada.

- Entropía Multiescala (MSE): Incorpora el cálculo de la entropía de muestra (SE) en un procedimiento conocido como coarse-graining. Permite cuantificar la variabilidad de la señal en múltiples escalas de tiempo, revelando cómo la complejidad varía a diferentes "resoluciones" temporales.

- Entropía de Permutación (PE): Utiliza las reapariciones de patrones ordinales en la señal para estimar su variabilidad. Considera el orden relativo de los valores en la serie temporal, lo que la hace robusta al ruido.

Estas medidas discretizan la serie temporal continua de diferentes maneras para aplicar conceptos de entropía.

Preguntas Frecuentes sobre Entropía en Neurociencia

¿La alta entropía significa que el cerebro es más aleatorio?

No necesariamente. En el contexto cerebral, una alta entropía a menudo se asocia con una mayor complejidad y una capacidad rica para explorar diferentes estados, lo que se relaciona con un procesamiento de información eficiente y una mayor flexibilidad, no con un simple caos aleatorio.

¿Cómo se relaciona la entropía con la conectividad cerebral?

La entropía puede cuantificar la complejidad de la actividad dentro de las redes cerebrales y cómo esta complejidad se relaciona con la forma en que las regiones interactúan (conectividad funcional). Por ejemplo, una mayor complejidad en ciertas redes puede estar asociada con un procesamiento de información distribuido eficiente.

¿Puede la entropía ayudar a diagnosticar trastornos neurológicos?

La investigación sugiere que los cambios en la complejidad cerebral, cuantificados por la entropía, están relacionados con diversas condiciones neurológicas y psiquiátricas. La pérdida de complejidad con el envejecimiento, por ejemplo, se relaciona con el declive cognitivo. Explorar cómo la entropía cambia en diferentes trastornos es un área activa de investigación con potencial diagnóstico.

Conclusión

Los tetrodes y el concepto de entropía representan enfoques complementarios para estudiar el cerebro. Mientras que los tetrodes nos brindan una visión detallada de la actividad eléctrica de neuronas individuales, permitiendo el aislamiento de su contribución, la entropía ofrece una métrica poderosa para comprender la complejidad dinámica y la capacidad de procesamiento de información del cerebro a escalas mayores. Juntos, estas herramientas y conceptos contribuyen significativamente a nuestra comprensión de cómo el cerebro procesa la información, sustenta la conciencia y cambia a lo largo de la vida.

Si quieres conocer otros artículos parecidos a Neurociencia: Tetrodes y Entropía Cerebral puedes visitar la categoría Neurociencia.