El estudio del cerebro humano y su actividad eléctrica es un campo fascinante que ha dado lugar a avances tecnológicos asombrosos. Uno de estos avances es la Interfaz Cerebro-Computadora (BCI), que permite la comunicación directa entre el cerebro y un dispositivo externo. Sin embargo, para que una BCI funcione, es fundamental poder entender y traducir las complejas señales que emite el cerebro. Aquí es donde entra en juego el procesamiento de señales neurofisiológicas.

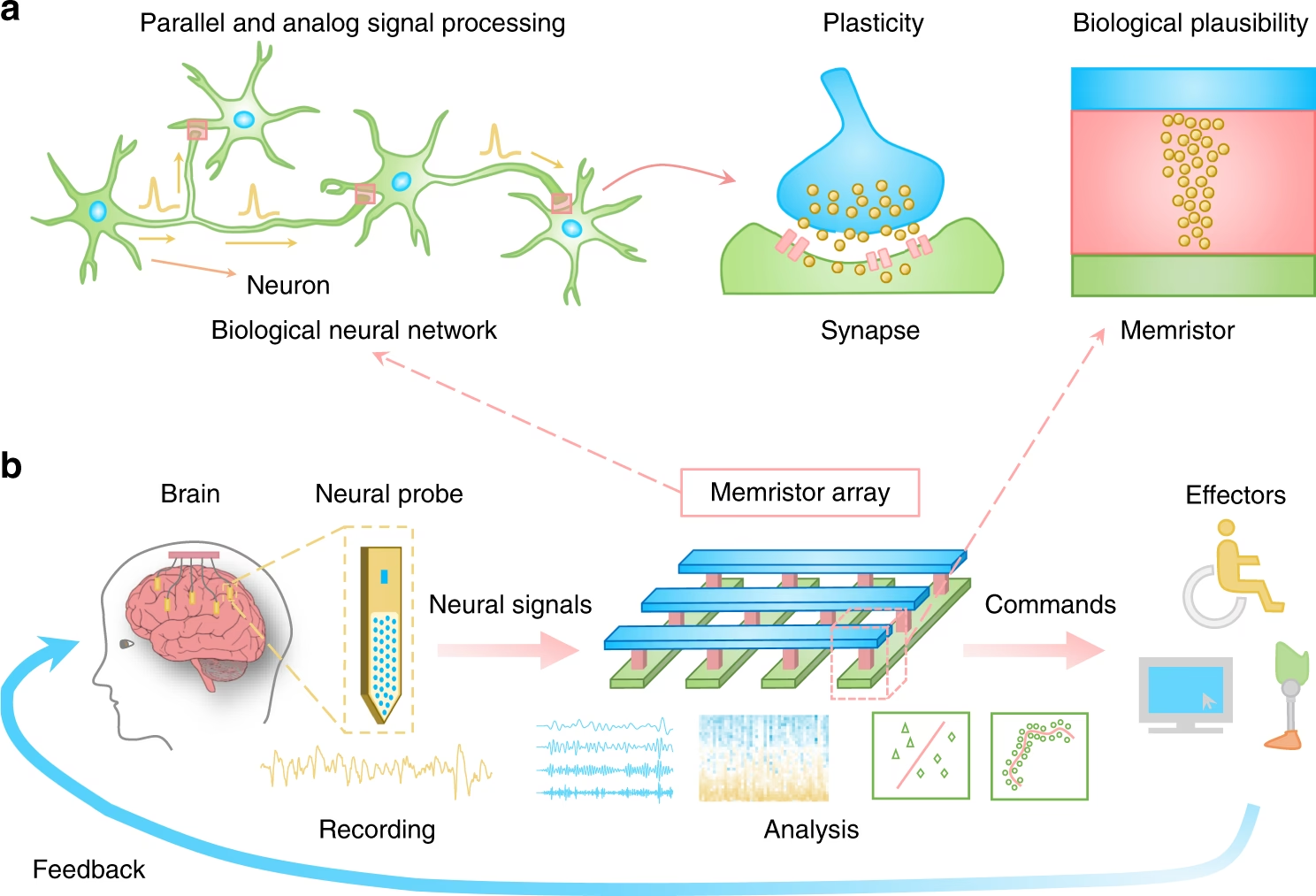

En esencia, el procesamiento de señales neurofisiológicas en el contexto de las BCI es el proceso mediante el cual se registran, analizan y transforman las señales cerebrales para derivar comandos que controlen un dispositivo. No se trata simplemente de capturar la actividad eléctrica, sino de extraer información significativa de ella y convertirla en acciones útiles. Este proceso es el corazón de cualquier sistema BCI efectivo y se divide generalmente en dos componentes principales.

- Los Dos Pilares del Procesamiento de Señales en BCI

- La Importancia Crítica de la Adaptación

- Evaluación Online vs. Offline: La Prueba de Fuego

- Tipos de Procesamiento de Señales (Contexto Amplio)

- Comparativa: Algoritmos Simples vs. Complejos en BCI y Adaptación

- Preguntas Frecuentes sobre el Procesamiento de Señales Neurofisiológicas

- ¿Qué tipos de señales cerebrales se procesan en BCI?

- ¿Por qué es necesario el procesamiento de señales?

- ¿Es lo mismo el procesamiento de señales en BCI que el procesamiento de señales de una neurona individual?

- ¿Cómo aprende un sistema BCI a entender las señales de un usuario?

- ¿Puede el procesamiento de señales neurofisiológicas ayudar en el diagnóstico médico?

- Conclusión

Los Dos Pilares del Procesamiento de Señales en BCI

El procesamiento de señales en una BCI se estructura típicamente en dos fases interconectadas. Ambas son cruciales para asegurar que la interfaz pueda interpretar correctamente la intención del usuario a partir de su actividad cerebral.

Extracción de Características: Desvelando la Intención

La primera parte del procesamiento es la extracción de características. Esta fase consiste en identificar y medir aquellos aspectos específicos de las señales cerebrales que codifican la intención del usuario. Las señales crudas registradas por los electrodos (ya sean en el cuero cabelludo o implantados) son increíblemente ricas y contienen una vasta cantidad de información, pero solo una fracción de ella es relevante para el comando que el usuario desea ejecutar en un momento dado. La tarea de la extracción de características es separar el grano de la paja.

Las características que se extraen pueden variar enormemente dependiendo del tipo de señal cerebral que se esté registrando y del paradigma de BCI que se esté utilizando. Algunas características son relativamente simples de medir, como:

- La amplitud o latencia de potenciales evocados específicos, como el P300 (una respuesta cerebral que aparece unos 300 milisegundos después de un estímulo inesperado pero relevante).

- Las amplitudes o frecuencias de ritmos cerebrales particulares, como los ritmos sensoriomotores (ritmos mu y beta en el rango de 8-30 Hz que se modulan con la imaginación o ejecución de movimientos).

- Las tasas de disparo de neuronas corticales individuales, en el caso de registros intracorticales.

Otras características pueden ser más complejas, involucrando:

- Coherencias espectrales entre diferentes áreas cerebrales.

- Combinaciones ponderadas de medidas más simples.

La clave para un rendimiento efectivo de la BCI en esta etapa es enfocar la extracción en características que realmente reflejen la intención del usuario y hacerlo con la mayor precisión posible. Un error o imprecisión en la extracción de características en esta fase puede tener un impacto negativo significativo en el rendimiento general del sistema.

Algoritmos de Traducción: Del Pensamiento a la Acción

Una vez que las características relevantes han sido extraídas, la segunda parte del procesamiento es la aplicación de un algoritmo de traducción. Este algoritmo toma las características medidas y las convierte en comandos específicos para el dispositivo externo. Las características como la amplitud de un ritmo cerebral o la tasa de disparo neuronal se mapean a salidas concretas, como el movimiento de un cursor en una pantalla, la selección de un icono, o el control de una prótesis robótica.

Los algoritmos de traducción pueden variar en complejidad, desde transformaciones lineales simples de la señal de voltaje cruda hasta clasificadores no lineales complejos basados en redes neuronales. Históricamente, muchas arquitecturas de procesamiento de señales en BCI consistían en una serie de bloques de construcción individuales, como filtros espaciales, filtros espectrales y clasificadores. Cada uno de estos bloques se optimizaba a menudo de forma aislada, basándose en sus propios criterios, sin una referencia directa al rendimiento general del sistema BCI.

Este enfoque modular, aunque intuitivo, a menudo limitaba la capacidad de las BCI para aprovechar todo el potencial de enfoques más potentes del aprendizaje automático moderno. Por ejemplo, la simple sustitución de un clasificador por uno más sofisticado a menudo no resultaba en una mejora significativa del rendimiento, porque el nivel de rendimiento ya estaba limitado por la forma en que se habían extraído y pre-procesado las características en etapas anteriores, optimizadas bajo criterios distintos.

Sin embargo, ha habido una tendencia alentadora reciente en la literatura de procesamiento de señales para BCI. Esta tendencia se aleja de los enfoques combinados y avanza hacia arquitecturas cuyas etapas de procesamiento tienen un contexto estadístico más coherente en todo el flujo, y que están específicamente adaptadas a la naturaleza particular de las características que se están utilizando. Este enfoque integrado puede permitir que el sistema se optimice de manera más holística para la tarea final: la traducción precisa de la intención del usuario a comandos.

La Importancia Crítica de la Adaptación

Un algoritmo de traducción exitoso no solo debe ser capaz de mapear las características a comandos, sino que también debe asegurar que el rango de control que el usuario tiene sobre las características elegidas sea suficiente para permitir la selección de toda la gama de comandos disponibles en la aplicación. Consideremos el ejemplo proporcionado en la información base: si la característica es la amplitud de un ritmo beta (21-24 Hz) sobre la corteza sensoriomotora izquierda, y el usuario puede modular esta amplitud en un rango de 1 a 5 µV para controlar el movimiento horizontal de un cursor, el algoritmo debe asegurarse de que este rango de 1 a 5 µV permita al usuario mover el cursor de un extremo a otro de la pantalla a una velocidad y con una duración compatibles con la capacidad de control del usuario sobre su ritmo beta.

Más allá de esto, un aspecto fundamental para la viabilidad a largo plazo de las BCI es la capacidad del algoritmo de traducción para adaptarse. La actividad cerebral de un usuario, y, por lo tanto, el rango y la naturaleza de las características que se pueden extraer, pueden variar significativamente debido a factores como el cambio diurno, la fatiga, el estado de ánimo, o el simple aprendizaje a lo largo del tiempo. Un algoritmo rígido que no pueda acomodar estas variaciones espontáneas o inducidas por el aprendizaje limitará severamente el rendimiento y la usabilidad del sistema.

Idealmente, el algoritmo de traducción no solo debería acomodar estos cambios, sino que también debería fomentarlos. Si, por ejemplo, el usuario mejora su capacidad de control sobre el ritmo beta y ahora puede modularlo en un rango de 1 a 8 µV en lugar de 1 a 5 µV, el algoritmo de traducción debería ser capaz de aprovechar esta mejora para aumentar la velocidad, la precisión o la granularidad del control del cursor. Esta adaptación continua refleja la importancia de la adaptación mutua entre el sistema y el usuario: el usuario aprende a modular sus señales de manera más efectiva, y el sistema aprende a interpretar mejor las señales cambiantes del usuario.

Evaluación Online vs. Offline: La Prueba de Fuego

La necesidad de una adaptación continua del algoritmo de traducción para acomodar los cambios en las características de la señal tiene implicaciones importantes para cómo se desarrollan y evalúan los algoritmos de procesamiento de señales para BCI.

En primer lugar, significa que los nuevos algoritmos no pueden ser evaluados adecuadamente únicamente mediante análisis offline (es decir, analizando conjuntos de datos de señales previamente grabadas). Si bien el análisis offline es útil para probar la viabilidad básica y comparar el rendimiento potencial en condiciones controladas, no captura la dinámica crucial de la interacción adaptativa entre el usuario y el sistema. Por lo tanto, los algoritmos también deben ser evaluados online, en tiempo real y con la participación activa del usuario, para determinar los efectos de sus interacciones adaptativas.

Esta evaluación online no debe limitarse a sesiones cortas. Las interacciones adaptativas importantes, tanto del usuario aprendiendo a usar la BCI como del algoritmo ajustándose a las señales del usuario, a menudo se desarrollan gradualmente a lo largo de múltiples sesiones o días. Por lo tanto, se requiere una evaluación online a largo plazo para comprender verdaderamente el potencial y las limitaciones de un algoritmo.

En segundo lugar, la necesidad de adaptación continua confiere una ventaja a aquellos algoritmos que permiten implementar dicha adaptación de manera más sencilla y robusta. A menudo, se ha demostrado que algoritmos más simples, como los clasificadores lineales, cumplen mejor este requisito que alternativas más complejas (por ejemplo, muchas soluciones basadas en redes neuronales). Esto no significa que los algoritmos complejos no sean útiles, pero sí subraya que su mayor complejidad debe justificarse.

Por lo tanto, los algoritmos simples solo deberían ser reemplazados por alternativas más complejas después de que las evaluaciones online a largo plazo (además de las offline) demuestren que las alternativas complejas pueden ofrecer un rendimiento superior sostenido sin la necesidad de procedimientos de recalibración continuos y laboriosos.

Tipos de Procesamiento de Señales (Contexto Amplio)

Aunque el enfoque principal aquí es el procesamiento de señales neurofisiológicas en BCI, cabe mencionar que el procesamiento de señales es un campo mucho más amplio dentro de la ingeniería y la informática. Históricamente, se pueden identificar varios tipos principales de procesamiento de señales:

- Procesamiento de Señales Analógicas: Se aplica a señales continuas en el tiempo y en amplitud, utilizando circuitos electrónicos analógicos (filtros pasivos/activos, mezcladores, etc.). Era la norma en sistemas de radio, televisión y telefonía del siglo XX.

- Procesamiento de Señales de Tiempo Continuo: Una disciplina teórica para señales definidas en un dominio continuo, sin puntos de interrupción. La convolución es una operación fundamental aquí.

- Procesamiento de Señales de Tiempo Discreto: Se aplica a señales muestreadas, definidas solo en puntos discretos en el tiempo, pero no cuantizadas en magnitud. Puede ser analógico (con dispositivos como circuitos de muestreo y retención) o digital.

- Procesamiento de Señales Digitales (DSP): El procesamiento de señales de tiempo discreto que además han sido cuantizadas en magnitud (digitalizadas). Se realiza utilizando computadoras o hardware especializado (DSPs, FPGAs). Es el campo que floreció con la llegada de los procesadores digitales en los 80 y utiliza algoritmos como la Transformada Rápida de Fourier (FFT), filtros FIR, filtros IIR, etc. Es el más relevante para las BCI modernas.

- Procesamiento de Señales No Lineales: Analiza y procesa señales de sistemas no lineales, que pueden mostrar comportamientos complejos (caos, armónicos) no abordables con métodos lineales.

- Procesamiento de Señales Estadísticas: Trata las señales como procesos estocásticos, utilizando sus propiedades estadísticas (distribuciones de probabilidad, modelos) para realizar tareas de procesamiento.

- Procesamiento de Señales en Grafos: Generaliza las tareas de procesamiento a señales definidas en dominios no euclidianos cuya estructura puede representarse como un grafo ponderado. Tiene aplicaciones en imágenes, visión artificial y detección de anomalías.

El procesamiento de señales neurofisiológicas en BCI se enmarca principalmente dentro del Procesamiento de Señales Digitales y a menudo incorpora técnicas de procesamiento de señales estadísticas y, en algunos casos, enfoques no lineales, todo ello aplicado a señales biológicas (neurofisiológicas).

Comparativa: Algoritmos Simples vs. Complejos en BCI y Adaptación

La elección entre algoritmos de traducción simples y complejos en BCI a menudo implica un equilibrio, especialmente cuando se considera la necesidad de adaptación a largo plazo.

| Característica | Algoritmos Simples (Ej: Lineales) | Algoritmos Complejos (Ej: Redes Neuronales) |

|---|---|---|

| Complejidad Matemática | Baja | Alta |

| Potencial de Rendimiento Inicial | Puede ser limitado en tareas muy complejas | Potencialmente alto para capturar relaciones no lineales |

| Facilidad de Implementación de Adaptación | Generalmente más fácil y robusta | A menudo más difícil, requiere más datos o técnicas específicas |

| Necesidad de Recalibración | Puede requerir menos recalibración frecuente a largo plazo si la adaptación es efectiva | Puede requerir recalibración más laboriosa o frecuente sin una adaptación robusta |

| Transparencia/Interpretación | Más fáciles de entender cómo toman decisiones | A menudo son "cajas negras", difíciles de interpretar |

Esta tabla resalta por qué, a pesar del atractivo potencial de los modelos complejos, los algoritmos más simples a menudo han demostrado ser más prácticos para sistemas BCI que necesitan operar de manera fiable durante períodos prolongados y adaptarse a un usuario cambiante.

Preguntas Frecuentes sobre el Procesamiento de Señales Neurofisiológicas

Aquí respondemos algunas dudas comunes sobre este tema:

¿Qué tipos de señales cerebrales se procesan en BCI?

Se pueden procesar diversas señales, incluyendo el Electroencefalograma (EEG), que mide la actividad eléctrica en el cuero cabelludo; el Electrocorticograma (ECoG), que mide la actividad directamente desde la superficie del cerebro; y la actividad de unidades individuales (neuronas), registrada con microelectrodos implantados.

¿Por qué es necesario el procesamiento de señales?

Las señales registradas son a menudo ruidosas, contienen artefactos (como movimiento muscular o parpadeo) y la información relevante para la intención del usuario está mezclada con mucha actividad irrelevante. El procesamiento es necesario para limpiar la señal, aislar las características de interés y traducirlas a comandos utilizables por un dispositivo.

¿Es lo mismo el procesamiento de señales en BCI que el procesamiento de señales de una neurona individual?

Aunque ambos implican analizar actividad biológica eléctrica, el procesamiento en BCI generalmente se refiere al análisis de señales a nivel de poblaciones neuronales (como se ve en EEG o ECoG) o la tasa de disparo de múltiples neuronas para inferir una intención compleja. El procesamiento de señales de una neurona individual puede referirse más específicamente al análisis de potenciales de acción (spikes) para entender su patrón de disparo, codificación de información o interacción con otras neuronas, a menudo en un contexto de investigación básica o en BCI que usan registros de unidades individuales.

¿Cómo aprende un sistema BCI a entender las señales de un usuario?

Típicamente, los sistemas BCI pasan por una fase de entrenamiento o calibración donde el usuario realiza tareas mentales específicas (imaginando movimientos, prestando atención a estímulos) mientras se registran sus señales. El algoritmo de traducción aprende a asociar los patrones de actividad cerebral (las características extraídas) con los comandos deseados. La adaptación continua durante el uso real permite que el sistema se ajuste a cambios a lo largo del tiempo.

¿Puede el procesamiento de señales neurofisiológicas ayudar en el diagnóstico médico?

Sí, las técnicas de procesamiento de señales aplicadas a datos neurofisiológicos (como EEG, potenciales evocados) son herramientas estándar en neurología para diagnosticar condiciones como epilepsia, trastornos del sueño, neuropatías y para evaluar la función sensorial o cognitiva.

Conclusión

El procesamiento de señales neurofisiológicas es la piedra angular de las Interfaces Cerebro-Computadora, transformando la compleja actividad eléctrica del cerebro en comandos funcionales para dispositivos externos. A través de la extracción precisa de características relevantes y el uso de algoritmos de traducción adaptativos, los sistemas BCI buscan establecer un canal de comunicación intuitivo y fiable entre la mente y la máquina. La evolución hacia enfoques de procesamiento más integrados y la creciente comprensión de la necesidad de adaptación continua son pasos cruciales para llevar las BCI desde el laboratorio a aplicaciones prácticas que puedan mejorar significativamente la vida de las personas, especialmente aquellas con discapacidades motoras severas. El campo sigue avanzando, impulsado por la innovación en algoritmos y una comprensión más profunda de cómo el cerebro codifica la intención.

Si quieres conocer otros artículos parecidos a Procesamiento Señales Neurofisiológicas puedes visitar la categoría Neurociencia.