El aprendizaje por refuerzo es un proceso fundamental en la neurociencia que describe cómo un organismo, ya sea un animal o un ser humano, utiliza su experiencia previa para mejorar los resultados de sus elecciones futuras. Se trata de un mecanismo adaptativo esencial para la supervivencia y el comportamiento dirigido a metas.

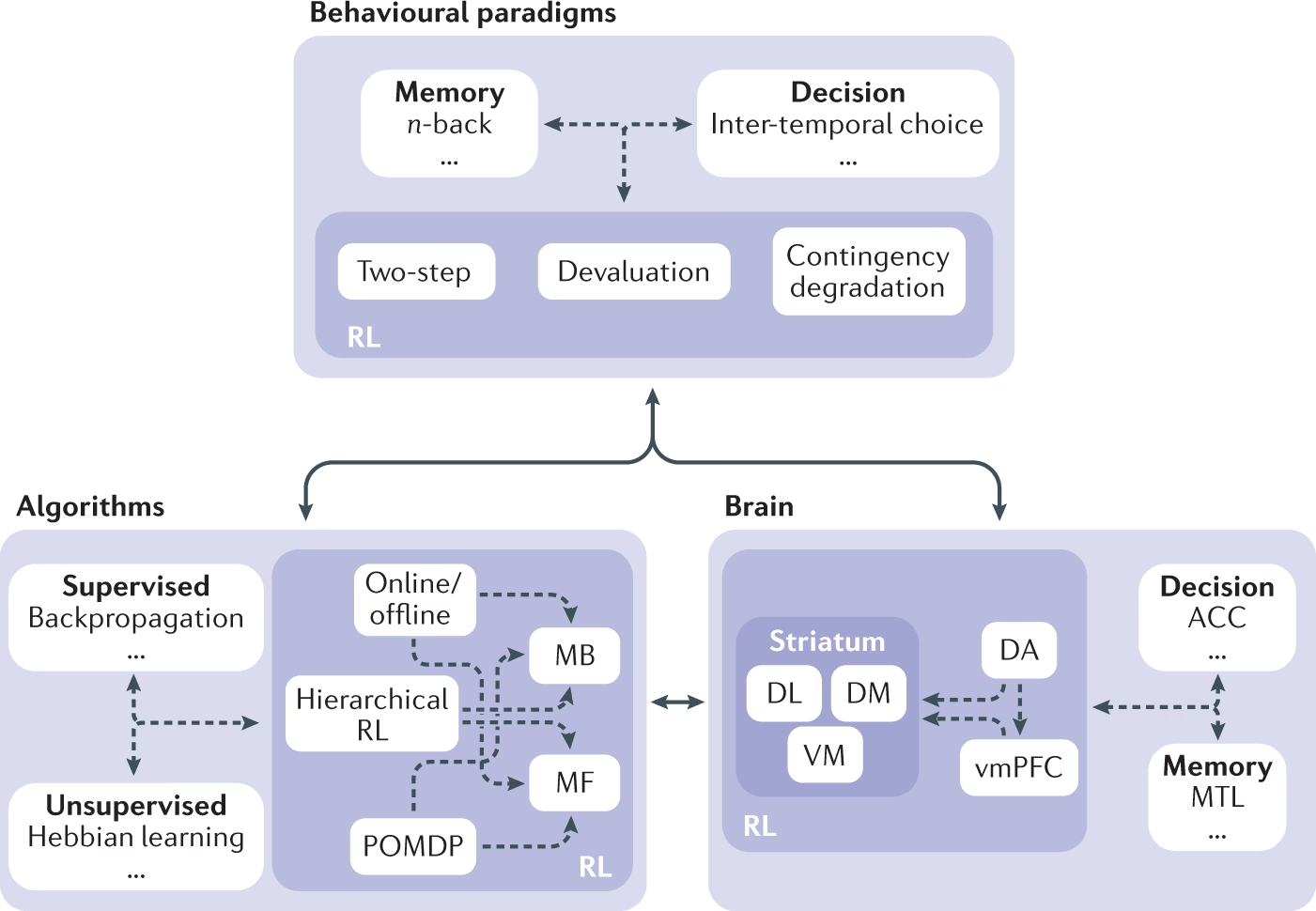

Las teorías computacionales del aprendizaje por refuerzo desempeñan un papel central en áreas emergentes como la neuroeconomía y la neurociencia de la toma de decisiones. Dentro de este marco, las acciones se seleccionan basándose en sus funciones de valor, que cuantifican la recompensa futura esperada de cada acción. Estas funciones de valor no solo se ajustan a través de la recompensa y el castigo directos, sino también mediante el conocimiento que el organismo tiene de su entorno actual. Diversos estudios han demostrado que una gran proporción del cerebro está involucrada en la representación, actualización y uso de estas funciones de valor para la elección de acciones. Sin embargo, la comprensión completa de cómo la naturaleza específica de una tarea conductual afecta los mecanismos neuronales subyacentes al aprendizaje por refuerzo sigue siendo un desafío. La investigación futura busca desentrañar los principios por los cuales los diferentes elementos computacionales del aprendizaje por refuerzo se coordinan dinámicamente a través de todo el cerebro.

Fundamentos Teóricos: Economía vs. Aprendizaje por Refuerzo

La toma de decisiones, el proceso por el cual un organismo elige sus acciones, ha sido un campo de estudio en diversas disciplinas como las matemáticas, la economía, la psicología y la neurociencia. Tradicionalmente, las teorías de la toma de decisiones se han dividido en dos categorías principales.

Por un lado, las teorías normativas en economía, como la teoría de la utilidad esperada (desarrollada por von Neumann y Morgenstern), generan criterios bien definidos para identificar las mejores opciones. Estas teorías se centran en elecciones dentro de un contexto idealizado y a menudo no logran explicar las elecciones reales realizadas por humanos y animales.

Por otro lado, las teorías psicológicas descriptivas intentan explicar las fallas de las teorías normativas identificando un conjunto de reglas heurísticas aplicadas por quienes toman decisiones. Por ejemplo, la teoría de la perspectiva (propuesta por Kahneman y Tversky) puede explicar con éxito las desviaciones de la teoría de la utilidad esperada en la descripción de la toma de decisiones humanas bajo incertidumbre.

Estos dos marcos teóricos, aunque complementarios y esenciales para los estudios neurobiológicos de la toma de decisiones, a menudo no abordan una pregunta fundamental: el papel del aprendizaje. ¿Cómo adquieren los humanos y los animales sus preferencias por diferentes acciones y resultados en primer lugar? Aquí es donde las teorías del aprendizaje por refuerzo ofrecen una perspectiva crucial.

Teorías del Aprendizaje por Refuerzo en la Toma de Decisiones

Mientras que las teorías económicas se centran en asignar números (utilidades) a las acciones alternativas para que las elecciones puedan entenderse como la selección de la acción con el valor máximo, siendo estas utilidades en gran parte agnósticas sobre cómo se determinan (aunque se presume que están influenciadas por la evolución y la experiencia individual), las teorías del aprendizaje por refuerzo describen explícitamente cómo la experiencia de un organismo altera sus funciones de valor, que a su vez influyen en las elecciones subsiguientes.

El objetivo principal del aprendizaje por refuerzo es maximizar las recompensas futuras acumuladas a lo largo del tiempo. Análogamente a las utilidades económicas, las funciones de valor en la teoría del aprendizaje por refuerzo se refieren a las estimaciones de la suma de recompensas futuras. Sin embargo, a diferencia de las utilidades teóricas, las funciones de valor reflejan las estimaciones empíricas del organismo sobre sus recompensas futuras, dado que no puede predecir perfectamente los cambios en su entorno. Las recompensas distantes en el futuro a menudo se descuentan temporalmente, lo que significa que las recompensas más inmediatas ejercen una influencia más fuerte en el comportamiento del organismo.

Tipos de Funciones de Valor

La teoría del aprendizaje por refuerzo utiliza principalmente dos tipos de funciones de valor:

- Función de Valor de Acción (Q(s,a)): Se refiere a la suma de recompensas futuras esperadas por tomar una acción particular ('a') en un estado particular del entorno ('s'). El término acción es amplio; puede ser una acción física o una elección abstracta.

- Función de Valor de Estado (V(s)): Se refiere a la suma de recompensas futuras esperadas a partir de un estado particular ('s') del entorno del organismo. Si un organismo siempre elige solo una acción en un estado dado, entonces su función de valor de acción sería igual a la función de valor de estado. De lo contrario, la función de valor de estado correspondería al promedio de las funciones de valor de acción ponderado por la probabilidad de tomar cada acción en ese estado.

Aunque las funciones de valor de estado pueden usarse para evaluar los resultados de las acciones, en general, las funciones de valor de acción son necesarias para seleccionar una acción específica.

| Característica | Utilidad (Teoría Económica) | Función de Valor (Teoría Aprendizaje por Refuerzo) |

|---|---|---|

| Definición | Medida teórica de deseabilidad de una acción/resultado. | Estimación empírica de la suma de recompensas futuras esperadas. |

| Origen/Actualización | Agnóstico (evolución, experiencia individual). | Alterada explícitamente por la experiencia (recompensa, castigo, conocimiento del entorno). |

| Uso en Decisión | Seleccionar acción que maximice la utilidad. | Influir en la probabilidad de elegir acciones (a menudo probabilísticamente). |

| Naturaleza | Idealizada, a menudo no explica elecciones reales. | Refleja las estimaciones del organismo, sujeta a incertidumbre. |

Elementos Clave del Aprendizaje por Refuerzo

Más allá del agente (el organismo que aprende) y el entorno con el que interactúa, se pueden identificar cuatro subelementos principales en un sistema de aprendizaje por refuerzo:

- Política: Define la forma de comportarse del agente en un momento dado. Es, en esencia, un mapeo de los estados percibidos del entorno a las acciones a tomar en esos estados. Corresponde a lo que en psicología se llamaría un conjunto de reglas o asociaciones estímulo-respuesta. La política es el núcleo del agente de aprendizaje por refuerzo, ya que por sí sola es suficiente para determinar el comportamiento. Las políticas pueden ser estocásticas.

- Función de Recompensa: Define el objetivo del problema de aprendizaje por refuerzo. Mapea cada estado percibido (o par estado-acción) a un único número (la recompensa) que indica la deseabilidad intrínseca inmediata de ese estado. El único objetivo del agente es maximizar la recompensa total que recibe a largo plazo. La función de recompensa define qué son los eventos buenos y malos para el agente. Es inalterable por el agente mismo, pero sirve como base para modificar la política.

- Función de Valor: Especifica qué es bueno a largo plazo. Es la cantidad total de recompensa que un agente puede esperar acumular en el futuro, comenzando desde un estado particular. Mientras que las recompensas indican la deseabilidad inmediata, los valores indican la deseabilidad a largo plazo después de considerar los estados futuros probables y las recompensas disponibles en ellos. Los valores son predicciones de recompensas y son fundamentales para la toma de decisiones y la evaluación de opciones. Estimar eficientemente los valores es el componente más importante de casi todos los algoritmos de aprendizaje por refuerzo.

- Modelo del Entorno (Opcional): Es algo que imita el comportamiento del entorno. Por ejemplo, dado un estado y una acción, el modelo podría predecir el siguiente estado resultante y la siguiente recompensa. Los modelos se utilizan para la planificación, que implica decidir un curso de acción considerando posibles situaciones futuras antes de experimentarlas realmente. La incorporación de modelos y planificación es un desarrollo relativamente nuevo en el aprendizaje por refuerzo.

La distinción entre recompensa y valor es crucial. Las recompensas son, en cierto sentido, primarias, dadas directamente por el entorno. Los valores, como predicciones de recompensas, son secundarios y deben ser estimados y reestimados a partir de secuencias de observaciones a lo largo de la vida del agente. Aunque las recompensas son la base, son los valores los que más nos importan al tomar decisiones, ya que buscamos acciones que conduzcan a estados de mayor valor para obtener la mayor recompensa a largo plazo.

Mecanismos Neurales del Aprendizaje por Refuerzo

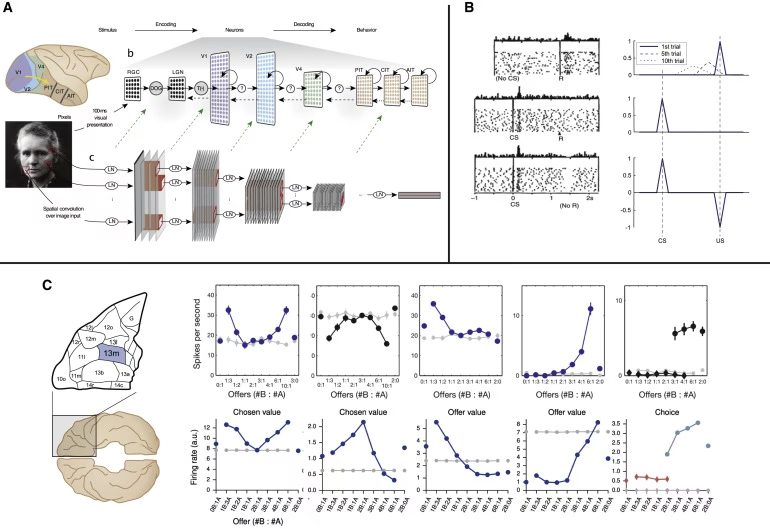

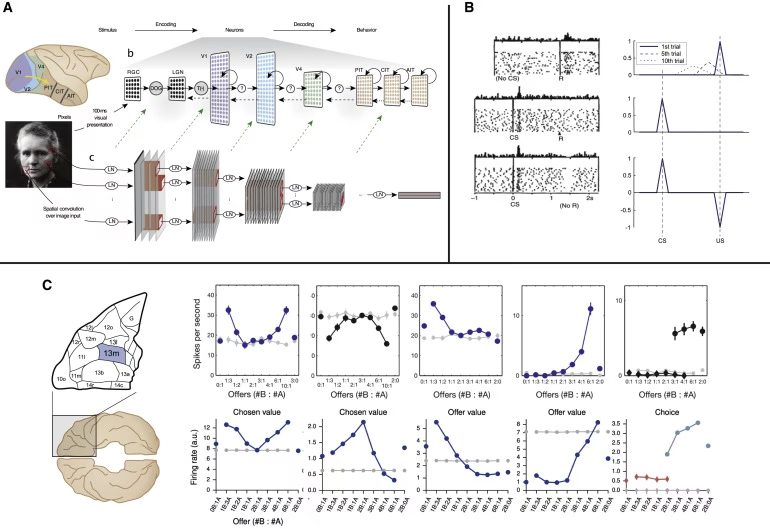

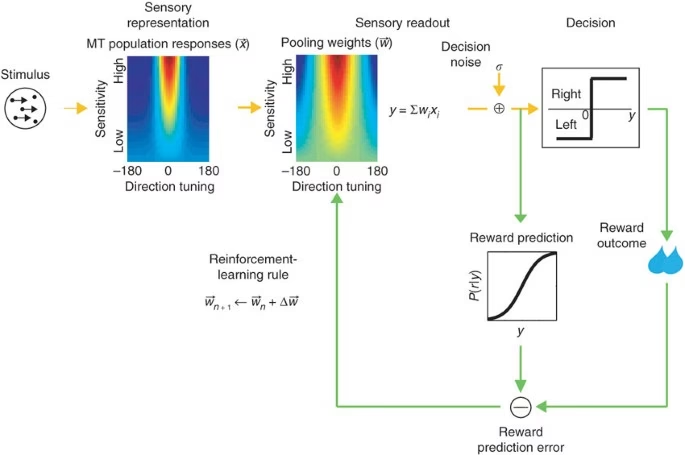

La investigación en neurociencia ha revelado que el aprendizaje por refuerzo involucra múltiples regiones cerebrales interconectadas, particularmente en la corteza frontal y los ganglios basales. Estas áreas parecen ser cruciales para representar y actualizar las estimaciones de recompensa esperada basadas en la experiencia del organismo. Sin embargo, la forma exacta en que la naturaleza de una tarea conductual específica influye en estos mecanismos neurales aún se está investigando.

Una pregunta clave es cómo las señales de valor para las acciones potenciales se transforman en la respuesta conductual final. Los estudios sugieren que las interacciones competitivas entre diferentes grupos de neuronas recurrentemente conectadas son un mecanismo probable para este proceso de selección de acciones, aunque sus sustratos neuroanatómicos precisos no están completamente dilucidados.

Aprendizaje Basado en Modelos vs. Libre de Modelos

Los humanos y los animales no solo aprenden de la experiencia directa de recompensa y castigo (lo que se conoce como aprendizaje por refuerzo libre de modelos), sino que también pueden adquirir conocimiento sobre su entorno sin experimentar directamente esos resultados. Este conocimiento puede ser utilizado para influir en comportamientos posteriores, un proceso llamado aprendizaje por refuerzo basado en modelos. Por ejemplo, un organismo podría aprender la estructura causal de su entorno y usar este 'modelo' para planificar acciones óptimas incluso en situaciones novedosas.

Estudios recientes han comenzado a arrojar luz sobre cómo estos dos tipos diferentes de aprendizaje por refuerzo, el basado en modelos y el libre de modelos, están vinculados e interactúan en el cerebro. Comprender esta interacción es un área activa de investigación futura.

Aprendizaje por Refuerzo en Redes Neuronales Artificiales

En el ámbito de la inteligencia artificial, el aprendizaje por refuerzo se define como un enfoque computacional dirigido a objetivos en el que un agente aprende a realizar una tarea interactuando con un entorno dinámico. Este enfoque permite al agente tomar una serie de decisiones para maximizar la recompensa acumulada sin intervención humana directa y sin ser programado explícitamente para alcanzar un objetivo.

En este contexto, el agente típicamente contiene dos componentes: una política y un algoritmo de aprendizaje. La política es un mapeo que selecciona acciones basándose en las observaciones del entorno. Frecuentemente, la política se implementa como un aproximador de función con parámetros ajustables, como una red neuronal profunda. El algoritmo de aprendizaje actualiza continuamente los parámetros de la política basándose en las acciones tomadas, las observaciones recibidas y la recompensa obtenida. El objetivo es encontrar una política óptima que maximice la recompensa acumulada durante la tarea.

El proceso implica que el agente aprende el comportamiento óptimo a través de interacciones repetidas de ensayo y error con el entorno. La recompensa actúa como una medida del éxito de una acción en relación con el objetivo final de la tarea.

Un ejemplo común es el estacionamiento automatizado de un vehículo. El ordenador del vehículo (agente) utiliza lecturas de sensores (observaciones) para generar comandos de dirección, frenado, etc. (acciones). Estos comandos afectan el entorno (vehículo, carretera, viento, etc.), lo que a su vez produce nuevas observaciones y una señal de recompensa (por ejemplo, uno si el estacionamiento es exitoso, cero en caso contrario). El ordenador aprende la política (el mapeo de observaciones a acciones) mediante ensayo y error, actualizándola para maximizar la recompensa.

Aprendizaje por Refuerzo vs. Neuroevolución

Es importante distinguir el aprendizaje por refuerzo, tal como se describe en la mayor parte de la neurociencia y la inteligencia artificial, de la neuroevolución. La neuroevolución se refiere a algoritmos que utilizan métodos evolutivos (como algoritmos genéticos) para desarrollar redes neuronales, ya sea evolucionando solo la fuerza de las conexiones (neuroevolución convencional) o evolucionando tanto la topología como los pesos (TWEANNs).

Mientras que la mayoría de las redes neuronales artificiales modernas se entrenan utilizando algoritmos basados en gradientes (como el descenso de gradiente), la neuroevolución ofrece una alternativa. Algunas investigaciones, como las realizadas en Uber, han sugerido que algoritmos simples de neuroevolución estructural pueden ser competitivos con métodos de deep learning basados en gradiente, en parte porque la neuroevolución podría ser menos propensa a quedarse atascada en mínimos locales y se beneficia del aumento de la capacidad computacional.

Una distinción clave en neuroevolución es entre esquemas de codificación directa e indirecta. En la codificación directa, el genotipo (la representación evolutiva) mapea explícitamente cada neurona y conexión en el fenotipo (la red neuronal). En contraste, la codificación indirecta especifica indirectamente cómo se debe generar la red, a menudo utilizando enfoques de embriogénesis artificial para lograr modularidad, compresión y un mapeo más eficiente del espacio de búsqueda al dominio del problema.

Aunque la neuroevolución puede resolver problemas que a veces se abordan con aprendizaje por refuerzo, la definición estricta de aprendizaje por refuerzo utilizada en gran parte de la literatura implica el aprendizaje a través de la interacción *durante la vida individual* del agente, utilizando feedback de recompensa para actualizar una política o funciones de valor. Los métodos evolutivos, por otro lado, a menudo operan buscando directamente en el espacio de políticas sin usar funciones de valor y sin aprender en tiempo real a partir de interacciones detalladas con el entorno. Por lo tanto, aunque relacionados en el objetivo de lograr comportamientos hábiles, son enfoques metodológicamente distintos.

| Característica | Aprendizaje por Refuerzo | Neuroevolución |

|---|---|---|

| Mecanismo Principal | Aprendizaje basado en feedback de recompensa/castigo durante la interacción con el entorno. | Evolución de redes neuronales (pesos, topología) a través de algoritmos genéticos/evolutivos. |

| Uso de Valor/Política | Central: Estimación de funciones de valor y actualización de la política basada en el feedback. | Puede buscar directamente en el espacio de políticas; a menudo no usa funciones de valor explícitas. |

| Base Biológica Análoga | Aprendizaje individual, condicionamiento. | Evolución biológica de estructuras neurales. |

| Aprendizaje en Tiempo Real | Sí, el agente aprende y adapta su comportamiento durante su 'vida'. | Generalmente no; la adaptación ocurre entre 'generaciones' de redes. |

| Ejemplos | Algoritmos Q-learning, SARSA, Actor-Critic. | NEAT, HyperNEAT. |

Preguntas Frecuentes

¿Dónde se procesa el aprendizaje por refuerzo en el cerebro?

La investigación sugiere que el aprendizaje por refuerzo involucra una red de regiones cerebrales interconectadas, destacando particularmente la corteza frontal y los ganglios basales como áreas clave para la representación y actualización de las funciones de valor.

¿Cuál es la diferencia entre recompensa y valor?

La recompensa es la señal inmediata de deseabilidad de un estado o acción, dada directamente por el entorno. El valor, en cambio, es una estimación a largo plazo de la recompensa total esperada a partir de un estado o acción, teniendo en cuenta futuras interacciones con el entorno. Las recompensas son primarias; los valores son predicciones de recompensas futuras y guían la toma de decisiones a largo plazo.

¿El aprendizaje por refuerzo es lo mismo que la neuroevolución?

No, son enfoques distintos aunque ambos pueden usarse para desarrollar agentes capaces de realizar tareas. El aprendizaje por refuerzo se basa en que un agente aprenda y adapte su comportamiento en tiempo real a través de la interacción y el feedback de recompensa. La neuroevolución utiliza algoritmos evolutivos para buscar en el espacio de posibles redes neuronales, con la adaptación ocurriendo entre generaciones, no durante la vida individual de una red.

Conclusión

El aprendizaje por refuerzo es un marco poderoso y flexible para comprender cómo los organismos aprenden a tomar decisiones óptimas basadas en la experiencia. Desde su fundamentación teórica, contrastando con enfoques económicos y psicológicos, hasta su implementación en circuitos neuronales específicos del cerebro (como la corteza frontal y los ganglios basales) y su aplicación en sistemas de inteligencia artificial, el aprendizaje por refuerzo es un campo interdisciplinario vital.

La distinción entre diferentes tipos de funciones de valor (acción y estado) y la comprensión de los elementos clave (política, recompensa, valor, modelo) son esenciales para su estudio. A pesar de los avances significativos, aún queda mucho por descubrir, particularmente sobre la coordinación dinámica de los procesos de aprendizaje por refuerzo en todo el cerebro y la interacción compleja entre el aprendizaje libre de modelos y el basado en modelos. La investigación futura continuará desentrañando los principios neurobiológicos que subyacen a nuestra asombrosa capacidad para aprender de la experiencia y adaptar nuestro comportamiento.

Si quieres conocer otros artículos parecidos a Neurociencia y Aprendizaje por Refuerzo puedes visitar la categoría Neurociencia.