El estudio del cerebro y, por extensión, el desarrollo de modelos computacionales que imiten su capacidad para procesar información secuencial, ha llevado a avances significativos en el campo de las redes neuronales artificiales. Uno de los desafíos centrales ha sido dotar a estas redes de una 'memoria' efectiva que les permita comprender contextos dependientes del tiempo o del orden, como ocurre en el lenguaje o en series temporales. Las redes neuronales recurrentes (RNNs) fueron un primer paso crucial, pero pronto se hizo evidente que tenían limitaciones importantes al tratar con dependencias a largo plazo. Aquí es donde entran en juego arquitecturas más sofisticadas, como las Unidades Recurrentes con Compuertas.

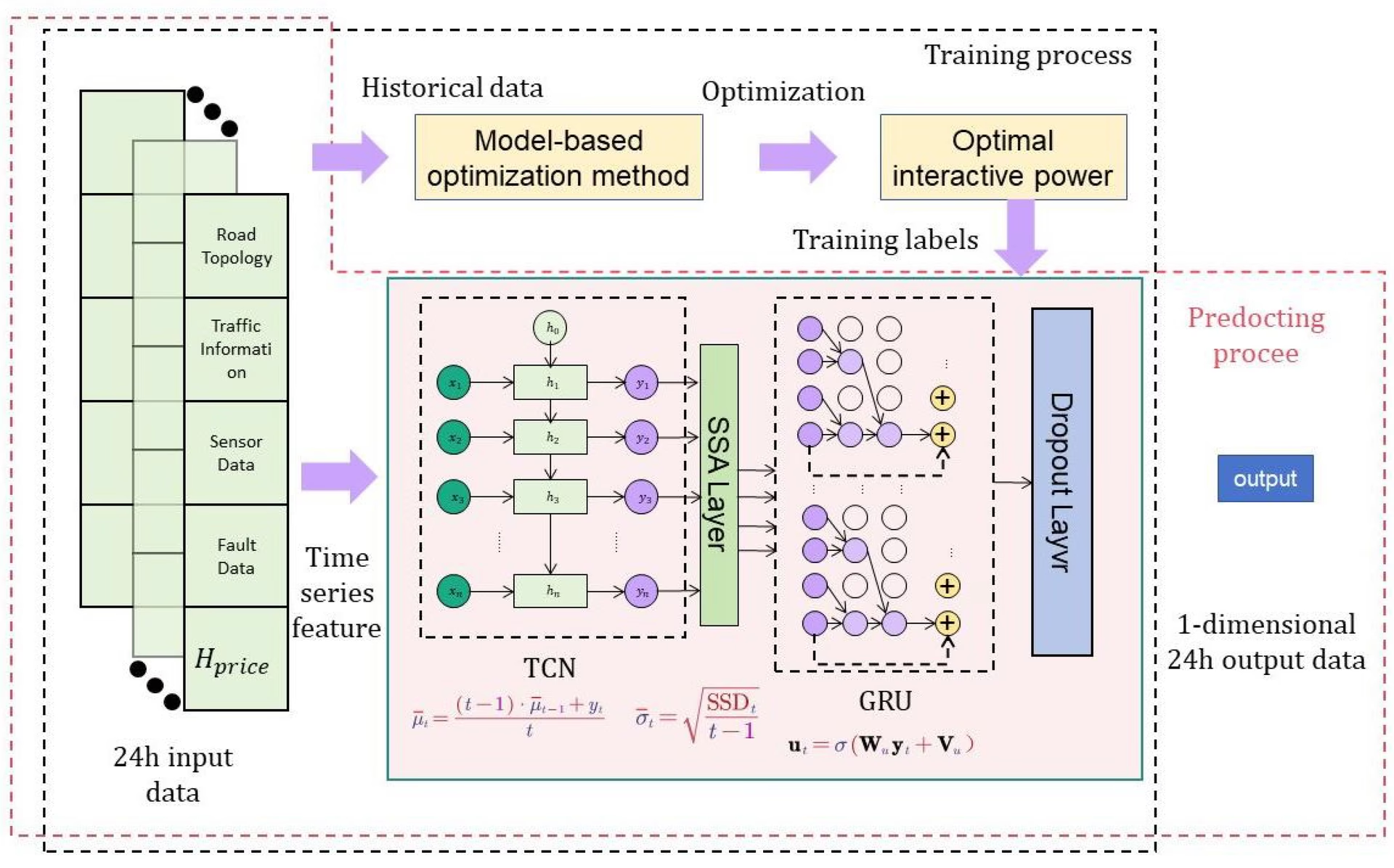

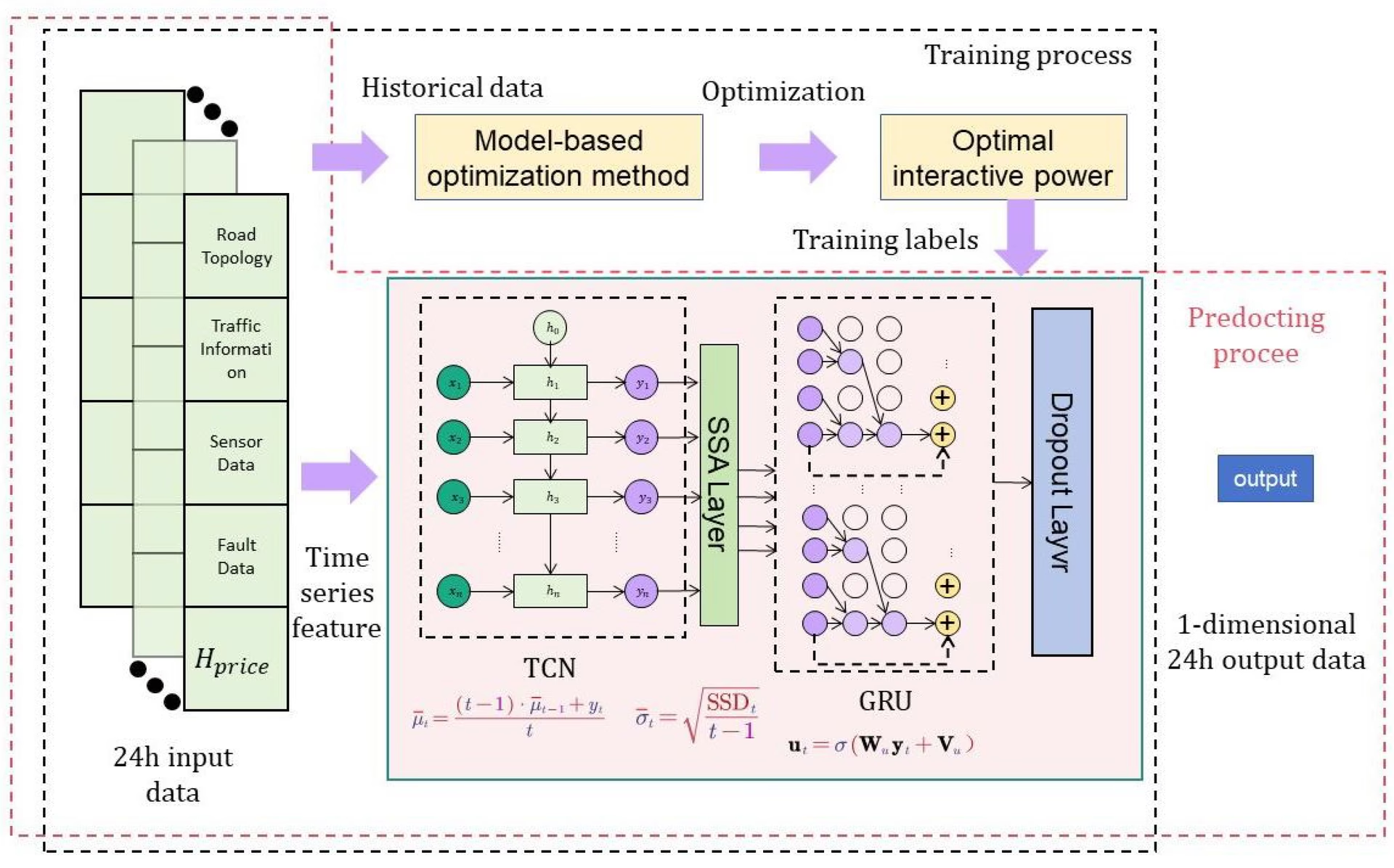

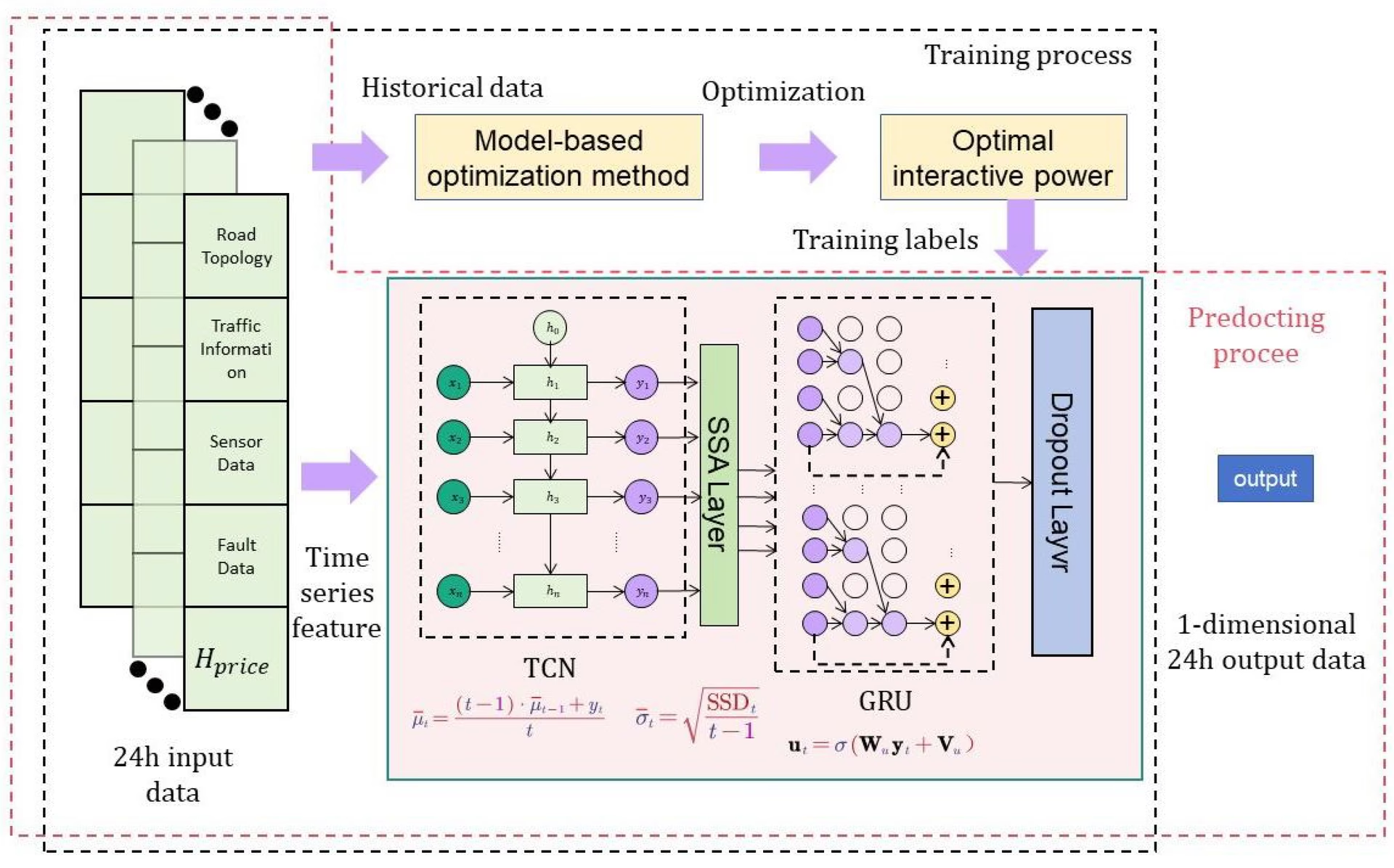

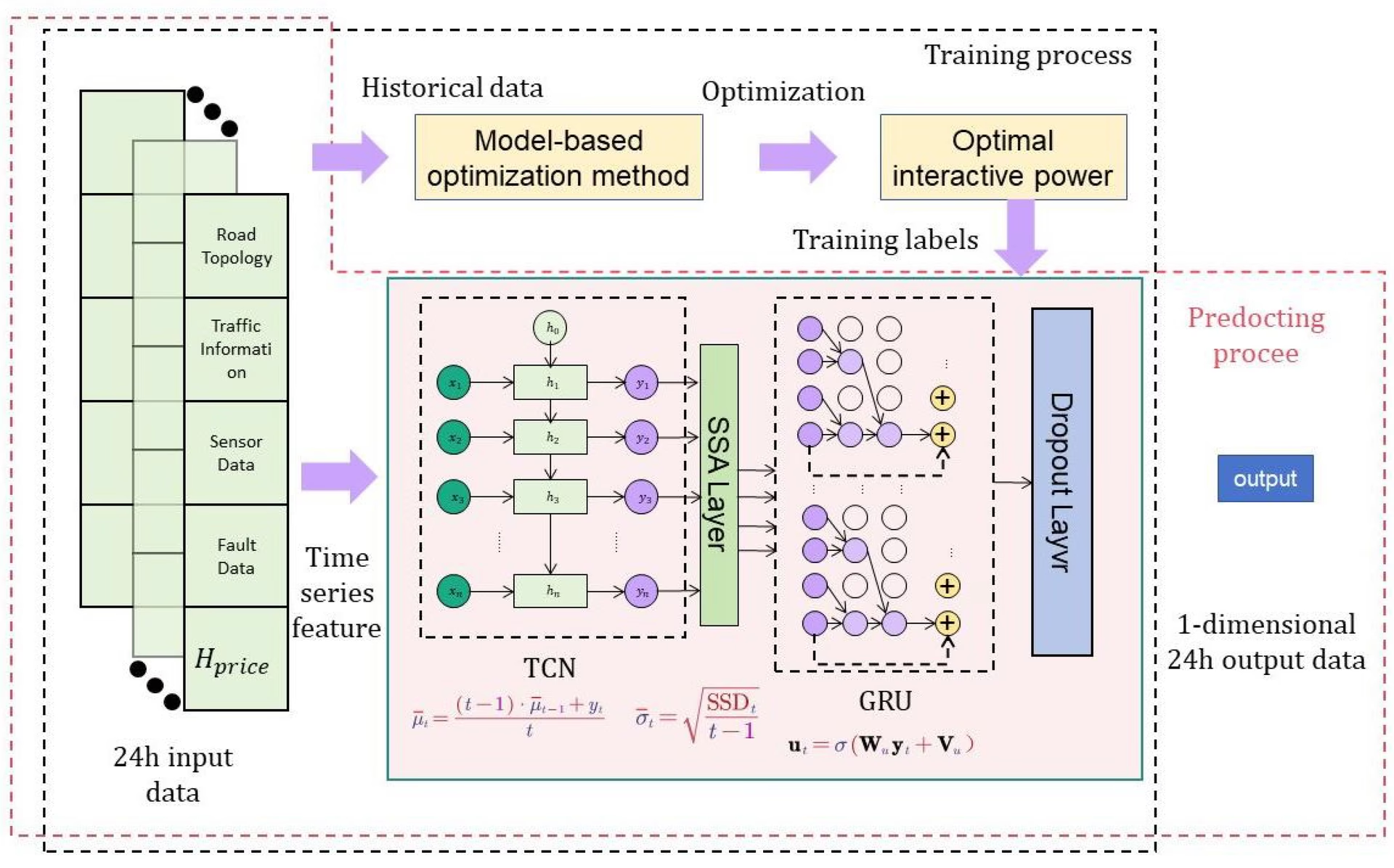

Las Unidades Recurrentes con Compuertas (GRUs) son un mecanismo de compuerta dentro de las redes neuronales recurrentes, introducidas en 2014 por Kyunghyun Cho y colaboradores. Surgieron como una alternativa más eficiente y simplificada a las redes de Memoria a Largo Corto Plazo (LSTM), que ya habían demostrado ser muy efectivas para manejar dependencias de larga distancia. Las GRUs comparten la idea fundamental de usar 'compuertas' para controlar el flujo de información, decidiendo qué datos se conservan, cuáles se olvidan y cuáles se actualizan en el estado interno de la red a medida que procesa una secuencia.

¿Qué son exactamente las GRUs?

En esencia, una GRU es una unidad dentro de una red recurrente que recibe una entrada en un momento dado (t) y el estado oculto de la unidad en el momento anterior (t-1). Utiliza este estado anterior y la nueva entrada para calcular un nuevo estado oculto (t). La clave de su funcionamiento reside en sus compuertas internas: la compuerta de actualización y la compuerta de reinicio. A diferencia de las LSTMs, que tienen tres compuertas (entrada, olvido y salida) y un estado de celda separado, las GRUs combinan la compuerta de olvido y entrada en una única compuerta de actualización y no tienen un estado de celda separado, integrando toda la información en el estado oculto.

Esta arquitectura simplificada se traduce en menos parámetros que ajustar durante el entrenamiento, lo que a menudo resulta en un entrenamiento más rápido y una menor necesidad de datos, sin sacrificar significativamente el rendimiento en muchas tareas. De hecho, estudios comparativos han encontrado que las GRUs pueden alcanzar un rendimiento similar al de las LSTMs en diversas aplicaciones, como el modelado de música, señales de voz y procesamiento del lenguaje natural.

¿Cómo funcionan las compuertas de una GRU?

El poder de las GRUs reside en su capacidad para gestionar la información a lo largo del tiempo mediante sus dos compuertas principales:

- Compuerta de Reinicio (Reset Gate): Esta compuerta decide cuánta información del estado oculto anterior es relevante para calcular el nuevo estado candidato. Produce un valor entre 0 y 1. Un valor cercano a 0 indica que se debe 'olvidar' la mayor parte del estado anterior, mientras que un valor cercano a 1 significa que se debe conservar casi todo. Esto permite a la red descartar información irrelevante del pasado que ya no es útil para la tarea actual.

- Compuerta de Actualización (Update Gate): Esta compuerta actúa como una combinación de las compuertas de olvido y entrada de una LSTM. Determina cuánto del estado oculto anterior se debe mantener y cuánto del nuevo estado candidato (calculado usando la compuerta de reinicio y la entrada actual) se debe incorporar al estado oculto final. También produce un valor entre 0 y 1. Un valor cercano a 1 significa que el nuevo estado oculto será principalmente el nuevo estado candidato, mientras que un valor cercano a 0 significa que se mantendrá en gran medida el estado oculto anterior.

Al controlar de manera selectiva qué información fluye a través de la unidad en cada paso de tiempo, las GRUs pueden mantener información relevante durante largos periodos y, al mismo tiempo, descartar lo que ya no es necesario. Este mecanismo es fundamental para superar una de las principales limitaciones de las RNNs tradicionales.

El problema del gradiente desvanecido

Las redes neuronales recurrentes estándar enfrentan un problema notorio conocido como el gradiente desvanecido. Durante el proceso de entrenamiento (mediante retropropagación), los gradientes (señales que indican cuánto deben ajustarse los pesos de la red) se vuelven progresivamente más pequeños a medida que retroceden en el tiempo a través de la secuencia. Esto dificulta enormemente que la red 'recuerde' o aprenda de eventos que ocurrieron muchos pasos atrás en la secuencia. En la práctica, esto significa que una RNN simple puede ser efectiva para dependencias a corto plazo, pero falla al procesar información que requiere recordar contexto de hace mucho tiempo.

Las GRUs, al igual que las LSTMs, abordan este problema mediante el uso de sus compuertas. Estas compuertas permiten que los gradientes fluyan de manera más directa a través del tiempo, mitigando el desvanecimiento y permitiendo que la red aprenda dependencias de larga distancia de manera efectiva. La estructura de compuerta controlada es clave para mantener un flujo de información y gradientes saludable a lo largo de secuencias extensas.

GRU vs. RNN: La Evolución

La diferencia fundamental entre una RNN estándar y una GRU radica en la capacidad de la GRU para controlar explícitamente el flujo de información. Mientras que una RNN simple simplemente aplica una función de activación (como tanh o ReLU) a una combinación lineal de la entrada actual y el estado oculto anterior, una GRU utiliza sus compuertas sigmoides para modular la influencia de la entrada actual y el estado anterior en el nuevo estado. Esta modulación con compuertas es lo que permite a la GRU recordar y olvidar selectivamente información, superando así la limitación de las RNNs simples con respecto a las dependencias a largo plazo.

En tareas que implican secuencias largas o complejas, donde el contexto distante es crucial (por ejemplo, predecir la siguiente palabra en un texto largo), las GRUs superan significativamente el rendimiento de las RNNs tradicionales.

GRU vs. LSTM: Una Comparación Detallada

Como mencionamos, GRUs y LSTMs son arquitecturas hermanas, ambas diseñadas para resolver el problema del gradiente desvanecido en RNNs mediante mecanismos de compuerta. Sin embargo, presentan diferencias arquitectónicas clave que impactan su rendimiento y eficiencia:

| Característica | GRU | LSTM |

|---|---|---|

| Número de Compuertas | 2 (Reinicio, Actualización) | 3 (Entrada, Olvido, Salida) |

| Estado Interno | Solo Estado Oculto (combina memoria y estado) | Estado de Celda (memoria a largo plazo) + Estado Oculto (salida filtrada) |

| Complejidad Arquitectónica | Más simple | Más compleja |

| Número de Parámetros | Menor | Mayor |

| Velocidad de Entrenamiento | Generalmente más rápida | Generalmente más lenta |

| Manejo de Dependencias Muy Largas | Muy bueno | Potencialmente marginalmente superior en casos extremos |

| Uso de Compuerta de Salida | No tiene una compuerta de salida separada | Tiene una compuerta de salida que controla lo que se expone como estado oculto |

Diferencias Arquitectónicas

La principal diferencia es la estructura interna. Las LSTMs mantienen un 'estado de celda' separado que actúa como una especie de cinta de memoria, y las compuertas regulan el acceso y la modificación de esta celda. Las GRUs fusionan esta funcionalidad dentro de su único estado oculto y reducen el número de compuertas.

Capacidades de Aprendizaje

Ambas arquitecturas son muy capaces de aprender dependencias a largo plazo. En la práctica, su rendimiento es a menudo comparable en una amplia gama de tareas. Sin embargo, para secuencias extremadamente complejas o donde se requiere un control muy fino sobre la información que se expone en la salida, la arquitectura ligeramente más compleja de la LSTM con su estado de celda y compuerta de salida podría ofrecer una ventaja.

Velocidad y Complejidad de Entrenamiento

Debido a que tienen menos parámetros, las GRUs son generalmente más rápidas de entrenar y requieren menos recursos computacionales que las LSTMs. Esto las convierte en una excelente opción cuando la eficiencia es una prioridad o cuando se trabaja con conjuntos de datos muy grandes.

Aplicaciones

Tanto GRUs como LSTMs se aplican con éxito en los mismos dominios: procesamiento del lenguaje natural (traducción automática, generación de texto, análisis de sentimiento), modelado de series temporales (predicción de precios, análisis de datos biomédicos secuenciales), reconocimiento de voz, y más. La elección entre una u otra a menudo depende de la tarea específica, los recursos computacionales disponibles y la experimentación empírica.

Variaciones de las GRUs

Aunque la versión 'totalmente compuertada' es la más común, se han propuesto variaciones para simplificar aún más la arquitectura o adaptarla a necesidades específicas. Un ejemplo es la Unidad Mínima Compuertada (MGU), que fusiona las compuertas de reinicio y actualización en una única compuerta de 'olvido', simplificando aún más el modelo. Otras variantes ajustan cómo se calculan las compuertas, a veces dependiendo solo del estado oculto anterior o incluso solo de un sesgo fijo. Estas variaciones exploran el equilibrio entre la complejidad del modelo y su capacidad para capturar dependencias.

Ventajas y Desafíos de las GRUs

Las GRUs ofrecen ventajas significativas:

- Eficiencia: Son más rápidas de entrenar y computacionalmente menos costosas que las LSTMs.

- Simplicidad: Tienen menos parámetros y una arquitectura más sencilla, lo que puede facilitar su implementación y depuración.

- Manejo del Gradiente Desvanecido: Abordan eficazmente el problema del gradiente desvanecido, permitiendo el aprendizaje de dependencias a largo plazo.

- Buen Rendimiento: A menudo logran un rendimiento comparable al de las LSTMs en muchas tareas.

Sin embargo, también presentan desafíos:

- Potencial Limitación en Casos Extremos: Aunque suelen ser comparables a las LSTMs, en tareas que requieren recordar información de puntos *muy* distantes en secuencias *muy* complejas, las LSTMs podrían tener una ligera ventaja debido a su estado de celda separado.

- Emergencia de Nuevas Arquitecturas: Modelos más recientes, como los Transformers (basados en mecanismos de atención en lugar de recurrencia), han superado a las GRUs y LSTMs en muchas tareas de vanguardia (especialmente en NLP), aunque las GRUs siguen siendo muy relevantes en escenarios donde la recurrencia es inherentemente útil o los recursos son limitados.

Preguntas Frecuentes

¿Cuál es la principal diferencia entre GRU y LSTM?

La principal diferencia es el número de compuertas y la presencia de un estado de celda separado. Las GRUs tienen dos compuertas (reinicio y actualización) y no tienen estado de celda, integrando todo en el estado oculto. Las LSTMs tienen tres compuertas (entrada, olvido, salida) y un estado de celda que mantiene la memoria a largo plazo.

¿Por qué usar GRU en lugar de una RNN estándar?

Las GRUs superan el problema del gradiente desvanecido que afecta a las RNNs estándar, permitiéndoles aprender y recordar información a lo largo de secuencias largas. Esto las hace mucho más efectivas para tareas que dependen del contexto a largo plazo.

¿Son las GRUs siempre mejores que las LSTMs?

No necesariamente. Aunque las GRUs son generalmente más rápidas de entrenar y tienen menos parámetros, su rendimiento es a menudo comparable al de las LSTMs. Para algunas tareas muy específicas o secuencias extremadamente largas, una LSTM podría rendir marginalmente mejor. La elección suele depender de la tarea, los datos y los recursos computacionales.

¿Para qué tipos de tareas son adecuadas las GRUs?

Las GRUs son excelentes para cualquier tarea que involucre datos secuenciales, como procesamiento del lenguaje natural (traducción, generación de texto), modelado de series temporales (predicción de valores), reconocimiento de voz, y análisis de secuencias biológicas o de comportamiento.

En conclusión, las Unidades Recurrentes con Compuertas (GRUs) representan un avance significativo en el diseño de redes neuronales recurrentes. Al proporcionar un mecanismo eficiente para gestionar la memoria a lo largo del tiempo, resuelven las limitaciones de las RNNs tradicionales y ofrecen una alternativa más ligera pero igualmente potente a las LSTMs. Su equilibrio entre simplicidad y rendimiento las mantiene como una herramienta valiosa en el arsenal de cualquier investigador o profesional que trabaje con datos secuenciales, facilitando la exploración de patrones complejos dependientes del tiempo en diversos campos, incluida la investigación que busca comprender mejor los procesos cerebrales y neuronales a través de modelos computacionales.

Si quieres conocer otros artículos parecidos a GRUs: Memoria Eficiente en Redes Neuronales puedes visitar la categoría Neurociencia.