Durante mucho tiempo, la neurociencia concibió la neurona como una unidad computacional simple, similar a un interruptor digital que se activa (dispara) o no. Sin embargo, una perspectiva más rica y matizada ha ganado terreno: la que proviene de la teoría de los sistemas dinámicos. Esta teoría ofrece un marco matemático poderoso para entender el comportamiento complejo y a menudo no lineal de las neuronas individuales y las redes neuronales en su conjunto.

Un sistema dinámico es aquel cuyo estado cambia con el tiempo de acuerdo con una regla fija. En neurociencia, esto se aplica al estudio de cómo variables como el potencial de membrana de una neurona, la activación de canales iónicos o el estado de una red neuronal evolucionan a lo largo del tiempo. La belleza de esta perspectiva radica en su capacidad para describir comportamientos complejos, desde la simple activación de una neurona hasta patrones de actividad global en el cerebro, utilizando herramientas matemáticas.

Historia y Modelos Clásicos

La aplicación de modelos matemáticos y físicos a la neurona no es nueva. Ya en 1907, se desarrolló el modelo de integración y disparo (integrate-and-fire), uno de los primeros intentos de capturar matemáticamente la dinámica neuronal. Décadas más tarde, el descubrimiento del axón gigante del calamar permitió a Alan Hodgkin y Andrew Huxley desarrollar en 1952 el influyente modelo de Hodgkin-Huxley. Este modelo, basado en ecuaciones diferenciales no lineales, describía cómo los flujos de iones a través de la membrana generaban el potencial de acción neuronal.

El modelo de Hodgkin-Huxley, aunque potente, era complejo. Esto llevó a simplificaciones como el modelo de FitzHugh-Nagumo en 1962. En 1981, se desarrolló el modelo de Morris-Lecar para el músculo de percebe. Estos modelos matemáticos demostraron ser inmensamente útiles y siguen siendo fundamentales en la biofísica. Sin embargo, un avance crucial a finales del siglo XX impulsó el estudio dinámico de las neuronas a nuevos niveles: la tecnología informática.

El principal desafío de las ecuaciones fisiológicas como las mencionadas es su naturaleza no lineal. El análisis estándar era imposible y cualquier análisis avanzado implicaba un número casi infinito de posibilidades. Las computadoras abrieron muchas puertas en todas las ciencias duras al permitir aproximar soluciones a ecuaciones no lineales. Este es el aspecto de la neurociencia computacional que abarca la teoría de los sistemas dinámicos. En 2007, la publicación del libro de texto canónico de Eugene Izhikivech, Dynamical Systems in Neuroscience, ayudó a transformar este tema de investigación, antes oscuro, en una línea de estudio académico consolidada.

Dinámica Neuronal: Más Allá del "Todo o Nada"

La motivación fundamental para un enfoque dinámico en neurociencia proviene del interés en la complejidad física del comportamiento neuronal. Consideremos, por ejemplo, la interacción acoplada entre el potencial de membrana de una neurona y la activación de los canales iónicos. A medida que el potencial de membrana aumenta lo suficiente, los canales en la membrana se abren, permitiendo la entrada o salida de iones. Este flujo iónico altera aún más el potencial de membrana, lo que a su vez afecta la activación de los canales iónicos, que afecta el potencial de membrana, y así sucesivamente. Esta es la naturaleza típica de las ecuaciones no lineales acopladas.

Un ejemplo relativamente sencillo de esto es el modelo de Morris-Lecar. Aunque no profundizaremos en los detalles matemáticos completos, es importante notar que las ecuaciones de este modelo demuestran cómo el cambio en el potencial de membrana (V) con respecto al tiempo depende tanto de V como de la variable N (que representa la activación de un canal iónico específico), y cómo el cambio en N también depende de V. Tenemos dos funciones acopladas, donde la tasa de cambio de cada variable depende del estado de ambas variables. Diferentes modelos neuronales utilizan distintos canales iónicos (sodio, calcio, potasio, corrientes de fuga) dependiendo de la fisiología del organismo estudiado, pero la idea central del acoplamiento dinámico permanece.

La Excitabilidad Neuronal

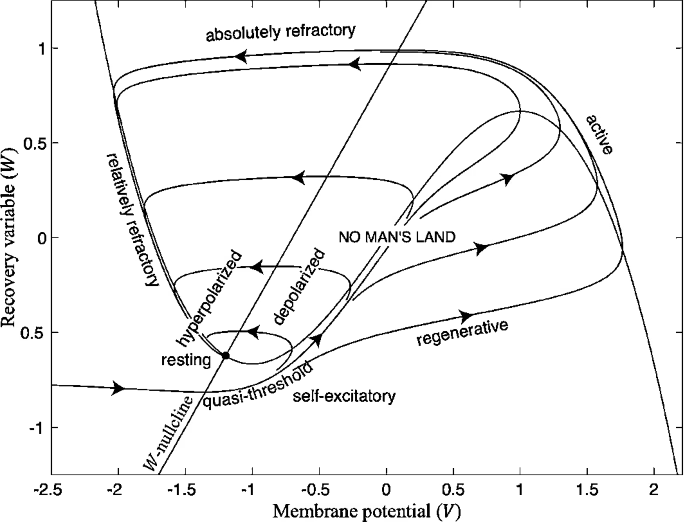

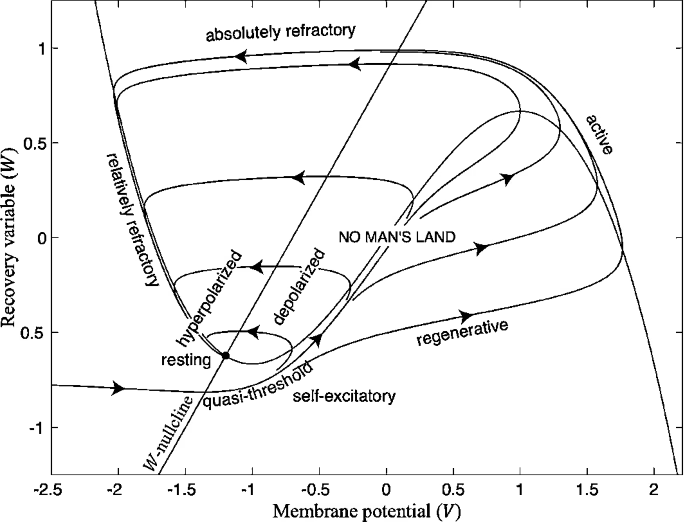

Uno de los temas predominantes en la neurobiología clásica es el concepto de un componente digital en las neuronas: la idea de un "umbral". Si el potencial de membrana alcanza un valor crítico, la neurona se dispara (produce un potencial de acción) de forma de "todo o nada". Los científicos de la computación adoptaron rápidamente este concepto, que evolucionó hacia la simple función de ponderación utilizada en las redes neuronales artificiales. Sin embargo, la crítica dinámica a este concepto digital es que las neuronas no exhiben un comportamiento estrictamente de todo o nada y, en cambio, deberían considerarse como resonadores.

En la teoría de sistemas dinámicos, esta propiedad se conoce como excitabilidad. Un sistema excitable permanece en un punto de equilibrio estable hasta que una perturbación lo saca de él, tras lo cual experimenta una excursión significativa en su espacio de estados antes de regresar eventualmente a su estado de reposo. Piensa en el ejemplo de un lago en la cima de una montaña con una bola en él. La bola está en un punto estable. Si le das un empujón lo suficientemente grande, saldrá del lago y rodará montaña abajo, ganando impulso. Si la trayectoria incluyera un bucle que la devolviera al lago, tendríamos un sistema que permanece en reposo, responde drásticamente a una perturbación grande y luego regresa al reposo.

En la neurona, las fuerzas fundamentales son electromagnéticas, y el potencial de membrana (V) y la variable de activación del canal (N) son las variables del espacio de fase. La "forma de la montaña" y el "bucle" están determinados por las complejas relaciones no lineales acopladas entre V y N. Esta propiedad de excitabilidad es crucial para la capacidad de las neuronas de transmitir información. Sin embargo, algunos modelos, como el de Morris-Lecar, también pueden operar en otros regímenes de parámetros donde exhiben comportamiento oscilatorio, moviéndose continuamente en el espacio de fase sin necesidad de una perturbación externa. Este comportamiento es comparable al de las células marcapasos en el corazón, que no dependen de la excitabilidad sino que generan ritmos que pueden excitar a otras células.

Dinámica Global de Redes Neuronales

La dinámica global de una red de neuronas depende de al menos cuatro atributos clave:

- Dinámica de la neurona individual: Principalmente, sus umbrales o excitabilidad.

- Transferencia de información entre neuronas: Generalmente a través de sinapsis o uniones gap.

- Topología de la red: Cómo están conectadas las neuronas entre sí.

- Fuerzas externas: Como gradientes termodinámicos o señales de entrada.

Hay innumerables combinaciones de redes neuronales que pueden modelarse considerando estos atributos, lo que resulta en una amplia y versátil gama de dinámicas globales.

Modelado de Redes Neuronales Biológicas

Para modelar una red neuronal biológica, se elige un modelo neuronal apropiado para describir la fisiología de las neuronas individuales y se añaden términos de acoplamiento adecuados para describir las interacciones físicas (sinapsis o uniones gap) entre ellas. También se deben considerar las condiciones iniciales y los parámetros de cada neurona. Desde la perspectiva de la dinámica no lineal, esto implica simular la evolución del estado del sistema a través del tiempo utilizando las funciones que describen su dinámica.

Siguiendo el ejemplo del modelo de Morris-Lecar, al extenderlo a una red, las ecuaciones se modifican para incluir un índice 'i' para cada neurona y un término de acoplamiento D(Vi) que describe la influencia de otras neuronas en la neurona i. La forma específica de la función de acoplamiento D depende del tipo de conexión, siendo las sinapsis químicas y las uniones gap los candidatos principales.

Redes de Atractores

Un concepto importante en la dinámica de redes neuronales es el de las redes de atractores. Un atractor es un estado o un conjunto de estados hacia el cual un sistema dinámico tiende a evolucionar con el tiempo. Diferentes tipos de atractores pueden describir distintos tipos de computación neuronal o funciones cerebrales:

- Atractores puntuales: Asociados con la memoria, la completación de patrones, la categorización y la reducción de ruido. El sistema converge a un único estado estable.

- Atractores de línea, anillo o plano: Relacionados con la integración neuronal, como el control oculomotor o la orientación espacial. El sistema puede permanecer en cualquier punto a lo largo de una línea, anillo o plano estable.

- Atractores cíclicos: Describen patrones de actividad rítmica, como los generadores de patrones centrales que controlan movimientos repetitivos (caminar, respirar). El sistema sigue una trayectoria periódica en el espacio de estados.

- Atractores caóticos: Aunque a menudo se confunden con ruido aleatorio, el caos determinista puede ser funcional en el cerebro, por ejemplo, en el reconocimiento de olores, permitiendo una rápida transición entre diferentes estados de actividad.

El estudio de estos atractores proporciona información sobre cómo las redes neuronales almacenan y procesan información.

Dinámica Más Allá de la Neurona

Si bien las neuronas desempeñan un papel principal en la dinámica cerebral, cada vez está más claro que su comportamiento depende en gran medida de su entorno. Este entorno no es un simple fondo pasivo; suceden muchas cosas justo fuera de la membrana neuronal, en el espacio extracelular. Las neuronas comparten este espacio con células gliales y el propio espacio extracelular puede contener varios agentes de interacción con las neuronas.

Glia

Las células gliales, consideradas alguna vez un mero sistema de soporte para las neuronas, han demostrado tener un papel significativo en la función cerebral. La cuestión de cómo la interacción entre neuronas y glía influye en la excitabilidad y la dinámica neuronal es un área activa de investigación dentro de la neurodinámica.

Neuroquímica y Neuromodulación

Como cualquier otra célula, las neuronas operan en un conjunto indudablemente complejo de reacciones moleculares. La comunicación dentro de las neuronas y entre ellas implica una intrincada red de señales químicas (neurotransmisores, G-proteínas, etc.) que consumen energía. Esta complejidad química es de gran interés para los estudios fisiológicos de la neurona y también influye en su dinámica.

Además, las neuronas viven en un fluido extracelular capaz de propagar energía química y física. La transmisión de volumen, por ejemplo, se ha asociado con gradientes térmicos causados por reacciones biológicas en el cerebro, y se ha relacionado con fenómenos como las migrañas. Estos procesos neuromodulatorios a gran escala también son aspectos de la dinámica cerebral que van más allá de la simple interacción sináptica.

Neurociencia Cognitiva y Redes Neuronales Artificiales

Los enfoques computacionales de la neurociencia teórica a menudo emplean redes neuronales artificiales que simplifican la dinámica de neuronas individuales en favor de examinar la dinámica más global. Aunque las redes neuronales se asocian frecuentemente con la inteligencia artificial, también han sido muy productivas en las ciencias cognitivas.

Las redes neuronales artificiales utilizan modelos neuronales simplificados, pero su dinámica global es capaz de exhibir comportamientos complejos, incluyendo dinámicas de red tipo Hopfield y de atractores. Una red de Hopfield, por ejemplo, fue diseñada específicamente para que su dinámica subyacente pudiera describirse mediante una función de Lyapunov, una técnica no lineal utilizada para analizar la estabilidad. La estabilidad en sistemas biológicos se llama homeostasis. Las redes de Hopfield han sido implicadas en el papel de la memoria asociativa, donde un recuerdo es activado por una clave o señal.

Redes Neuronales Recurrentes y Exponentes de Lyapunov

Las redes neuronales recurrentes (RNNs) se especializan en el procesamiento de datos secuenciales, como el lenguaje natural o series temporales. Estas redes, al propagar señales a lo largo del tiempo, son intrínsecamente sistemas dinámicos. Sin embargo, son sistemas dinámicos no estándar: son altamente no lineales, de muy alta dimensión (miles de variables), no autónomas (dependen de la entrada de datos) y, crucialmente, tienen parámetros que varían durante el proceso de optimización (entrenamiento).

Entender la dinámica de las RNNs es clave. Un problema central es la inestabilidad, que puede surgir durante la propagación de la señal (inferencia) o durante la optimización (problemas de gradientes que desaparecen o explotan). Los enfoques prácticos existen, pero la teoría de sistemas dinámicos ofrece herramientas para un análisis más profundo.

Una herramienta poderosa para caracterizar y predecir el comportamiento de sistemas dinámicos es el uso de los Exponentes de Lyapunov. Estos exponentes miden la tasa de separación de trayectorias infinitesimalmente cercanas en el espacio de estados, capturando cuánta información genera un sistema dinámico. Para las RNNs, los Exponentes de Lyapunov (LEs) pueden calcularse a partir del Jacobiano de los estados ocultos a lo largo del tiempo.

Aunque las RNNs son sistemas dinámicos no estándar, el enfoque se relaciona con la teoría de sistemas dinámicos aleatorios. Investigaciones recientes han demostrado que ciertas características de los espectros de LEs (la colección de todos los LEs) pueden correlacionarse significativamente con el rendimiento de las RNNs en tareas específicas, así como con su robustez y precisión. Esto sugiere que los LEs pueden servir como métricas valiosas para comprender y potencialmente mejorar el comportamiento de estas redes.

Un enfoque innovador, llamado AeLLE, utiliza un autoencoder para aprender una representación de baja dimensión de los espectros de LEs y correlacionarla con el rendimiento de la RNN. Esta representación aprendida puede incluso servir como clasificador para seleccionar parámetros que conduzcan a un rendimiento óptimo. Esto es solo un ejemplo de cómo las herramientas de los sistemas dinámicos pueden aplicarse a las redes neuronales, abriendo posibilidades para la selección de arquitectura, la poda de redes o la optimización de hiperparámetros.

Preguntas Frecuentes

¿Qué son los sistemas dinámicos en neurociencia?

Son un marco matemático para estudiar cómo el estado de las neuronas individuales y las redes neuronales cambia con el tiempo. Utilizan ecuaciones y conceptos matemáticos para describir comportamientos complejos, como la activación neuronal, la oscilación o los patrones de actividad en redes, considerando las interacciones no lineales entre sus componentes.

¿Son las redes neuronales artificiales sistemas dinámicos?

Sí, las redes neuronales artificiales, especialmente las redes recurrentes, son intrínsecamente sistemas dinámicos. Propagan señales a través de capas o a lo largo del tiempo, lo que implica una evolución de su estado. Son sistemas dinámicos complejos, a menudo de alta dimensión, no lineales y con parámetros que cambian durante el entrenamiento.

¿Qué papel juegan los Exponentes de Lyapunov?

Los Exponentes de Lyapunov son herramientas matemáticas de la teoría de sistemas dinámicos que miden la tasa de separación de trayectorias cercanas. En el contexto de las redes neuronales recurrentes, se utilizan para analizar la estabilidad y la complejidad de su dinámica, y se ha encontrado que ciertas características de sus espectros se correlacionan con el rendimiento y la capacidad de procesamiento de información de la red.

¿La teoría de sistemas dinámicos solo se aplica a neuronas individuales?

No, la teoría de sistemas dinámicos se aplica tanto al comportamiento de neuronas individuales (su excitabilidad, oscilaciones) como a la dinámica de redes neuronales completas. También se extiende a considerar la influencia del entorno neuronal, como las células gliales y los procesos neuroquímicos, en la dinámica del sistema.

Conclusión

La teoría de los sistemas dinámicos ha proporcionado y sigue proporcionando una visión indispensable para la neurociencia. Al ver el cerebro y sus componentes como sistemas complejos que evolucionan en el tiempo, podemos ir más allá de simplificaciones excesivas y abordar la rica complejidad del comportamiento neuronal y de red. Desde los modelos clásicos de neuronas individuales hasta el análisis de la dinámica global de extensas redes y la comprensión de las redes neuronales artificiales, este enfoque matemático revela patrones, estabilidad, excitabilidad y otros fenómenos cruciales que subyacen a la cognición y el comportamiento. Es un campo en constante evolución, impulsado por los avances computacionales y la necesidad de comprender sistemas biológicos intrínsecamente no lineales.

Si quieres conocer otros artículos parecidos a Sistemas Dinámicos en Neurociencia puedes visitar la categoría Neurociencia.