El mundo actual genera una cantidad de información sin precedentes. Hablamos de Big Data, conjuntos de datos tan masivos y complejos que superan la capacidad de las herramientas de gestión de datos tradicionales para capturarlos, almacenarlos, gestionarlos y analizarlos en un tiempo razonable. Estos datos provienen de innumerables fuentes: transacciones online, redes sociales, sensores IoT, registros de servidores, dispositivos móviles y mucho más. Para las organizaciones, el desafío no es solo almacenar esta avalancha de información, sino extraer valor real que se traduzca en mejores decisiones, innovación y una ventaja competitiva.

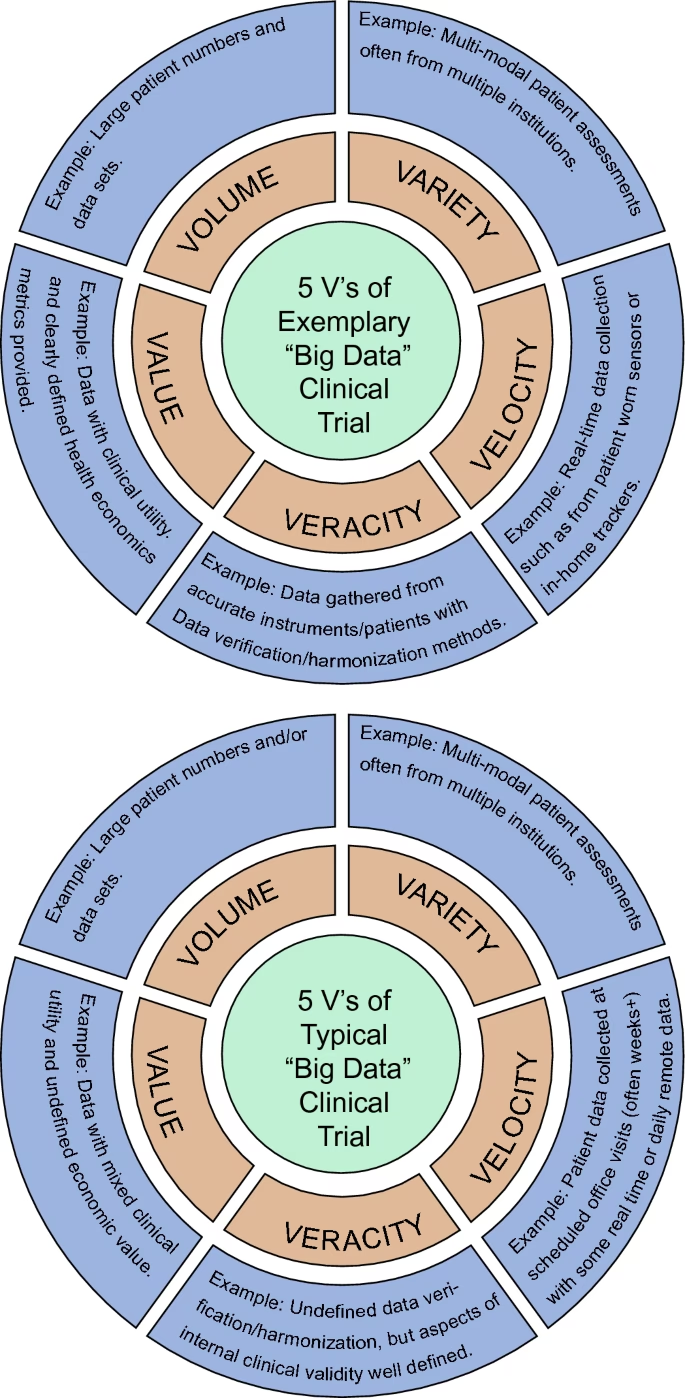

A diferencia de las soluciones de bases de datos y análisis que hemos utilizado durante décadas, las tecnologías y herramientas de Big Data están específicamente diseñadas para lidiar con el volumen, la velocidad y la variedad (las famosas 'V's, aunque la variedad es la 'complejidad' mencionada en el texto) que caracterizan a estos conjuntos de datos. Su objetivo es permitirte procesar y analizar esta información a una escala y ritmo que antes eran impensables, revelando patrones, tendencias y correlaciones ocultas.

- ¿Por Qué una Estrategia de Big Data es Indispensable?

- Big Data vs. Datos Tradicionales: Una Comparativa

- Los Cuatro Pilares de una Estrategia Efectiva

- Un Ejemplo Concreto: Los Data Lakes

- Preguntas Frecuentes sobre Estrategias de Big Data

- ¿Qué diferencia a Big Data de los datos tradicionales?

- ¿Por qué necesito una estrategia de Big Data si ya tengo herramientas de análisis?

- ¿Cuáles son los "cuatro pilares" de una estrategia efectiva?

- ¿Qué es un Data Lake y por qué es importante para Big Data?

- ¿Cómo aseguro la confianza en mis datos de Big Data?

¿Por Qué una Estrategia de Big Data es Indispensable?

Manejar Big Data sin una estrategia clara es como navegar en un océano sin brújula. Puedes tener acceso a un tesoro de información, pero sin un plan, te perderás en la inmensidad. Una estrategia de datos sólida comienza por entender qué quieres lograr. ¿Cuáles son los objetivos de negocio que buscas impulsar? ¿Necesitas optimizar operaciones, entender mejor a tus clientes, desarrollar nuevos productos o predecir tendencias del mercado?

Una vez definidos los objetivos, es crucial identificar casos prácticos concretos donde el Big Data pueda marcar la diferencia. Luego, debes evaluar qué datos tienes disponibles actualmente que puedan ser útiles para estos casos. Pero el inventario no termina ahí. La estrategia también implica determinar qué datos adicionales podrías necesitar en el futuro para cumplir tus metas y qué nuevos sistemas, herramientas o infraestructura serán necesarios para adquirirlos, almacenarlos, procesarlos y analizarlos de manera efectiva.

El texto nos enseña que no existe una estrategia de Big Data única que sirva para todos. Lo que funciona brillantemente para una empresa de comercio electrónico puede no ser adecuado para un hospital o una empresa manufacturera. Cada organización tiene necesidades específicas, una cultura de datos particular y un conjunto único de desafíos y oportunidades. Por lo tanto, la personalización de la estrategia es fundamental.

Big Data vs. Datos Tradicionales: Una Comparativa

Para comprender mejor la magnitud del cambio que implica el Big Data, es útil compararlo con la gestión de datos más tradicional.

| Característica | Datos Tradicionales | Big Data |

|---|---|---|

| Volumen | Relativamente pequeño, manejable con herramientas estándar. | Extremadamente grande (terabytes, petabytes, exabytes), a menudo supera la capacidad de almacenamiento y procesamiento tradicional. |

| Velocidad | Procesamiento por lotes, análisis histórico. Datos que cambian lentamente. | Alta velocidad de generación y a menudo requiere procesamiento en tiempo real o casi real. |

| Variedad / Complejidad | Principalmente datos estructurados (tablas relacionales). | Datos estructurados, semiestructurados (JSON, XML) y no estructurados (texto, imágenes, audio, video). |

| Herramientas | Bases de datos relacionales (SQL), ETL (Extract, Transform, Load), herramientas de Business Intelligence. | Sistemas de archivos distribuidos (HDFS), bases de datos NoSQL, frameworks de procesamiento distribuido (Spark, Hadoop), data lakes, herramientas de IA y Machine Learning. |

| Análisis | Consultas predefinidas, reportes estándar, análisis descriptivo. | Análisis exploratorio, predictivo, prescriptivo; Machine Learning, IA, análisis en tiempo real, procesamiento de lenguaje natural. |

| Valor | Informes sobre el pasado, conocimiento operativo. | Descubrimiento de patrones ocultos, predicción de futuro, automatización de decisiones, innovación. |

Los Cuatro Pilares de una Estrategia Efectiva

Nuestros clientes de Google Cloud, al abordar sus iniciativas de Big Data, han identificado conceptos clave que son vitales para dar forma a una estrategia exitosa. Estos pilares no solo guían la implementación tecnológica, sino también la cultura organizacional en torno a los datos.

1. Abierta y Adaptable

En el panorama actual, las fuentes de datos son diversas y las innovaciones tecnológicas emergen constantemente. Las organizaciones necesitan la libertad de elegir las herramientas y soluciones que mejor se adapten a sus necesidades, sin estar atadas a un único proveedor o tecnología. Esto implica diseñar entornos de Big Data que sean intrínsecamente abiertos y adaptables. La realidad del Big Data a menudo implica múltiples interfaces, pilas tecnológicas de código abierto y entornos multinube. Un enfoque abierto y adaptable permite integrar fácilmente nuevas fuentes de datos, adoptar tecnologías emergentes y construir soluciones personalizadas que evolucionen con el negocio.

2. Inteligente

El verdadero poder del Big Data reside en la capacidad de transformarlo en información valiosa y accionable. Una estrategia inteligente aprovecha las analíticas avanzadas, las tecnologías de Inteligencia Artificial (IA) y el Machine Learning (ML) para extraer insights de manera eficiente. Estas capacidades no solo mejoran la toma de decisiones empresariales, sino que también pueden automatizar procesos tediosos y optimizar la gestión de la infraestructura de Big Data. Habilitar analíticas de autoservicio, por ejemplo, empodera a los empleados para explorar datos por sí mismos, reduciendo la dependencia de equipos especializados y acelerando el descubrimiento de valor.

3. Flexible

La flexibilidad en la estrategia de Big Data es crucial para fomentar la innovación. Una base de datos que ofrece acceso bajo demanda a recursos de computación y almacenamiento (como los modelos basados en la nube) permite escalar la capacidad según sea necesario, sin grandes inversiones iniciales o restricciones de hardware. Unificar los datos de diversas fuentes para que sean fácilmente descubribles y accesibles es otro aspecto clave de la flexibilidad. La capacidad de combinar y utilizar fácilmente diferentes tecnologías y soluciones ('composabilidad') permite a las empresas crear el conjunto de herramientas de datos perfecto para cada carga de trabajo y caso práctico específico, adaptándose rápidamente a las cambiantes demandas del negocio.

4. Confiable

La confianza es el pilar fundamental sobre el que se construye cualquier estrategia de Big Data exitosa. Para que los datos sean útiles, deben ser fiables: precisos, relevantes y, sobre todo, protegidos. Generar confianza en los datos implica garantizar su calidad desde el origen, establecer procesos claros de gobernanza y asegurar que la seguridad sea una consideración prioritaria por defecto. Independientemente de dónde provengan los datos, deben estar protegidos contra accesos no autorizados y amenazas. Una estrategia de confianza robusta también debe abordar el cumplimiento normativo (privacidad de datos, etc.), la redundancia para asegurar la disponibilidad y la fiabilidad general de los sistemas y los datos que contienen. Los insights derivados de datos no confiables pueden llevar a decisiones erróneas y costosas.

Un Ejemplo Concreto: Los Data Lakes

Un ejemplo práctico de cómo se implementan estos conceptos, especialmente la flexibilidad y la capacidad de manejar variedad, son los Data Lakes (Lagos de Datos). A diferencia de los Data Warehouses tradicionales que requieren que los datos estén altamente estructurados antes de ser ingeridos, los Data Lakes pueden ingestar, procesar y almacenar datos en su formato nativo, ya sean estructurados (bases de datos), semiestructurados (archivos CSV, JSON) o no estructurados (documentos, imágenes, audio). Esto los convierte en una base ideal para manejar la gran variedad de datos que caracterizan al Big Data.

Un Data Lake a cualquier escala sirve como un repositorio centralizado donde los datos se almacenan sin un esquema predefinido, lo que permite una mayor flexibilidad para explorarlos y analizarlos de diferentes maneras en el futuro. Son la base perfecta para ejecutar diversos tipos de analíticas inteligentes, desde visualizaciones interactivas y análisis en tiempo real hasta modelos complejos de Machine Learning y procesamiento de datos a gran escala. Su diseño inherente a menudo se alinea con el pilar de ser Abierto y Adaptable, permitiendo la integración con múltiples herramientas de procesamiento y análisis.

Preguntas Frecuentes sobre Estrategias de Big Data

¿Qué diferencia a Big Data de los datos tradicionales?

La principal diferencia radica en el volumen, la velocidad y la variedad/complejidad de los datos. El Big Data es mucho más grande, se genera y cambia más rápido, y viene en muchos formatos (estructurados, semiestructurados, no estructurados), lo que requiere herramientas y enfoques de análisis especializados que superan las capacidades de las bases de datos tradicionales.

¿Por qué necesito una estrategia de Big Data si ya tengo herramientas de análisis?

Las herramientas son solo una parte de la ecuación. Una estrategia proporciona la hoja de ruta: define los objetivos de negocio, identifica los casos de uso relevantes, evalúa los datos necesarios y existentes, y planifica la infraestructura y las capacidades analíticas. Sin una estrategia, es difícil extraer valor real y sostenible del Big Data o asegurar que las inversiones en herramientas sean efectivas.

¿Cuáles son los "cuatro pilares" de una estrategia efectiva?

Según el texto, son ser Abierta y Adaptable (libertad de elegir herramientas, flexibilidad de integración), Inteligente (aprovechar IA/ML y analíticas avanzadas), Flexible (acceso bajo demanda a recursos, unificación de datos) y Confiable (datos precisos, relevantes y seguros).

¿Qué es un Data Lake y por qué es importante para Big Data?

Un Data Lake es un repositorio centralizado que almacena datos en su formato nativo (estructurado, semiestructurado, no estructurado) a cualquier escala. Es importante porque permite manejar la gran variedad de datos del Big Data sin imponer un esquema rígido de antemano, sirviendo como una base flexible para diversos tipos de análisis avanzados, incluida la inteligencia artificial y el Machine Learning.

¿Cómo aseguro la confianza en mis datos de Big Data?

Asegurar la confianza implica garantizar la precisión y relevancia de los datos, implementar medidas de seguridad robustas por defecto, cumplir con las regulaciones de privacidad y gobernanza de datos, y asegurar la redundancia y fiabilidad de la infraestructura de almacenamiento y procesamiento. Es un esfuerzo continuo que requiere procesos y tecnologías adecuados.

En resumen, abordar el Big Data es un desafío complejo pero lleno de oportunidades. Una estrategia bien definida, que abrace la apertura, la inteligencia, la flexibilidad y, fundamentalmente, la confianza, es el camino para convertir esta vasta cantidad de información en un motor de crecimiento e innovación para cualquier organización.

Si quieres conocer otros artículos parecidos a La Estrategia Clave para el Big Data puedes visitar la categoría Neurociencia.