En las profundidades de nuestro cráneo, nuestro cerebro se enfrenta constantemente a un desafío fundamental: dar sentido al mundo utilizando información sensorial incompleta y ambigua. Este proceso, crucial para nuestra experiencia consciente, se basa en un método sofisticado conocido como inferencia bayesiana. Nombrado así en honor al estadístico del siglo XVIII Thomas Bayes, este enfoque para razonar bajo incertidumbre se ha convertido en clave para comprender cómo el cerebro construye nuestras percepciones.

Los organismos multicelulares poseen una capacidad representacional, lo que significa que pueden codificar información sobre su entorno y explotarla para adoptar un comportamiento adaptativo. En los humanos, la organización síncrona de grupos de células nerviosas (neuronas y glía) genera representaciones de la estructura estadística del entorno, permitiendo al organismo utilizar esta información para adaptarse al mundo circundante. Para mantenerse vivo, un organismo debe reducir la incertidumbre sensorial y mantenerse en un conjunto de estados vinculados a su lugar dentro de su nicho ecológico. Al codificar en su sistema nervioso un modelo estadístico que describe cómo se generan las percepciones y la estructura causal de las relaciones con el mundo exterior, el organismo puede minimizar la incertidumbre utilizando este modelo para actuar y corregirlo a medida que llega nueva información.

¿Qué es la Teoría Bayesiana del Cerebro?

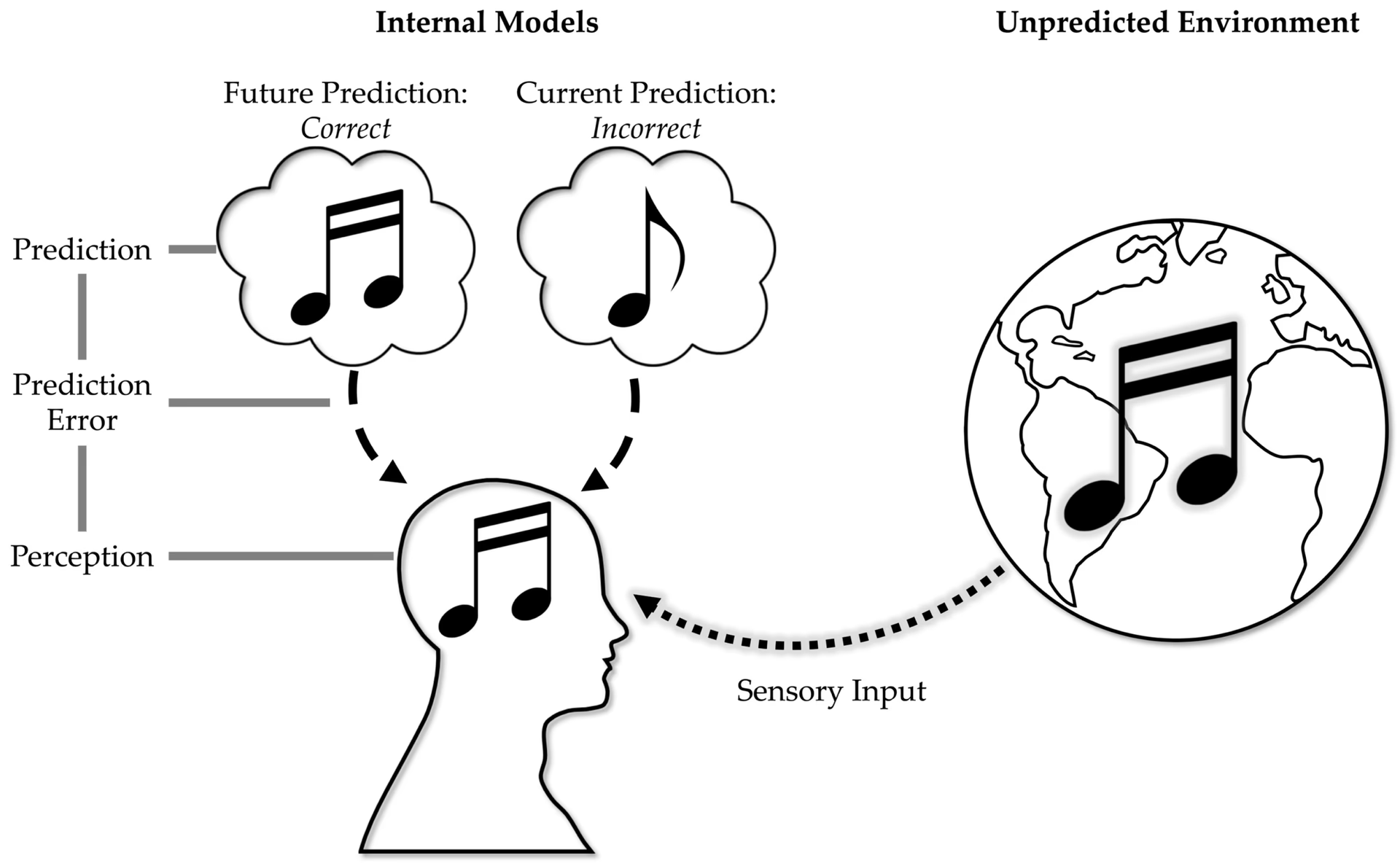

La teoría bayesiana del cerebro (TBC) es un marco conceptual en neurociencia que formaliza matemáticamente esta dinámica cerebral de procesamiento de información. La teoría sugiere que el sistema nervioso codifica creencias probabilísticas a partir de las cuales genera predicciones sobre las entradas sensoriales. La diferencia entre estas predicciones y las entradas sensoriales genera errores de predicción, que se utilizan para actualizar el modelo probabilístico, permitiendo al organismo adaptarse eficazmente a los cambios en su entorno.

La TBC considera el cerebro como un órgano estadístico de inferencia jerárquica que predice eventos actuales y futuros basándose en la experiencia pasada. Según esta teoría, la mente da sentido al mundo asignando probabilidades a las hipótesis que mejor explican los datos sensoriales (que suelen ser escasos y ambiguos) y actualizando continuamente estas hipótesis según las reglas probabilísticas estándar de inferencia. Este ajuste fino (optimización) de la percepción y la acción opera bajo el único imperativo de minimizar la sorpresa (energía libre) y la incertidumbre, maximizando así la eficiencia estadística y termodinámica.

Orígenes Filosóficos y Teóricos

Los fundamentos de la inferencia bayesiana se remontan a Thomas Bayes (1702–1761), un ministro presbiteriano y estadístico inglés. Bayes nunca publicó su innovador trabajo en vida; en cambio, su “Ensayo para resolver un problema en la doctrina de las probabilidades” fue presentado a la Royal Society en Londres dos años después de su muerte por su amigo Richard Price. Este ensayo sentó las bases para actualizar las probabilidades basándose en nueva evidencia. Sin embargo, fue el matemático francés Pierre-Simon Laplace quien, a finales del siglo XVIII y principios del XIX, desarrolló y expandió las ideas iniciales de Bayes en un marco estadístico robusto. Laplace formalizó muchos de los conceptos, los aplicó a problemas del mundo real y desarrolló lo que ahora llamamos la regla de Bayes-Laplace. Juntos, las contribuciones de Bayes, Price y Laplace sentaron las bases para un enfoque revolucionario de la probabilidad y la estadística, aunque tardarían casi dos siglos en ganar aceptación generalizada.

Comprendiendo el Razonamiento Bayesiano

La inferencia es el proceso de llegar a conclusiones basándose en evidencia y razonamiento. En el contexto del razonamiento bayesiano, la inferencia implica hacer juicios probabilísticos sobre la probabilidad de hipótesis dadas los datos observados.

Tipos de Razonamiento

Existen diferentes formas de razonamiento:

- Razonamiento Deductivo: Extrae conclusiones lógicas de premisas. Si las premisas son verdaderas, la conclusión debe ser verdadera. Ejemplo: Todos los hombres son mortales; Sócrates es un hombre; por lo tanto, Sócrates es mortal.

- Razonamiento Inductivo: Extrae conclusiones generales de observaciones específicas. Estas conclusiones son probables pero no ciertas. Ejemplo: Cada cisne que he visto es blanco; por lo tanto, todos los cisnes son probablemente blancos.

- Razonamiento Abductivo: Infiere la explicación más probable para un conjunto de observaciones. A menudo se describe como “inferencia a la mejor explicación”. Ejemplo: El césped está mojado; probablemente llovió anoche.

La inferencia bayesiana es un enfoque formalizado del razonamiento abductivo. Proporciona un marco matemático para actualizar las creencias sobre hipótesis basándose en la evidencia observada. A diferencia del razonamiento deductivo, la inferencia bayesiana no garantiza la certeza, sino que calcula las probabilidades de diferentes explicaciones. Destaca en situaciones donde la información es incompleta o incierta, lo que la hace particularmente útil para la resolución de problemas del mundo real y la investigación científica. La inferencia bayesiana opera combinando creencias previas (priors) con nueva evidencia (likelihoods) para llegar a creencias actualizadas (posteriors). Este proceso refleja la forma en que los humanos razonan naturalmente sobre el mundo, convirtiéndola en una herramienta poderosa para modelar procesos cognitivos y la toma de decisiones bajo incertidumbre.

Componentes Clave de la Inferencia Bayesiana

La inferencia bayesiana se basa en la interacción de tres componentes principales:

| Componente | Descripción | Ejemplo (Césped Mojado) |

|---|---|---|

| Prior (Creencia Previa) | Nuestras creencias o conocimiento inicial sobre una hipótesis antes de considerar nueva evidencia. | La probabilidad de lluvia en cualquier noche en tu área. |

| Likelihood (Verosimilitud) | La probabilidad de observar la evidencia dada que una hipótesis particular es verdadera. | La probabilidad de que el césped esté mojado, dado que llovió anoche. |

| Posterior (Creencia Actualizada) | Las creencias actualizadas después de considerar tanto el conocimiento previo como la nueva evidencia. | La probabilidad actualizada de que llovió, dado que observamos el césped mojado. |

Estos tres componentes trabajan juntos en la inferencia bayesiana: comenzamos con nuestras creencias previas, observamos nueva evidencia y calculamos cuán probable es esta evidencia bajo diferentes hipótesis, y actualizamos nuestras creencias para formar probabilidades posteriores, que representan nuestra nueva mejor estimación sobre la situación. Este proceso puede repetirse a medida que hay nueva evidencia disponible, convirtiéndose el posterior de cada iteración en el prior para la siguiente ronda de inferencia. Esta naturaleza iterativa permite que la inferencia bayesiana refine continuamente las probabilidades a medida que se recopila más información, convirtiéndola en una herramienta poderosa para razonar bajo incertidumbre.

Fórmula Matemática: La Regla de Bayes

La regla de Bayes se expresa matemáticamente como:

P(H|E) = [P(E|H) * P(H)] / P(E)

Donde:

- P(H|E) es la probabilidad posterior: la probabilidad de la hipótesis H dada la evidencia E.

- P(E|H) es la verosimilitud: la probabilidad de observar la evidencia E si la hipótesis H es verdadera.

- P(H) es la probabilidad previa: la probabilidad inicial de la hipótesis H antes de considerar la evidencia.

- P(E) es la verosimilitud marginal: la probabilidad total de observar la evidencia E bajo todas las hipótesis posibles.

En la práctica, a menudo no es necesario calcular P(E) directamente, ya que sirve como una constante de normalización para asegurar que las probabilidades posteriores sumen 1. La fórmula puede simplificarse a:

P(H|E) ∝ P(E|H) * P(H)

Esta forma proporcional establece que el posterior es proporcional al producto de la verosimilitud y el prior.

El Cerebro Como Máquina Bayesiana: Inferencia en la Percepción

Nuestros cerebros son bombardeados constantemente con datos sensoriales, tratando de dar sentido al mundo que nos rodea. Para hacer esto de manera eficiente, se basan en la inferencia bayesiana, un método que nos ayuda a formar y actualizar nuestras creencias basándonos en nueva información. Piensa en tu cerebro como una sofisticada máquina de predicción, siempre trabajando detrás de escena para descubrir qué hay ahí fuera.

El cerebro comienza con lo que se llaman “priors perceptuales”, que son nuestras creencias o expectativas iniciales sobre el mundo. Por ejemplo, podrías tener la creencia previa de que la luz generalmente proviene de arriba porque así es como experimentamos la luz solar y la iluminación interior. Estos priors se combinan luego con las “likelihoods”, que son las probabilidades de observar ciertos datos sensoriales si una causa particular fuera verdadera. El cerebro actualiza continuamente estas creencias a medida que llega nueva información sensorial, utilizando un proceso similar al teorema de Bayes.

Ejemplo Práctico: Imaginemos que estás caminando por un parque y ves algo oscuro y peludo a lo lejos. La creencia inicial (prior) de tu cerebro podría ser que es un perro grande, ya que los perros son comunes en los parques. Pero a medida que la figura se acerca, tus datos sensoriales se vuelven más claros y notas que camina sobre dos patas y es mucho más grande que un perro. La verosimilitud de que sea un gorila aumenta con esta nueva información.

Inicialmente, la probabilidad previa de que sea un gorila es muy baja (quizás no estás en un zoológico). Sin embargo, a medida que recopilas más datos —su forma, movimiento y quizás incluso un gruñido— tu cerebro actualiza sus creencias. La nueva creencia posterior (la estimación actualizada) podría cambiar significativamente hacia que sea un gorila, especialmente si todas las nuevas entradas sensoriales apuntan consistentemente en esa dirección.

Actualización Continua de las Mejores Estimaciones Perceptuales

El cerebro combina constantemente priors y likelihoods según la regla de Bayes, formando nuevas probabilidades posteriores (mejores estimaciones perceptuales) cada fracción de segundo. Cada nuevo posterior sirve como un prior para la siguiente ronda de entrada sensorial, creando un proceso de percepción continuo en lugar de instantáneas estáticas. Esta actualización continua permite una rápida adaptación a entornos cambiantes y nueva información, asegurando que nuestras percepciones sigan siendo lo más precisas y actualizadas posible.

El Papel de la Fiabilidad de la Información Sensorial (Precisión)

El cerebro tiene en cuenta la fiabilidad estimada de la información sensorial al actualizar sus mejores estimaciones perceptuales. La información más fiable tiene una mayor influencia en la actualización de las creencias que la información menos fiable. Este concepto se representa en los cálculos bayesianos del cerebro a través de la precisión de las distribuciones de probabilidad:

- Alta Precisión (Baja Varianza): Indica alta fiabilidad.

- Baja Precisión (Alta Varianza): Indica baja fiabilidad.

Cuando se observa un objeto distante, la información visual es inicialmente poco fiable, lo que resulta en baja precisión. A medida que el objeto se acerca, los datos sensoriales se vuelven más fiables, permitiendo inferencias perceptuales más seguras y mayor precisión. Esta actualización continua de la fiabilidad ayuda al cerebro a hacer las interpretaciones más precisas de los datos sensoriales que recibe.

Mecanismos Neuronales y Organización Jerárquica

El cerebro bayesiano postula una organización jerárquica de las áreas cerebrales involucradas en la inferencia. Se cree que esta jerarquía permite que la información se procese de manera predictiva y correctiva a través de diferentes niveles de abstracción.

- Las regiones cerebrales dentro de un sistema neuronal están organizadas jerárquicamente.

- Cada nivel de la jerarquía envía señales descendentes (top-down) para predecir las entradas en niveles inferiores.

- El error de predicción es la información en un nivel inferior que no es predicha por un nivel superior.

- Los niveles superiores actualizan sus predicciones para minimizar el error de predicción subsiguiente.

- El grado en que los niveles superiores se actualizan depende de la precisión del error de predicción.

- La precisión (fiabilidad) en el error de predicción se estima a partir de la experiencia previa.

- El percepto está dictado por la síntesis de nueva información sensorial con creencias previas.

- La atención aumenta la precisión de los errores de predicción y su influencia en los niveles superiores.

- Las acciones predichas se realizan cuando la precisión de los errores de predicción se atenúa (esto se relaciona con la inferencia activa, donde la acción se utiliza para hacer que las sensaciones entrantes coincidan con las predicciones).

Se cree que los errores de predicción ascendentes (bottom-up) surgen a frecuencias de 30-70Hz de las capas corticales superficiales. Las predicciones descendentes (top-down) se cree que surgen a frecuencias de 20-30Hz de las capas corticales más profundas. Las predicciones descendentes de la precisión están mediadas por mecanismos neuromoduladores.

El comportamiento (por ejemplo, las acciones) minimiza la incertidumbre (sorpresa esperada). Esto se conoce como inferencia activa. Por ejemplo, el Modelado Causal Dinámico (DCM) de datos de fMRI, MEG y EEG puede utilizarse para distinguir la señalización neuronal hacia adelante y hacia atrás en diferentes capas y niveles de la corteza, especificar los mecanismos de comunicación neuronal a nivel sináptico y de neurotransmisores, y dilucidar los principios de inferencia en el cerebro y su papel en la psicopatología.

Implicaciones y Aplicaciones

La teoría del cerebro bayesiano ofrece un marco unificador para comprender una amplia gama de funciones cerebrales, tanto normales como anormales. Al modelar las computaciones, los microcircuitos y el procesamiento neuronal, podemos obtener información sobre:

- Percepción normal y anormal

- Acción

- Aprendizaje

- Memoria

- Toma de decisiones

- Muchas otras funciones cognitivas.

El impacto potencial de esta teoría es considerable. Los trastornos neurológicos y psiquiátricos pueden ser causados por problemas en la actualización de las predicciones jerárquicas en el cerebro, a nivel sináptico y de neurotransmisores, particularmente en el control neuromodulador de la precisión. Esto podría resultar en actividad convulsiva en la epilepsia, dificultad para interpretar nueva información basándose en la experiencia pasada (inferencia falsa) y dificultad para actualizar las expectativas sobre el cuerpo o el entorno.

Limitaciones y Preguntas Abiertas

Aunque la teoría bayesiana del cerebro proporciona un marco poderoso, también presenta limitaciones y plantea preguntas importantes para la investigación futura.

El Teorema de Bayes como Estándar de Optimalidad

El teorema de Bayes proporciona un marco matemático para realizar inferencias óptimas basadas en probabilidades. Establece un estándar sobre cómo combinar el conocimiento previo con nueva evidencia para actualizar las creencias de la manera más racional posible. Sin embargo, aplicar el teorema de Bayes en situaciones del mundo real puede ser desafiante debido a restricciones prácticas. La precisión de la inferencia bayesiana depende en gran medida de la calidad y precisión de los priors y likelihoods. En la práctica, estos pueden ser difíciles de cuantificar con precisión, lo que lleva a posibles sesgos o errores.

Además, implementar la inferencia bayesiana puede ser computacionalmente exigente, especialmente en sistemas complejos con grandes cantidades de datos y numerosas variables. Esto puede limitar su aplicabilidad en escenarios de toma de decisiones en tiempo real.

Mecanismos Neuronales de la Inferencia Bayesiana en el Cerebro

Si bien la inferencia bayesiana ofrece un marco convincente para comprender la percepción, los mecanismos neuronales exactos mediante los cuales el cerebro implementa estas computaciones aún no se comprenden completamente. La investigación está en curso para descubrir cómo las neuronas representan y actualizan las creencias probabilísticas.

Una hipótesis es que el cerebro utiliza distribuciones de probabilidad, como distribuciones gaussianas, para representar creencias. La media de la distribución podría corresponder al contenido de la creencia, mientras que la precisión representa la confianza en esa creencia. Sin embargo, la codificación neuronal detallada de estos parámetros sigue siendo un área activa de investigación. Cómo el cerebro integra y pondera la información sensorial de fiabilidad variable es otra pregunta crítica. Comprender los circuitos neuronales involucrados en este proceso podría arrojar luz sobre cómo se implementa la inferencia bayesiana a nivel celular y de red.

Futuras Direcciones de Investigación

Se necesita más investigación para explorar cómo diferentes regiones cerebrales contribuyen a la inferencia bayesiana, cómo estos procesos se desarrollan con el tiempo y cómo podrían verse interrumpidos en trastornos neurológicos o psiquiátricos. Los avances en neuroimagen y modelado computacional serán cruciales para abordar estas preguntas. Al abordar estas limitaciones y explorar estas preguntas adicionales, podemos profundizar nuestra comprensión tanto de los fundamentos teóricos de la inferencia bayesiana como de su implementación práctica dentro del cerebro. Este conocimiento no solo mejorará nuestra comprensión de la percepción, sino que también informará el desarrollo de sistemas de IA más sofisticados y herramientas de diagnóstico en medicina.

Preguntas Frecuentes sobre el Cerebro Bayesiano

¿Qué es un error de predicción en el contexto del cerebro bayesiano?

Es la diferencia entre lo que el cerebro predice que debería sentir o percibir y la entrada sensorial real que recibe. Estos errores son cruciales para actualizar los modelos probabilísticos internos del cerebro.

¿Qué significa la precisión en la teoría bayesiana del cerebro?

La precisión se refiere a la fiabilidad o la incertidumbre asociada con una señal o una creencia. Una alta precisión significa que la señal es fiable y tiene baja varianza, mientras que una baja precisión indica alta incertidumbre.

¿Cómo se relaciona la inferencia activa con el cerebro bayesiano?

La inferencia activa es la idea de que el comportamiento (acción) es una forma en que el organismo minimiza los errores de predicción o la sorpresa. En lugar de solo actualizar las creencias internas, el organismo actúa sobre el mundo para hacer que la entrada sensorial coincida con sus predicciones.

¿Puede la teoría bayesiana explicar los trastornos mentales?

Sí, se postula que muchos trastornos neurológicos y psiquiátricos podrían estar relacionados con fallos en los procesos de inferencia bayesiana del cerebro, como problemas para estimar la precisión de las señales o actualizar los modelos probabilísticos.

¿Es el cerebro realmente una máquina bayesiana perfecta?

La teoría bayesiana del cerebro lo propone como un modelo normativo ideal de cómo el cerebro *debería* procesar la información de manera óptima bajo incertidumbre. Si bien hay una creciente evidencia que apoya muchos de sus principios, es probable que el cerebro real utilice aproximaciones o algoritmos que se desvían de la inferencia bayesiana pura debido a limitaciones biológicas y computacionales.

Si quieres conocer otros artículos parecidos a El Cerebro Bayesiano: Inferencia y Predicción puedes visitar la categoría Neurociencia.