Las redes neuronales artificiales han revolucionado el campo de la inteligencia artificial, permitiendo a las máquinas realizar tareas complejas como reconocimiento de imágenes, procesamiento de lenguaje natural y predicción de datos. Sin embargo, el poder de estas redes reside en su capacidad para aprender de los datos. Este aprendizaje se logra a través de un proceso fundamental conocido como retropropagación.

A menudo, para quienes se inician en el aprendizaje profundo, la retropropagación puede parecer un concepto abstracto. No obstante, comprender su funcionamiento es esencial para entender cómo las redes neuronales se vuelven tan eficientes y precisas. Es el mecanismo que permite a un modelo corregir sus errores y mejorar iteración tras iteración.

- ¿Qué es la Retropropagación en Redes Neuronales?

- ¿Cómo Funciona la Retropropagación? El Proceso Paso a Paso

- Ventajas de Utilizar el Algoritmo de Retropropagación

- Limitaciones del Algoritmo de Retropropagación

- Un Ejemplo Conceptual: Entrenando una Red para XOR

- Mejores Prácticas para Optimizar la Retropropagación

- Preguntas Frecuentes sobre la Retropropagación

¿Qué es la Retropropagación en Redes Neuronales?

En esencia, la retropropagación (o backpropagation en inglés) es un algoritmo crucial utilizado para entrenar redes neuronales artificiales. Su función principal es ajustar los pesos y sesgos de la red basándose en la tasa de error obtenida durante la fase de predicción. Imagina que una red neuronal hace una predicción; si esta predicción es incorrecta, la retropropagación se encarga de calcular cuánto contribuyó cada neurona y cada conexión (peso) a ese error y cómo deben modificarse para reducirlo en el futuro.

Este proceso es la columna vertebral del entrenamiento. Permite que el modelo, a través de múltiples iteraciones (conocidas como épocas), refine sus parámetros internos hasta que la diferencia entre las predicciones del modelo y los valores reales (la "pérdida") sea mínima. Una red bien entrenada con retropropagación no solo predice con precisión los datos de entrenamiento, sino que también generaliza bien a datos nuevos y no vistos.

¿Cómo Funciona la Retropropagación? El Proceso Paso a Paso

El entrenamiento de una red neuronal mediante retropropagación implica un ciclo constante de dos fases principales:

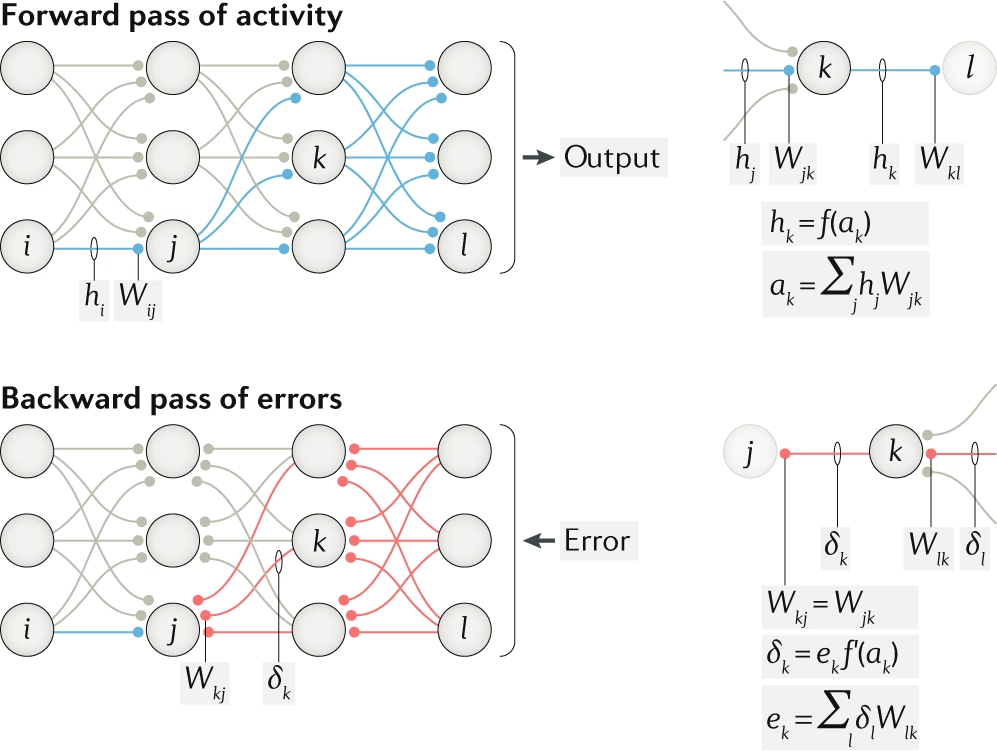

1. Propagación Hacia Adelante (Forward Pass): Los datos de entrada se introducen en la capa de entrada de la red y fluyen a través de las capas ocultas hasta llegar a la capa de salida. En cada neurona, se realiza una suma ponderada de las entradas (multiplicadas por sus respectivos pesos y sumando un sesgo), y luego se aplica una función de activación para producir una salida. Esta salida se convierte en la entrada para las neuronas de la siguiente capa. Al final de este proceso, la red produce una predicción.

2. Cálculo de la Pérdida (Loss Calculation): Se compara la predicción de la red con el valor real esperado. La diferencia entre estos dos valores se cuantifica mediante una función de pérdida (o función de coste). Esta función nos da un valor numérico que representa qué tan "mal" lo hizo la red en esa predicción particular.

3. Retropropagación del Error (Backward Pass): Aquí es donde entra la retropropagación. Partiendo de la capa de salida, donde se calculó la pérdida, el error se propaga "hacia atrás" a través de las capas de la red, en dirección opuesta a la propagación hacia adelante. El objetivo es calcular la "contribución al error" (el gradiente) de cada peso y sesgo en la red. Esto se hace utilizando cálculo, específicamente la regla de la cadena, para determinar cómo un pequeño cambio en cada parámetro afectaría la pérdida total.

4. Actualización de Pesos y Sesgos (Parameter Update): Una vez que se ha calculado el gradiente de la función de pérdida con respecto a cada peso y sesgo, se utiliza un algoritmo de optimización (como el descenso de gradiente) para ajustar estos parámetros. La idea es mover los pesos y sesgos en la dirección que disminuya la pérdida. La magnitud de este ajuste está determinada por la tasa de aprendizaje, un hiperparámetro que controla qué tan grandes son los pasos que damos en la dirección del descenso del gradiente.

Este ciclo de propagación hacia adelante, cálculo de pérdida, retropropagación y actualización de parámetros se repite miles o millones de veces utilizando diferentes subconjuntos de datos de entrenamiento (lotes) o ejemplos individuales, hasta que la red converge a un estado donde la pérdida es mínima y el modelo es capaz de realizar predicciones precisas.

Retropropagación vs. Propagación Hacia Adelante: Una Comparación

Aunque son dos fases distintas, la propagación hacia adelante y la retropropagación son interdependientes y fundamentales para el proceso de entrenamiento. Aquí se resumen sus principales diferencias:

| Característica | Propagación Hacia Adelante | Retropropagación |

|---|---|---|

| Dirección del Flujo | De la capa de entrada a la de salida | De la capa de salida a la de entrada |

| Propósito Principal | Calcular la salida de la red y la pérdida inicial | Calcular el gradiente de la pérdida con respecto a los pesos y sesgos |

| Base Matemática | Evaluación de funciones compuestas | Cálculo de derivadas parciales (gradientes) |

| Fase del Entrenamiento | Primera fase de cada iteración | Segunda fase de cada iteración (después del cálculo de pérdida) |

| Resultado | Predicción del modelo y valor de pérdida | Información para ajustar los pesos y sesgos |

Ventajas de Utilizar el Algoritmo de Retropropagación

La retropropagación no se convirtió en el método de entrenamiento estándar por casualidad. Presenta varias ventajas significativas:

- Facilidad de Implementación: A pesar de su base matemática (cálculo de gradientes), la implementación práctica en código es relativamente sencilla, ya que no requiere conocimiento previo específico sobre la estructura interna óptima de la red.

- Programación Directa: El algoritmo es bastante directo de programar una vez que se entienden los pasos, ya que solo requiere las entradas y la función de pérdida para calcular los ajustes necesarios.

- No Necesita Aprender Características Manualmente: La red aprende a extraer las características relevantes de los datos por sí misma durante el entrenamiento a través del ajuste de pesos, lo que acelera el proceso en comparación con métodos que requieren ingeniería de características manual.

- Flexibilidad: El algoritmo es aplicable a una amplia variedad de arquitecturas de redes neuronales y tipos de problemas (clasificación, regresión, etc.).

Limitaciones del Algoritmo de Retropropagación

A pesar de sus fortalezas, la retropropagación no es una solución mágica y tiene sus limitaciones:

- Dependencia de la Calidad de los Datos: El rendimiento del modelo entrenado con retropropagación es altamente sensible a la calidad de los datos de entrenamiento. Datos de alta calidad son esenciales.

- Sensibilidad al Ruido: Los datos ruidosos o inconsistentes pueden afectar negativamente el proceso de entrenamiento y los resultados finales.

- Tiempo de Entrenamiento: Entrenar redes neuronales profundas con grandes conjuntos de datos puede ser computacionalmente costoso y llevar mucho tiempo.

- Enfoque Matricial: El algoritmo está intrínsecamente ligado a operaciones matriciales, lo que, si bien es eficiente en hardware especializado (GPUs), puede presentar desafíos en ciertos entornos o para arquitecturas de red no estándar.

- Problemas de Convergencia: La red puede quedarse atascada en mínimos locales de la función de pérdida en lugar de alcanzar el mínimo global óptimo, aunque técnicas modernas de optimización han mitigado este problema.

Un Ejemplo Conceptual: Entrenando una Red para XOR

Para ilustrar el proceso, consideremos el clásico problema XOR (OR Exclusivo). Queremos entrenar una red neuronal para que aprenda la función XOR, que tiene la siguiente tabla de verdad:

| Entrada X1 | Entrada X2 | Salida Y |

|---|---|---|

| 0 | 0 | 0 |

| 0 | 1 | 1 |

| 1 | 0 | 1 |

| 1 | 1 | 0 |

Diseñamos una red simple: una capa de entrada (con un sesgo), una capa oculta y una capa de salida. Inicialmente, los pesos de todas las conexiones se establecen con valores aleatorios o predefinidos (por ejemplo, todos a 1, como en el ejemplo proporcionado en la información fuente, aunque esto no es una buena práctica general). Elegimos una función de activación simple (como la identidad o sigmoid/ReLU en un caso más realista) y una función de pérdida (como el error cuadrático medio o la pérdida de entropía cruzada).

Tomemos el primer ejemplo de entrenamiento: Entrada {0, 0}, Salida esperada 0.

1. Propagación Hacia Adelante: Introducimos {0, 0} en la capa de entrada. Los valores fluyen a través de las conexiones, se multiplican por los pesos iniciales, se suman (con sesgos) en las neuronas ocultas, se aplican las funciones de activación, y el proceso se repite hasta la capa de salida. La red produce una salida (una predicción), que, con pesos iniciales aleatorios, probablemente estará lejos de 0.

2. Cálculo de la Pérdida: Comparamos la salida predicha con la salida esperada (0) y calculamos la pérdida utilizando la función de pérdida elegida. La pérdida será alta porque la predicción fue incorrecta.

3. Retropropagación: Ahora usamos esta pérdida para el backward pass. Comenzamos en la capa de salida y calculamos cuánto contribuyó la neurona de salida al error total. Luego, propagamos esta "responsabilidad del error" (delta) hacia atrás a la capa oculta. Para cada neurona oculta, calculamos cuánto contribuyó a los errores de la capa de salida. Esto se hace multiplicando el delta de las neuronas conectadas en la capa siguiente por los pesos de las conexiones y la derivada de la función de activación local. Este proceso continúa hasta la capa de entrada.

4. Actualización de Pesos: Con los deltas calculados para cada neurona y los valores de activación de la capa anterior, podemos calcular el gradiente de la pérdida con respecto a cada peso y sesgo. Por ejemplo, el ajuste a un peso entre una neurona oculta y la neurona de salida dependerá del delta de la neurona de salida y la activación de la neurona oculta. Usando el descenso de gradiente, cada peso se actualiza restándole un pequeño paso (determinado por la tasa de aprendizaje) en la dirección del gradiente negativo (la dirección de máxima disminución de la pérdida).

Este proceso se repite para los otros ejemplos de entrenamiento ({0, 1}, {1, 0}, {1, 1}). Típicamente, se procesan todos los ejemplos en un lote o en una época completa antes de realizar la actualización de pesos, o se actualizan después de cada ejemplo (descenso de gradiente estocástico). Al repetir este ciclo durante muchas épocas, la red ajusta progresivamente sus pesos y sesgos, reduciendo la pérdida hasta que pueda predecir correctamente la salida para cada combinación de entrada XOR.

Mejores Prácticas para Optimizar la Retropropagación

Para maximizar la efectividad del entrenamiento con retropropagación, es útil seguir ciertas prácticas:

- Seleccionar un Método de Optimización Adecuado: Si bien el descenso de gradiente es la base, existen variantes (como Descenso de Gradiente Estocástico - SGD, Adam, RMSprop) que pueden acelerar el entrenamiento y mejorar la convergencia. SGD es rápido pero puede ser ruidoso; otros optimizadores adaptativos suelen ser preferibles en la práctica.

- Proporcionar Datos Suficientes y Diversos: Un gran volumen de datos de entrenamiento de alta calidad es crucial para que la red aprenda patrones complejos y generalice bien. La diversidad en los datos expone al modelo a una amplia gama de escenarios posibles.

- Limpiar y Preprocesar los Datos: La calidad de los datos impacta enormemente. La normalización de los valores de entrada (escalarlos para que tengan media cero y desviación estándar uno) es una práctica común que ayuda a que el algoritmo de optimización funcione de manera más eficiente. Eliminar o tratar datos ruidosos o atípicos también es vital.

- Ajustar Cuidadosamente la Tasa de Aprendizaje: La tasa de aprendizaje es uno de los hiperparámetros más críticos. Una tasa demasiado alta puede hacer que el algoritmo "salte" el mínimo óptimo o diverja. Una tasa demasiado baja hará que el entrenamiento sea muy lento. A menudo se requiere experimentación para encontrar un valor adecuado, o se utilizan tasas de aprendizaje adaptativas o programas de decaimiento de la tasa de aprendizaje.

- Regularización: Técnicas como L1, L2 o Dropout pueden ayudar a prevenir el sobreajuste (overfitting), donde la red aprende los datos de entrenamiento demasiado bien, pero falla en generalizar a datos nuevos. La retropropagación funciona en conjunto con estas técnicas.

- Monitorear el Entrenamiento: Observar la pérdida en el conjunto de entrenamiento y en un conjunto de validación separado durante el entrenamiento ayuda a diagnosticar problemas (como sobreajuste o subajuste) y a decidir cuándo detener el entrenamiento.

- Probar con Diferentes Ejemplos: Una vez entrenado, es fundamental evaluar el modelo con datos completamente nuevos (conjunto de prueba) para obtener una estimación realista de su rendimiento en el mundo real.

Preguntas Frecuentes sobre la Retropropagación

¿Por qué necesitamos retropropagación en una red neuronal?

La retropropagación es necesaria para entrenar la red. Permite calcular cómo los errores en la salida se relacionan con los pesos y sesgos internos, lo que a su vez permite ajustar estos parámetros para minimizar la pérdida y mejorar la precisión del modelo.

¿Qué es exactamente la retropropagación?

Es un algoritmo que, partiendo del error calculado en la capa de salida de una red neuronal, propaga este error hacia atrás a través de las capas, calculando el gradiente de la función de pérdida con respecto a cada peso y sesgo. Este gradiente indica la dirección en la que los parámetros deben ajustarse para reducir el error.

¿Todas las redes neuronales usan retropropagación?

La retropropagación es el algoritmo de entrenamiento más común y efectivo para muchos tipos de redes neuronales artificiales (como las redes neuronales feedforward y convolucionales). Sin embargo, existen otras arquitecturas y algoritmos de entrenamiento alternativos, algunos de los cuales buscan ser más biológicamente plausibles o adecuados para tareas específicas, aunque la retropropagación sigue siendo dominante en el aprendizaje profundo práctico.

En resumen, la retropropagación es la técnica fundamental que permite a las redes neuronales aprender de la experiencia (datos). Al calcular eficientemente cómo cada conexión contribuye al error, posibilita el ajuste iterativo de miles o millones de parámetros, transformando una red inicial aleatoria en un modelo capaz de realizar tareas complejas con alta precisión. Su dominio es clave para cualquiera que desee comprender o trabajar en el campo del aprendizaje profundo.

Si quieres conocer otros artículos parecidos a Retropropagación: Clave del Aprendizaje Profundo puedes visitar la categoría Neurociencia.