La atención es una capacidad fundamental, ampliamente discutida en el ámbito público y profundamente estudiada científicamente. Posee múltiples definiciones que varían entre campos como la psicología, la neurociencia y, más recientemente, el machine learning. Como dijo William James en los albores de la psicología experimental, "Todo el mundo sabe lo que es la atención. Es la toma de posesión por parte de la mente, de forma clara y vívida, de uno de los objetos o trenes de pensamiento simultáneamente posibles". Desde entonces, se han realizado numerosos intentos para definir y cuantificar este proceso con mayor precisión, identificando las arquitecturas mentales y neuronales subyacentes que lo originan. Sin embargo, la gran cantidad de enfoques experimentales y conceptualizaciones para estudiar lo que se considera un concepto único ha generado cierta controversia entre los investigadores. Como se afirmó en el título de un artículo reciente que abogaba por un enfoque más informado por la evolución, "Nadie sabe qué es la atención".

La atención está lejos de ser un concepto claro o unificado. Sin embargo, a pesar de sus muchas definiciones, vagas y a veces contradictorias, existe una cualidad central de la atención que es demostrablemente de gran importancia para el procesamiento de información en el cerebro y, cada vez más, en los sistemas artificiales. La atención es el control flexible de recursos computacionales limitados. La razón por la que esos recursos son limitados y la mejor manera de controlarlos variarán según el caso de uso, pero la capacidad de alterar y dirigir dinámicamente el flujo de información tiene claros beneficios para la adaptabilidad de cualquier sistema.

La comprensión de que la atención desempeña múltiples roles en el cerebro hace que su incorporación a las redes neuronales artificiales no sea sorprendente. Las redes neuronales artificiales son sistemas de procesamiento paralelo compuestos por unidades individuales diseñadas para imitar la función básica de entrada-salida de las neuronas. Estos modelos dominan actualmente la literatura de machine learning e inteligencia artificial (IA). Inicialmente construidas sin atención, ahora se han añadido diversos mecanismos para reconfigurar dinámicamente las representaciones o estructuras de estas redes.

En las siguientes secciones, cubriremos las diferentes formas en que se conceptualiza la atención en neurociencia y psicología, su conexión con otros temas neurocientíficos comunes, y luego resumiremos el estado de la investigación de la atención en machine learning, indicando sus contrapartes biológicas donde existan. Finalmente, exploraremos cómo la atención artificial puede seguir inspirándose en la biología para la producción de sistemas complejos e integradores.

El objetivo principal de este artículo es ofrecer a los investigadores en el campo de la IA o el machine learning una comprensión de cómo se conceptualiza y estudia la atención en neurociencia y psicología, para facilitar una mayor inspiración donde sea fructífero. Un objetivo secundario es informar a quienes estudian la atención biológica sobre cómo estos procesos se están operacionalizando en sistemas artificiales, ya que esto puede influir en la reflexión sobre las implicaciones funcionales de los hallazgos biológicos.

La Atención en Neurociencia y Psicología

El estudio científico de la atención comenzó en la psicología, donde la cuidadosa experimentación conductual puede dar lugar a demostraciones precisas de las tendencias y capacidades de la atención en diferentes circunstancias. La ciencia cognitiva y la psicología cognitiva buscan convertir estas observaciones en modelos de cómo los procesos mentales podrían crear tales patrones conductuales. Se han creado muchos modelos verbales y computacionales que postulan diferentes mecanismos subyacentes.

La influencia de la neurofisiología de células individuales en primates no humanos, junto con medios no invasivos de monitoreo de la actividad cerebral humana como EEG, fMRI y MEG, ha hecho posible la observación directa de los procesos neuronales subyacentes. A partir de esto, se han construido modelos computacionales de circuitos neuronales que pueden replicar ciertas características de las respuestas neuronales relacionadas con la atención.

En las siguientes subsecciones, se discutirán los hallazgos conductuales y neuronales de varias clases amplias de atención.

Atención General: Alerta y Vigilancia

En su forma más genérica, la atención podría describirse simplemente como un nivel general de alerta o capacidad para interactuar con el entorno. De esta manera, interactúa con el estado de excitación (arousal) y el espectro sueño-vigilia. La vigilancia en psicología se refiere a la capacidad de mantener la atención y, por lo tanto, también está relacionada. Es importante notar que, si bien el uso de estas palabras se agrupa en torno al mismo significado, a veces se utilizan de forma más específica en diferentes literaturas de nicho.

Estudiar sujetos en diferentes fases del ciclo sueño-vigilia, bajo privación de sueño o bajo sedantes, ofrece una visión de cómo esta forma de atención puede variar y cuáles son las consecuencias conductuales. Al asignar a los sujetos tareas repetitivas que requieren un nivel de atención sostenida, como mantener una bola dentro de una cierta región en una pantalla, los investigadores han observado períodos prolongados de bajo rendimiento en pacientes somnolientos que se correlacionan con cambios en las señales de EEG. Sin embargo, hay formas en que las tareas pueden hacerse más atractivas para lograr un mayor rendimiento incluso en estados somnolientos o sedados. Esto incluye aumentar la promesa de recompensa por realizar la tarea, añadir novedad o irregularidad, o introducir estrés. Por lo tanto, la atención general parece tener reservas limitadas que no se desplegarán en el caso de una tarea mundana o insuficientemente gratificante, pero a las que se puede recurrir para trabajos más prometedores o interesantes.

Curiosamente, un mayor estado de excitación (arousal) no siempre es beneficioso. La curva de Yerkes-Dodson es una U invertida que representa el rendimiento en función de la alerta en tareas suficientemente desafiantes: en niveles bajos de alerta, el rendimiento es pobre; en niveles medios, es bueno; y en niveles altos, vuelve a ser pobre. El estudio original utilizó descargas eléctricas en ratones para variar el nivel de alerta, pero el hallazgo se ha replicado con otras medidas. Esto puede explicar por qué los psicoestimulantes como Adderall o la cafeína pueden aumentar el enfoque en algunas personas a ciertas dosis, pero se vuelven perjudiciales para otras.

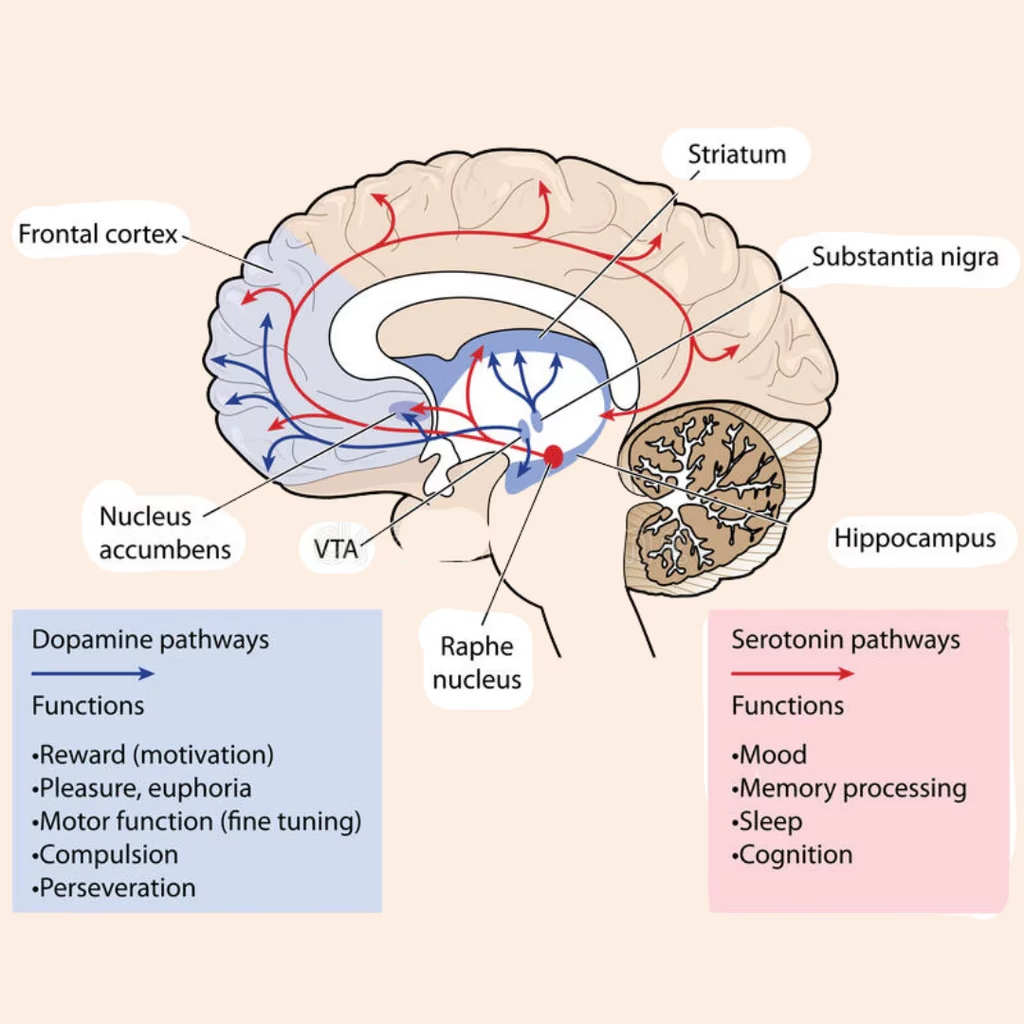

Los circuitos neuronales que subyacen al ciclo sueño-vigilia se encuentran principalmente en el tronco encefálico. Estos circuitos controlan el flujo de información hacia el tálamo y luego hacia la corteza. Además, los sistemas neuromoduladores desempeñan un papel importante en el control de la atención generalizada. Se cree que la norepinefrina, la acetilcolina y la dopamina influyen en la alerta, la orientación hacia información importante y el control ejecutivo de la atención, respectivamente. La anatomía de los neuromoduladores también coincide con su función. Las neuronas que liberan norepinefrina, por ejemplo, tienen sus cuerpos celulares en el tronco encefálico, pero se proyectan muy ampliamente por todo el cerebro, lo que les permite controlar el procesamiento de información de manera general.

Atención Sensorial

Además de los niveles generales de excitación y alerta, la atención también puede ser desplegada selectivamente por un sujeto despierto hacia entradas sensoriales específicas. Estudiar la atención dentro del contexto de un sistema sensorial específico permite un control estricto tanto sobre los estímulos como sobre el foco de atención. Generalmente, la tarea utilizada para buscar este tipo de atención debe ser bastante desafiante. Por ejemplo, en una tarea de detección de cambios, la diferencia a detectar entre dos estímulos puede ser muy leve. De manera más general, la dificultad de la tarea se puede lograr presentando el estímulo durante un período muy corto o muy débilmente.

Una gran parte del estudio de la atención en neurociencia de sistemas y psicología se centra en la atención visual en particular. Esto puede reflejar la tendencia general en estos campos a enfatizar el estudio del procesamiento visual sobre otros sistemas sensoriales, junto con el papel dominante que juega la visión en el cerebro de los primates. Además, los estímulos visuales se utilizan con frecuencia en estudios destinados a abordar aspectos más generales y cognitivos de la atención.

La atención visual se puede dividir ampliamente en atención espacial y atención basada en características.

Atención Espacial Visual

Las sacadas son movimientos oculares pequeños y rápidos que se realizan varias veces por segundo. Dado que la fóvea ofrece la mayor resolución visual en la retina, elegir dónde colocarla es esencialmente una elección sobre dónde desplegar recursos computacionales limitados. De esta manera, los movimientos oculares indican el foco de atención. Como este cambio de atención es visible externamente, se conoce como atención visual manifiesta (overt).

Al rastrear los movimientos oculares mientras se presentan diferentes imágenes a los sujetos, los investigadores han identificado patrones de imagen que atraen automáticamente la atención. Dichos patrones se definen por bordes orientados, frecuencia espacial, contraste de color, intensidad o movimiento. Las regiones de la imagen que atraen la atención se consideran "salientes" y se computan de manera "ascendente" (bottom-up). Es decir, no requieren procesamiento consciente o esforzado para ser identificadas y probablemente son el resultado de detectores de características incorporados en el sistema visual. Como tal, la saliencia se puede computar muy rápidamente. Además, diferentes sujetos tienden a coincidir en qué regiones son salientes, especialmente aquellas identificadas en las primeras sacadas.

Las regiones salientes se pueden estudiar en situaciones de "libre visualización", es decir, cuando al sujeto no se le dan instrucciones específicas sobre cómo ver la imagen. Cuando se asigna una tarea particular, la interacción entre la atención ascendente (bottom-up) y "descendente" (top-down) se vuelve clara. Por ejemplo, cuando se les instruye a realizar una sacada hacia un objetivo visual específico de un conjunto, los sujetos pueden realizar incorrectamente una sacada hacia un distractor particularmente saliente. De manera más general, las instrucciones de la tarea pueden tener un efecto significativo en el patrón de sacadas generadas cuando los sujetos están viendo una imagen natural compleja y se les dan tareas de alto nivel (por ejemplo, se les pide que evalúen la edad de una persona o adivinen su estatus socioeconómico). Además, el patrón natural de movimientos oculares cuando los sujetos realizan tareas del mundo real, como preparar un sándwich, puede proporcionar información sobre los procesos cognitivos subyacentes.

Cuando los sujetos necesitan realizar múltiples sacadas seguidas, tienden a no regresar a lugares a los que han atendido recientemente y pueden tardar en responder si algo relevante ocurre allí. Este fenómeno se conoce como inhibición de retorno. Tal comportamiento impulsa al sistema visual a no solo explotar las regiones de la imagen consideradas originalmente más salientes, sino también a explorar otras áreas. También significa que el sistema generador de sacadas necesita tener una forma de memoria; se cree que esto se implementa mediante la inhibición a corto plazo de la representación de las ubicaciones atendidas recientemente.

Si bien los movimientos oculares son un medio eficaz para controlar la atención visual, no son la única opción. La atención espacial "encubierta" (covert) es una forma de enfatizar el procesamiento de diferentes ubicaciones espaciales sin un cambio manifiesto en la ubicación de la fóvea. Generalmente, en el estudio de la atención espacial encubierta, los sujetos deben fijar la vista en un punto central durante toda la tarea. Se les indica que atiendan encubiertamente a una ubicación en su visión periférica donde probablemente aparecerán estímulos relevantes para su tarea visual. Por ejemplo, en una tarea de discriminación de orientación, después de que se proporciona la señal espacial, un patrón orientado parpadeará en la ubicación señalada y el sujeto deberá indicar su orientación. En ensayos con señales inválidas (cuando el estímulo aparece en una ubicación no señalada), los sujetos rinden peor que en ensayos con señales válidas (o sin señales). Esto indica que la atención espacial encubierta es un recurso limitado que puede desplegarse de manera flexible y ayuda en el procesamiento de información visual.

La atención espacial encubierta es selectiva en el sentido de que se seleccionan ciertas regiones para su posterior procesamiento a expensas de otras. Esto se ha denominado el "foco" o "punto de mira" de la atención. Es importante destacar que, para la atención encubierta, a diferencia de la manifiesta, la entrada al sistema visual puede ser idéntica mientras que el procesamiento de esa entrada es flexiblemente selectivo.

La atención espacial encubierta también puede verse afectada por la saliencia ascendente (bottom-up). Si un objeto irrelevante pero saliente parpadea en una ubicación que luego tiene un estímulo relevante para la tarea, la atención espacial exógena atraída por el estímulo irrelevante puede aplicarse al estímulo relevante, posiblemente proporcionando un beneficio de rendimiento. Sin embargo, si parpadea en una ubicación irrelevante, no ayudará y puede perjudicar el rendimiento. La atención ascendente/exógena tiene un curso temporal rápido, afectando la atención encubierta durante 80-130 ms después de que aparece el distractor.

En algunas teorías de la atención, la atención espacial encubierta existe para ayudar a guiar la atención manifiesta. En particular, la teoría pre-motora de la atención postula que los mismos circuitos neuronales planifican las sacadas y controlan la atención espacial encubierta. Se sabe que el campo ocular frontal (FEF) está involucrado en el control de los movimientos oculares. Se ha demostrado que estimular las neuronas en el FEF a niveles demasiado bajos para provocar movimientos oculares crea efectos similares a la atención encubierta. De esta manera, la atención encubierta puede ser un medio para decidir dónde mirar abiertamente. La capacidad de atender encubiertamente puede ser adicionalmente útil en especies sociales, ya que los movimientos oculares transmiten información sobre el conocimiento y la intención que quizás sea mejor mantener en secreto.

Para estudiar los correlatos neuronales de la atención espacial encubierta, los investigadores identifican qué aspectos de la actividad neuronal difieren basándose únicamente en las diferencias en la señal de atención (y no en las diferencias en las características ascendentes de los estímulos). En los ensayos en los que se dirige la atención hacia el campo receptivo de una neurona registrada, se han observado muchos cambios en la actividad neuronal. Un hallazgo comúnmente reportado es un aumento en las tasas de disparo, típicamente del 20 al 30%. Sin embargo, la magnitud exacta del cambio depende del área cortical estudiada, mostrando las áreas posteriores cambios más fuertes. También se sabe que la atención afecta la variabilidad del disparo neuronal. En particular, disminuye la variabilidad ensayo a ensayo medida a través del Factor de Fano y disminuye las correlaciones de ruido entre pares de neuronas. Incluso se ha encontrado que la atención afecta las propiedades electrofisiológicas de las neuronas de una manera que reduce su probabilidad de disparar en ráfagas y también disminuye la altura de los potenciales de acción individuales.

En general, se cree que los cambios asociados con la atención aumentan la relación señal-ruido de las neuronas que representan el estímulo atendido; sin embargo, también pueden afectar la comunicación entre áreas cerebrales. Para ello, el efecto de la atención en la sincronía neuronal es importante. Dentro de un área visual, se ha demostrado que la atención aumenta la coherencia de los disparos en la banda gamma, es decir, en frecuencias entre 30 y 70 Hz. Cuando un grupo de neuronas dispara sincrónicamente, su capacidad para influir en áreas posteriores compartidas aumenta. Además, la atención también puede estar trabajando para coordinar directamente la comunicación entre áreas. La actividad sincrónica entre dos áreas visuales puede ser un signo de mayor comunicación y se ha demostrado que la atención aumenta la sincronía entre las neuronas que representan el estímulo atendido en las áreas V1 y V4, por ejemplo. El control de esta sincronización entre áreas parece ser llevado a cabo por el pulvinar.

Además de investigar cómo la atención impacta a las neuronas en las vías visuales, los estudios también han buscado la fuente de la atención descendente (top-down). El procesamiento de la atención ascendente (bottom-up) parece culminar en un mapa de saliencia producido en el área intraparietal lateral (LIP). Las células aquí responden cuando hay estímulos salientes en su campo receptivo, incluyendo distractores salientes irrelevantes para la tarea. Las áreas prefrontales como el FEF, por otro lado, parecen albergar las señales necesarias para el control descendente de la atención espacial y son menos receptivas a los distractores.

Aunque gran parte del trabajo sobre los correlatos neuronales de la atención sensorial se centra en la corteza, las áreas subcorticales parecen desempeñar un papel importante en el control y los beneficios de rendimiento de la atención también. En particular, el colículo superior ayuda tanto en la atención espacial encubierta como manifiesta, y la inactivación de esta región puede afectar la atención. Y, como se mencionó anteriormente, el pulvinar juega un papel en la atención, particularmente con respecto a los efectos de puerta en la corteza.

Atención a Características Visuales

La atención a características es otra forma de atención selectiva encubierta. En el estudio de la atención a características, en lugar de ser señalados para atender a una ubicación particular, se señala a los sujetos en cada ensayo para que atiendan a una característica visual particular, como un color específico, una forma particular o una cierta orientación. El objetivo de la tarea puede ser detectar si la característica señalada está presente en la pantalla o leer otra de sus cualidades (por ejemplo, responder "¿de qué color es el cuadrado?" debería resultar en que la atención se dirija primero a los cuadrados). Una señalización válida sobre la característica atendida mejora el rendimiento. Por ejemplo, cuando la atención se dirigió hacia una orientación particular, los sujetos pudieron detectar mejor patrones débiles de esa orientación que de cualquier otra orientación. Si bien la tarea general (por ejemplo, detección de un patrón orientado) sigue siendo la misma, las instrucciones específicas (detección de un patrón de 90° frente a 60° frente a 30°) se señalarán en cada ensayo individual, o posiblemente por bloques. La señalización exitosa ensayo a ensayo indica que esta forma de atención puede desplegarse de manera flexible en escalas de tiempo rápidas.

También se cree que las tareas de búsqueda visual activan la atención basada en características. En estas tareas, aparece un conjunto de estímulos en una pantalla y los sujetos necesitan indicar, con frecuencia con un movimiento ocular, la ubicación del estímulo señalado. Como generalmente se permite a los sujetos realizar sacadas durante toda la tarea mientras buscan el estímulo señalado, esta tarea combina la atención encubierta basada en características con la atención manifiesta. De hecho, se han encontrado señales de atención descendente (top-down) basada en características en el FEF, el área involucrada en la elección de la sacada. Debido a que ciertas características pueden crear un efecto de "aparición" (pop-out), por ejemplo, una única forma roja entre varias negras atraerá inmediatamente la atención, las tareas de búsqueda visual también activan la atención ascendente (bottom-up) que, dependiendo de la tarea, puede necesitar ser suprimida.

Los efectos neuronales de la atención basada en características en el sistema visual son generalmente similares a los de la atención espacial. Las neuronas que representan la característica atendida, por ejemplo, tienen tasas de disparo aumentadas, y aquellas que representan características muy diferentes tienen tasas suprimidas. Sin embargo, a diferencia de la atención espacial, la atención basada en características es espacialmente global. Esto significa que al desplegar la atención a una característica particular, la actividad de las neuronas que representan esa característica en cualquier lugar del espacio visual se modula. Otra diferencia entre la atención espacial y la atención a características es la cuestión de cómo las fuentes de atención descendente (top-down) se dirigen a las neuronas correctas en el sistema visual. El mapa retinotópico, en el que las células cercanas representan ubicaciones espaciales cercanas, hace que la dirección espacial sea sencilla, pero las células no están tan ordenadamente organizadas según las características visuales preferidas.

Los efectos de la atención espacial y a características parecen ser aditivos. Además, se cree que tanto la atención a características como la espacial crean sus efectos actuando sobre los circuitos neuronales locales que implementan la normalización divisiva en la corteza visual. El trabajo de modelado ha demostrado que muchos de los efectos neuronales de la atención selectiva pueden ser capturados asumiendo que las conexiones descendentes (top-down) proporcionan entradas sinápticas dirigidas a las células en estos circuitos. Sin embargo, los modelos que dependen de los efectos del neuromodulador acetilcolina también pueden replicar correlatos neuronales de la atención.

Se han encontrado posibles fuentes de atención descendente (top-down) basada en características en la corteza prefrontal, donde la actividad sostenida codifica la característica atendida. La inactivación del área ventral prearcuada afecta el rendimiento en tareas de búsqueda. Desde las áreas prefrontales, se cree que las señales de atención viajan de manera jerárquica inversa, en la que las áreas visuales superiores envían entradas a las que están debajo de ellas, que a su vez envían la señal a las que están debajo, y así sucesivamente. Esto significa que, en cada punto, las instrucciones para la atención deben transformarse en una representación que tenga sentido para la región objetivo.

Un tema estrechamente relacionado con la atención a características es la atención a objetos. Aquí, la atención no se despliega a una característica abstracta antes de un estímulo visual, sino que se aplica a un objeto particular en la escena visual. El paso inicial de actividad de feedforward a través de la jerarquía visual es capaz de segregar pre-atencionalmente los objetos de sus fondos en paralelo a través del campo visual, siempre que estos objetos tengan diferencias marcadas y salientes con el fondo. En escenas visuales más concurridas o complejas, se necesita procesamiento recurrente y serial para identificar diferentes objetos. El procesamiento serial implica mover recursos computacionales limitados de atención de una ubicación en la imagen a otra; puede tomar la forma de cambios en la atención espacial encubierta o manifiesta. Las conexiones recurrentes en el sistema visual, es decir, tanto las conexiones horizontales de neuronas cercanas en la misma área visual como las conexiones de retroalimentación de las áreas visuales superiores, ayudan en la segregación figura-fondo y la identificación de objetos. La cuestión de cómo el cerebro realiza la agrupación perceptual de características de bajo nivel en una identidad de objeto coherente se ha estudiado durante casi un siglo. Se cree que la atención puede ser necesaria para la agrupación, particularmente para objetos novedosos o complejos. Esto puede ser especialmente importante en tareas de búsqueda visual que requieren localizar un objeto definido por una conjunción de varias características.

Neuralmente, los efectos de la atención basada en objetos pueden extenderse lentamente a través del espacio a medida que se rastrean mentalmente partes de un objeto. Cambiar la atención a una ubicación fuera de un objeto parece incurrir en un costo mayor que cambiar a la misma distancia, pero dentro del objeto. Además, una vez que se aplica la atención a un objeto visual, se cree que activa la atención basada en características para las diferentes características de ese objeto en todo el campo visual.

Otra forma de atención a veces denominada atención a características implica atender a una dimensión de característica completa. Un ejemplo de esto es la prueba de Stroop, en la que los nombres de los colores están escritos en tinta de diferentes colores y los sujetos deben leer la palabra en sí o decir el color de la tinta. Aquí la atención no se puede desplegar a una característica específica de antemano, solo a las dimensiones palabra o color. Neuralmente, el cambio entre dimensiones parece afectar la codificación sensorial en la corriente visual y es controlado por áreas frontales.

Modelos Computacionales de Atención Visual

La atención visual, siendo uno de los temas más estudiados en la neurociencia de la atención, ha inspirado muchos modelos computacionales de cómo funciona la atención. En general, estos modelos sintetizan varios hallazgos neurofisiológicos para ayudar a explicar cómo surgen los impactos conductuales de la atención.

Se han ideado varios modelos computacionales destinados a calcular la saliencia. Estos modelos utilizan detectores de características visuales de bajo nivel, generalmente diseñados para coincidir con los del sistema visual, para crear un mapa de saliencia específico de la imagen que puede predecir los patrones de sacadas de los humanos en respuesta a la misma imagen. También se ha explorado otro enfoque para calcular la saliencia basado en principios fundamentales de la teoría de la información, que pudo explicar ciertos comportamientos de búsqueda visual.

Algunos de los correlatos conductuales y neuronales de la atención son similares, ya sea que la atención sea ascendente (bottom-up) o descendente (top-down). En el Modelo de Competición Sesgada (Biased Competition Model) de la atención, los estímulos compiten entre sí para dominar la respuesta neuronal. La atención (ascendente o descendente) puede, por lo tanto, trabajar sesgando esta competición hacia el estímulo que es el objetivo de la atención. Si bien el Modelo de Competición Sesgada a veces se utiliza simplemente como un "modelo verbal" para guiar la intuición, también se han construido instanciaciones computacionales explícitas del mismo. Un modelo jerárquico de la vía visual que incluía sesgos descendentes (top-down) así como competición local mediada a través de conexiones horizontales pudo replicar múltiples efectos neuronales de la atención. También se implementó un modelo que encarnaba principios similares pero utilizando neuronas de disparo (spiking neurons).

Se han construido modelos similares explícitamente para abordar tareas de nombramiento de atributos como la prueba de Stroop descrita anteriormente. El Modelo de Atención Selectiva (SLAM), por ejemplo, tiene competición local tanto en los módulos de codificación sensorial como en los de salida motora y puede imitar propiedades conocidas de los tiempos de respuesta en pruebas de tipo Stroop más fáciles y más desafiantes.

La percepción visual se ha enmarcado y modelado como un problema de inferencia bayesiana. Dentro de este contexto, la atención puede ayudar a resolver la incertidumbre en entornos donde la inferencia es más desafiante, típicamente modulando las probabilidades a priori. Por ejemplo, en Chikkerur et al. (2010), la atención espacial funciona para reducir la incertidumbre sobre la identidad del objeto y la atención a características reduce la incertidumbre espacial. Estos principios pueden capturar características conductuales y neuronales de la atención y pueden implementarse en un modelo neuronal de inspiración biológica.

El modelo de ganancia por similitud de características de la atención (Feature Similarity Gain Model - FSGM) es una descripción de los efectos neuronales de la atención descendente (top-down) que se puede aplicar tanto en el dominio espacial como en el de características. Dice que la forma en que la respuesta de una neurona es modulada por la atención depende de la sintonización de esa neurona. La sintonización es una descripción de cómo una neurona responde a diferentes estímulos, por lo que según el FSGM, una neurona que prefiere (es decir, responde fuertemente a), por ejemplo, el color azul, verá su actividad aumentada por la atención descendente (top-down) al azul. El FSGM también dice que la atención a estímulos no preferidos causará una disminución en el disparo y que, ya sea aumentada o disminuida, la actividad se escala multiplicativamente por la atención. Aunque inicialmente no se definió como un modelo computacional, esta forma de modulación neuronal se ha demostrado posteriormente mediante modelado como eficaz para mejorar el rendimiento en tareas visuales desafiantes.

Otros modelos conceptualizan la atención como un enrutamiento dinámico de información a través de una red. Una implementación de esta forma de atención se puede encontrar en el Modelo de Atención Selectiva para Identificación (SAIM). Aquí, la atención enruta información de la retina a una representación considerada el "foco de atención"; dependiendo de la tarea actual, diferentes partes de la representación retinal se mapearán al foco de atención.

Atención en Otras Modalidades Sensoriales

Un ejemplo famoso de la necesidad de atención selectiva en la audición es el "problema del cóctel": la dificultad de concentrarse en el habla de un orador en una sala concurrida con múltiples oradores y otros ruidos. Se cree que resolver el problema implica una selección "temprana" en la que se utilizan características de bajo nivel de una voz, como el tono, para determinar qué información auditiva se transmite para su posterior procesamiento lingüístico. Curiosamente, la atención auditiva selectiva tiene la capacidad de controlar la actividad neuronal incluso en el nivel más temprano del procesamiento auditivo, la cóclea.

La atención espacial y a características también se han explorado en el sistema somatosensorial. Los sujetos señalados para esperar un toque en diferentes partes de su cuerpo son más capaces de detectar la sensación cuando esa señal es válida. Sin embargo, estos efectos parecen ser más débiles que en el sistema visual. Los tiempos de reacción son más rápidos en una tarea de detección cuando se señala a los sujetos la orientación de un estímulo en su dedo.

En un estudio que evaluó la capacidad de los sujetos para detectar un sabor para el que habían sido señalados, se demostró que los sabores señalados válidamente pueden detectarse a concentraciones más bajas que los no señalados. Esto imita los efectos conductuales encontrados con la atención visual basada en características. La atención a características olfativas no se ha explorado a fondo, aunque las expectativas visualmente inducidas sobre un olor pueden ayudar a su detección.

La atención también puede extenderse a través de modalidades para realizar tareas que requieren la integración de múltiples señales sensoriales. En general, el uso de múltiples señales sensoriales congruentes ayuda a la detección de objetos en comparación con depender de una sola modalidad. Curiosamente, algunos estudios sugieren que los humanos pueden tener un sesgo hacia el dominio visual, incluso cuando la señal de otro dominio es igualmente válida. Específicamente, el dominio visual parece dominar más en tareas que requieren identificar la ubicación espacial de una señal. Esto se puede ver más fácilmente en la ventriloquia, donde la señal visual del movimiento de la boca del muñeco anula la evidencia auditiva sobre la verdadera ubicación de la fuente vocal. La evidencia visual también puede anular la evidencia táctil, por ejemplo, en el contexto de la ilusión del brazo de goma.

Otro efecto de la naturaleza transmodal del procesamiento sensorial es que una señal de atención en una modalidad puede causar una orientación de la atención en otra modalidad. Generalmente, los efectos de atención en la modalidad no señalada son más débiles. Esta interacción transmodal puede ocurrir en el contexto de la atención tanto endógena ("descendente") como exógena ("ascendente").

Atención y Control Ejecutivo

Con múltiples tareas compitiendo simultáneamente, se necesita un control ejecutivo central para decidir en cuál participar y cuándo. Más aún, la mejor manera de ejecutar las tareas puede depender de la historia y el contexto. Combinar las entradas sensoriales con el conocimiento pasado para coordinar múltiples sistemas con el fin de seleccionar y ejecutar tareas de manera eficiente es el papel del control ejecutivo, y este control generalmente se asocia con la corteza prefrontal. Como se mencionó anteriormente, también se han localizado fuentes de atención visual descendente (top-down) en regiones prefrontales. La atención puede considerarse razonablemente como el resultado del control ejecutivo. Por lo tanto, el sistema de control ejecutivo debe seleccionar los objetivos de la atención y comunicarlo a los sistemas responsables de implementarla. Según la teoría de la jerarquía inversa descrita anteriormente, las áreas superiores envían señales a aquellas de las que reciben entrada, que a su vez envían la señal a las que están debajo, y así sucesivamente. Esto significa que, en cada punto, las instrucciones para la atención deben transformarse en una representación que tenga sentido para la región objetivo. A través de este proceso, los objetivos de alto nivel de la región de control ejecutivo pueden conducir a cambios muy específicos, por ejemplo, en el procesamiento sensorial temprano.

El control ejecutivo y la memoria de trabajo también están entrelazados, ya que la capacidad de utilizar información pasada, así como de mantener un objetivo actual en mente, requiere memoria de trabajo. Además, la memoria de trabajo se identifica frecuentemente como actividad sostenida en áreas prefrontales. Una consecuencia de la relación tripartita entre el control ejecutivo, la memoria de trabajo y la atención es que los contenidos de la memoria de trabajo pueden afectar la atención, incluso cuando no es deseable para la tarea. Por ejemplo, si un sujeto tiene que mantener un objeto en la memoria de trabajo mientras realiza simultáneamente una búsqueda visual de un objeto separado, la presencia del objeto almacenado en el conjunto de búsqueda puede interferir negativamente con la búsqueda. Esto sugiere que la memoria de trabajo puede interferir con el control ejecutivo de la atención. Sin embargo, aún parece haber elementos adicionales de ese control que la memoria de trabajo por sí sola no interrumpe. Esto se puede ver en estudios en los que el rendimiento de la búsqueda visual es aún peor cuando los sujetos creen que necesitarán informar sobre el elemento memorizado, pero en su lugar se les muestra un conjunto de búsqueda para el elemento atendido. Esto sugiere que, si bien todos los objetos en la memoria de trabajo pueden tener alguna influencia sobre la atención, el control ejecutivo puede elegir cuáles tendrán la mayor.

Más allá del control flexible de la atención dentro de una modalidad sensorial, la atención también puede cambiarse entre modalidades. Los experimentos conductuales indican que cambiar la atención entre dos tareas diferentes dentro de una modalidad sensorial (por ejemplo, pasar de localizar un objeto visual a identificarlo) o entre modalidades sensoriales (cambiar de una tarea auditiva a una visual) incurre en un costo computacional. Este costo generalmente se mide por la medida en que el rendimiento es peor en los ensayos justo después de que se ha cambiado la tarea, en comparación con aquellos en los que se repite la misma tarea. Curiosamente, el cambio de tarea dentro de una modalidad parece incurrir en un costo mayor que el cambio entre modalidades. Se encuentra un resultado similar al cambiar entre o a través de modos de respuesta (por ejemplo, presionar un botón frente a un informe verbal), lo que sugiere que esto no es específico del procesamiento sensorial. Se cree que tales hallazgos provienen del hecho de que el cambio dentro de una modalidad requiere una reconfiguración de los mismos circuitos neuronales, lo cual es más difícil que simplemente activar la circuitería de un sistema sensorial diferente. Un control ejecutivo eficiente debería ser consciente de estos costos al decidir cambiar la atención e idealmente intentar minimizarlos; se ha demostrado que los costos de cambio pueden reducirse con el entrenamiento.

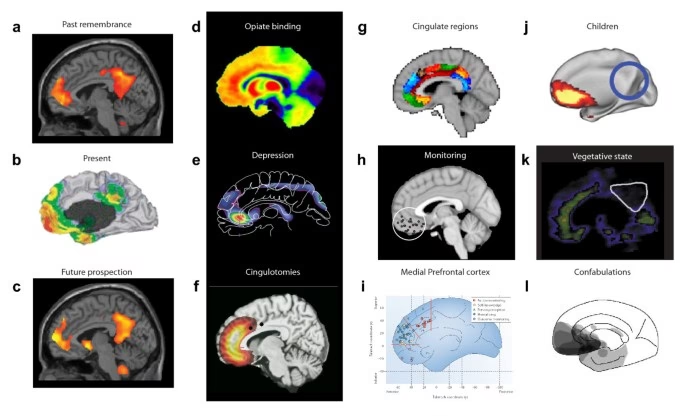

La pregunta final sobre el control ejecutivo de la atención es cómo evoluciona con el aprendizaje. Los estudios de movimientos oculares indican que los elementos buscados pueden detectarse más rápidamente en entornos familiares que en entornos novedosos, lo que sugiere que las asociaciones previamente aprendidas guían la atención manifiesta. Se cree que tales beneficios dependen del hipocampo. En general, sin embargo, el aprendizaje de cómo dirigir la atención no se estudia tanto como otros aspectos del proceso atencional. Algunos estudios han demostrado que los sujetos pueden mejorar su capacidad para suprimir información de tarea irrelevante, y la generalidad de esa supresión depende del procedimiento de entrenamiento. Al observar los correlatos neuronales del aprendizaje atencional, los resultados de imágenes sugieren que los cambios neuronales asociados con el aprendizaje no ocurren en las vías sensoriales en sí mismas, sino en áreas más asociadas con el control atencional. Aunque no siempre es fácil de estudiar, el desarrollo de los sistemas atencionales en la infancia temprana y la niñez puede proporcionar más pistas sobre cómo se puede aprender la atención.

Atención y Memoria

La atención y la memoria tienen muchas formas posibles de interacción. Si la memoria tiene una capacidad limitada, por ejemplo, tiene sentido que el cerebro sea selectivo sobre lo que se le permite ingresar. De esta manera, la capacidad de la atención para seleccionar dinámicamente un subconjunto de la información total se adapta bien a las necesidades del sistema de memoria. En sentido contrario, decidir recordar una memoria específica es una elección sobre cómo desplegar recursos computacionales limitados. Por lo tanto, tanto la codificación como la recuperación de la memoria pueden depender de la atención.

El papel de la atención en la codificación de la memoria parece bastante fuerte. Para que la información se codifique correctamente en la memoria, es mejor que sea el objetivo de la atención. Cuando se pide a los sujetos que memoricen una lista de palabras mientras participan simultáneamente en una tarea secundaria que divide su atención, su capacidad para recordar conscientemente esas palabras más tarde se ve afectada (aunque su capacidad para reconocer las palabras como familiares no se ve tan afectada). Los estudios de imagen han demostrado que aumentar la dificultad de la tarea secundaria debilita el patrón de actividad relacionado con la codificación de la memoria en el giro frontal inferior ventral izquierdo y el hipocampo anterior, y aumenta la representación de la información de la tarea secundaria en las regiones prefrontales dorsolaterales y parietales superiores. Por lo tanto, sin la limitada capacidad de procesamiento neuronal dedicada a la tarea de codificación, la memoria sufre. La atención también se ha implicado en la codificación de memorias definidas espacialmente y parece estabilizar las representaciones de las células de lugar.

El aprendizaje estadístico implícito también puede ser sesgado por la atención. Por ejemplo, en Turk-Browne et al. (2005), los sujetos observaron un flujo de estímulos compuesto por formas rojas y verdes. La tarea era detectar cuándo aparecía una forma del color atendido dos veces seguidas. Sin que los sujetos lo supieran, existían ciertas regularidades estadísticas en el flujo, de modo que había tríos de formas que probablemente ocurrían juntas. Al mostrarles dos conjuntos de tres formas, uno un trío real que co-ocurría y otro una selección aleatoria de formas del mismo color, los sujetos reconocieron el trío real como más familiar, pero solo si los tríos eran del color atendido. Las regularidades estadísticas de las formas no atendidas no se aprendieron.

Sin embargo, puede ocurrir cierto aprendizaje incluso sin atención consciente. Por ejemplo, en Watanabe (2003), los pacientes participaban en una tarea de detección de letras ubicada centralmente en su campo visual, mientras se mostraba movimiento de puntos aleatorios en el fondo con contraste subumbral. El movimiento tenía una coherencia del 10% en una dirección que estaba correlacionada con la letra presentada en ese momento. Antes y después de aprender esta tarea, los sujetos realizaron una tarea de clasificación de dirección por encima del umbral. Después de aprender la tarea, la clasificación de dirección mejoró solo para la dirección asociada con las letras objetivo. Esto sugiere que una señal relacionada con la recompensa activada por el objetivo llevó al aprendizaje sobre un componente no atendido del estímulo.

Muchos estudios conductuales han explorado hasta qué punto se necesita la atención para la recuperación de la memoria. Por ejemplo, al pedir a los sujetos que recuerden simultáneamente una lista de palabras previamente memorizadas y se dediquen a una tarea secundaria como clasificar cartas, los investigadores pueden determinar si la recuperación de la memoria utiliza el mismo conjunto limitado de recursos computacionales limitados que la tarea. Algunos de estos estudios han encontrado que la recuperación se ve afectada por la co-ocurrencia de una tarea que exige atención, lo que sugiere que es un proceso dependiente de la atención. Sin embargo, los hallazgos exactos dependen de los detalles de la memoria y las tareas no relacionadas con la memoria utilizadas.

Incluso si la recuperación de la memoria no utiliza recursos computacionales limitados compartidos, está claro que algunas memorias se seleccionan para una recuperación más vívida en un momento dado que otras. Por lo tanto, debe ocurrir un proceso de selección. Un examen de los resultados de neuroimagen sugiere que las mismas regiones cerebrales parietales responsables de la asignación descendente (top-down) y la captura ascendente (bottom-up) de la atención pueden desempeñar roles análogos durante la recuperación de la memoria.

Los estudios de recuperación de memoria suelen examinar la memoria a mediano o largo plazo, pero también se ha propuesto un mecanismo para la atención a elementos en la memoria de trabajo. Se basa en dos mecanismos diferentes de memoria de trabajo: trazas sinápticas para los elementos no atendidos y actividad sostenida para el elemento atendido.

Algunas formas de memoria ocurren automáticamente y dentro de la propia corriente de procesamiento sensorial. El priming es un fenómeno bien conocido en psicología en el que la presencia de un estímulo en un momento dado afecta la forma en que se procesan o interpretan los estímulos posteriores. Por ejemplo, la palabra "doctor" puede ser reconocida más rápidamente después de la palabra "hospital" que de la palabra "escuela". De esta manera, el priming requiere una forma de memoria implícita para permitir que los estímulos previos afecten a los actuales. Varios estudios sobre el priming conceptual o semántico indican que se requiere atención al primer estímulo para que ocurran los efectos de priming; esto refleja los hallazgos de que se requiere atención para la codificación de la memoria en general.

La mayoría del priming es positivo, lo que significa que la presencia de un estímulo en un momento dado hace que la detección y el procesamiento de este o de un estímulo relacionado sean más probables en un momento posterior. De esta manera, el priming puede considerarse como un sesgo de la atención ascendente (bottom-up). Sin embargo, la atención descendente (top-down) también puede crear priming negativo. En el priming negativo, cuando los estímulos que funcionaron como distractores en el ensayo anterior sirven como objetivo de atención en el ensayo actual, el rendimiento se ve afectado. Esto puede deberse a un efecto residual en el que los mecanismos de supresión de distractores aún están activados para el estímulo ahora objetivo.

La adaptación también puede considerarse una forma de memoria implícita. Aquí, las respuestas neuronales disminuyen después de la exposición repetida al mismo estímulo. Al reducir la respuesta a la repetición, los cambios en el estímulo se vuelven más salientes. La atención, al aumentar la respuesta neuronal a los estímulos atendidos, contrarresta los efectos de la adaptación. Por lo tanto, tanto con el priming como con la adaptación, la atención descendente (top-down) puede superar procesos automáticos que ocurren en niveles inferiores y que pueden estar guiando la atención ascendente (bottom-up).

La Atención en Machine Learning

Aunque el concepto de atención artificial ha surgido antes del resurgimiento actual de las redes neuronales artificiales, muchos de sus usos populares hoy en día se centran en las Redes Neuronales Artificiales (ANNs). El uso de mecanismos de atención en redes neuronales artificiales surgió, al igual que la aparente necesidad de atención en el cerebro, como un medio para hacer que los sistemas neuronales fueran más flexibles. Los mecanismos de atención en machine learning permiten que una única red neuronal artificial entrenada funcione bien en múltiples tareas o tareas con entradas de longitud, tamaño o estructura variable. Si bien el espíritu de la atención en machine learning ciertamente se inspira en la psicología, sus implementaciones no siempre coinciden con lo que se sabe sobre la atención biológica, como se observará a continuación.

En la forma de atención desarrollada originalmente para las ANNs, los mecanismos de atención funcionaban dentro de un marco codificador-decodificador y en el contexto de modelos de secuencia. Específicamente, una secuencia de entrada se pasará a través de un codificador (probablemente una red neuronal recurrente) y la tarea del decodificador (también probablemente una red neuronal recurrente) será generar otra secuencia. Conectando el codificador y el decodificador hay un mecanismo de atención.

Comúnmente, la salida del codificador es un conjunto de vectores, uno para cada elemento en la secuencia de entrada. La atención ayuda a determinar cuál de estos vectores debe usarse para generar la salida. Debido a que la secuencia de salida se genera dinámicamente elemento por elemento, la atención puede resaltar dinámicamente diferentes vectores codificados en cada punto temporal. Esto permite al decodificador utilizar de manera flexible las partes más relevantes de la secuencia de entrada.

La tarea específica del mecanismo de atención es producir un conjunto de ponderaciones escalares, una para cada uno de los vectores codificados. En cada paso t, el mecanismo de atención tomará información sobre el estado oculto anterior del decodificador y los vectores codificados para producir ponderaciones no normalizadas. Dado que la atención es un recurso computacional limitado, estas ponderaciones deben representar importancia relativa. Para asegurar que los valores sumen uno, las ponderaciones no normalizadas se pasan a través de una función softmax. Estos valores de atención escalan los vectores codificados para crear un único vector de contexto en el que se puede condicionar el decodificador.

Esta forma de atención se puede hacer completamente diferenciable, por lo que toda la red puede entrenarse de extremo a extremo con descenso de gradiente simple.

Este tipo de atención artificial es, por lo tanto, una forma de re-ponderación iterativa. Específicamente, resalta dinámicamente diferentes componentes de una entrada preprocesada a medida que se necesitan para la generación de salida. Esto la hace flexible y dependiente del contexto, como la atención biológica. Como tal, también es inherentemente dinámica. Si bien el modelado de secuencias ya tiene un componente temporal implícito, esta forma de atención también se puede aplicar a entradas y salidas estáticas (como se discutirá a continuación en el contexto del procesamiento de imágenes) y, por lo tanto, introducirá dinámica en el modelo.

En el marco tradicional codificador-decodificador sin atención, el codificador producía un vector de longitud fija que era independiente de la longitud o características de la entrada y estático durante el curso de la decodificación. Esto forzaba a secuencias largas o secuencias con estructura compleja a ser representadas con la misma dimensionalidad que las más cortas o simples, y no permitía al decodificador interrogar diferentes partes de la entrada durante el proceso de decodificación. Pero codificar la entrada como un conjunto de vectores de igual longitud que la secuencia de entrada hace posible que el decodificador atienda selectivamente a la parte de la secuencia de entrada relevante en cada punto temporal de la decodificación. Nuevamente, al igual que en las interpretaciones de la atención en el cerebro, la atención en sistemas artificiales es útil como una forma de manejar recursos computacionales limitados de manera flexible. El decodificador no puede condicionarse razonablemente a la totalidad de la entrada, por lo que en algún momento debe introducirse un cuello de botella. En el sistema sin atención, el vector de codificación de longitud fija era un cuello de botella. Cuando se añade un mecanismo de atención, la codificación puede ser mayor porque el cuello de botella (en forma del vector de contexto) se producirá dinámicamente a medida que el decodificador determine a qué parte de la entrada atender.

La motivación para añadir tales mecanismos de atención a los sistemas artificiales es, por supuesto, mejorar su rendimiento. Pero otro beneficio declarado de la atención es la interpretabilidad. Al identificar en qué partes de la entrada se pone atención (es decir, qué valores son altos) durante el proceso de decodificación, puede ser posible comprender por qué el decodificador produjo la salida que produjo. Sin embargo, se debe tener precaución al interpretar las salidas de atención, ya que no siempre explican el comportamiento del modelo como se esperaba.

En las siguientes subsecciones, se discutirán aplicaciones específicas de este concepto general de atención, junto con algunas que no encajan perfectamente en este marco. También se destacarán otras analogías con la biología.

Atención en Procesamiento de Lenguaje Natural (PLN)

Como se describió anteriormente, los mecanismos de atención se han añadido con frecuencia a modelos encargados de procesar secuencias. El procesamiento de lenguaje natural (PLN) es una de las áreas de aplicación más comunes para el modelado de secuencias. Y, aunque no fue el dominio original de la atención en machine learning, ni tiene la mayor similitud con la biología, el PLN es también una de las áreas de aplicación más comunes para la atención.

Una aplicación temprana de esta forma de atención en redes neuronales artificiales fue a la tarea de traducción. En este trabajo, una red neuronal recurrente codifica la oración de entrada como un conjunto de vectores de "anotación", uno para cada palabra de la oración. La salida, una oración en el idioma objetivo, es generada palabra por palabra por una red neuronal recurrente. La probabilidad de cada palabra generada es una función de la palabra previamente generada, el estado oculto de la red neuronal recurrente y un vector de contexto generado por el mecanismo de atención. Aquí, el mecanismo de atención es una pequeña red neuronal feedforward que toma el estado oculto de la red de salida, así como el vector de anotación actual, para crear la ponderación sobre todos los vectores de anotación.

Mezclar información de todas las palabras de la oración de esta manera permite que la red utilice partes anteriores o posteriores al generar una palabra de salida. Esto puede ser especialmente útil para traducir entre idiomas con diferentes órdenes de palabras estándar. Al visualizar las ubicaciones en la oración de entrada a las que se aplicó atención, los autores observaron que la atención ayudaba con este problema.

Desde esta aplicación inicial, se han desarrollado muchas variantes de redes de atención para la traducción automática. En Firat et al. (2016), el mecanismo de atención se adaptó para poder usarse para traducir entre múltiples pares de idiomas en lugar de solo uno. En Luong et al. (2015), los autores exploran diferentes estructuras de atención para determinar si la capacidad de acceder a todas las palabras de entrada a la vez es necesaria. Y en Cheng et al. (2016), se añadieron mecanismos de atención a las redes neuronales recurrentes que realizan la codificación y decodificación de oraciones para crear representaciones de oraciones de manera más flexible.

En 2017, el influyente artículo "Attention is All You Need" utilizó un estilo de arquitectura muy diferente para la traducción automática. Este modelo no tiene ninguna recurrencia, lo que simplifica su entrenamiento. En su lugar, las palabras de la oración se codifican en paralelo y estas codificaciones generan representaciones clave (key) y consulta (query) que se combinan para crear ponderaciones de atención. Estas ponderaciones escalan las propias codificaciones de palabras para crear la siguiente capa en el modelo, un proceso conocido como "auto-atención" (self-attention). Este proceso se repite y, finalmente, interactúa con el decodificador autorregresivo que también tiene mecanismos de atención que le permiten centrarse flexiblemente en la entrada codificada (como en la forma estándar de atención) y en la salida previamente generada. El Transformer, el nombre dado a esta nueva arquitectura de atención, superó a muchos modelos anteriores y rápidamente se convirtió en el estándar para la traducción automática, así como para otras tareas.

Curiosamente, la auto-atención tiene menos en común con la atención biológica que los modelos de atención recurrente utilizados originalmente para la traducción automática. Primero, reduce el papel de la recurrencia y la dinámica, mientras que el cerebro necesariamente se basa en la recurrencia en tareas de procesamiento secuencial, incluido el procesamiento del lenguaje y la selección atencional. Segundo, la auto-atención proporciona una forma de interacción horizontal entre palabras, lo que permite que las palabras en la oración codificada se procesen en el contexto de las que las rodean, pero este mecanismo no incluye un componente descendente (top-down) obvio impulsado por las necesidades del decodificador. De hecho, se ha demostrado que la auto-atención, bajo ciertas circunstancias, simplemente implementa una convolución, un cálculo feedforward estándar utilizado con frecuencia en el procesamiento de imágenes. De esta manera, la auto-atención se trata más de crear una buena codificación que de realizar una selección similar a la atención específica de la tarea basada en recursos computacionales limitados. En el contexto de una tarea temporal, su análogo más cercano en psicología puede ser el priming, porque el priming altera la codificación de estímulos posteriores basándose en los que vinieron antes. Por supuesto, el objetivo directo de los ingenieros de machine learning no es replicar el cerebro, sino crear redes que puedan ser entrenadas fácilmente para rendir bien en las tareas. Estas diferentes restricciones significan que incluso los grandes avances en machine learning no necesariamente crean modelos más parecidos al cerebro.

Si bien el estudio de la atención en el procesamiento del lenguaje humano no es tan extenso como otras áreas de investigación neurocientífica, se ha trabajado en el seguimiento de los movimientos oculares durante la lectura. Han descubierto que las personas vuelven a mirar secciones anteriores del texto para aclarar lo que están leyendo actualmente, particularmente en el contexto de encontrar el antecedente de un pronombre. Dichos cambios en la atención manifiesta indican qué información previa es más relevante para las demandas de procesamiento actuales.

Atención en Tareas Visuales

Al igual que en neurociencia y psicología, una gran parte de los estudios en machine learning se realizan en tareas visuales. Una de las herramientas originales inspiradas en la atención de la visión por computadora es el mapa de saliencia, que identifica qué regiones de una imagen son más salientes basándose en un conjunto de características visuales de bajo nivel, como bordes, color o profundidad, y cómo difieren de su entorno. De esta manera, los mapas de saliencia indican qué regiones serían capturadas por la atención "ascendente" (bottom-up) en humanos y animales. Los científicos informáticos han utilizado mapas de saliencia como parte de su pipeline de procesamiento de imágenes para identificar regiones para su posterior procesamiento.

En años más recientes, los modelos de visión por computadora han estado dominados por el deep learning. Y desde su éxito en el ImageNet Challenge de 2012, las redes neuronales convolucionales se han convertido en la arquitectura por defecto para tareas visuales en machine learning.

La arquitectura de las redes neuronales convolucionales se basa libremente en el sistema visual de los mamíferos. En cada capa, se aplica un conjunto de filtros a la actividad de la capa inferior (en la primera capa, esta es la imagen). Esto crea un tensor de actividad neuronal de H × W × C, donde C es el número de filtros aplicados y H y W representan la altura y el ancho de los mapas de características 2D que resultan de la aplicación de un filtro.

La atención en redes neuronales convolucionales se ha utilizado para mejorar el rendimiento en una variedad de tareas, incluyendo clasificación, segmentación y procesamiento de lenguaje natural inspirado en imágenes. Además, al igual que en la literatura de neurociencia, estos procesos atencionales se pueden dividir en atención espacial y atención basada en características.

Atención Espacial Artificial

Basándose en las estructuras utilizadas para la atención en tareas de PLN, la atención visual se ha aplicado a la generación de subtítulos de imágenes (image captioning). En Xu et al. (2015), el modelo de codificación es una red neuronal convolucional. El mecanismo de atención trabaja sobre la actividad en la cuarta capa convolucional. A medida que se genera cada palabra del subtítulo, se crea un patrón diferente de ponderación a través de las ubicaciones espaciales de la representación de la imagen. De esta manera, la atención para la generación de subtítulos reemplaza el conjunto de vectores de palabras codificadas en una tarea de traducción con un conjunto de ubicaciones de imagen codificadas. Al visualizar las ubicaciones con altas ponderaciones, el modelo parece atender al objeto más relevante para la palabra que se está generando actualmente para el subtítulo.

Este estilo de atención se conoce como "suave" (soft) porque produce una combinación ponderada de las características visuales sobre las ubicaciones espaciales. La atención "dura" (hard) es una forma alternativa que elige una única ubicación espacial para pasar al decodificador a expensas de todas las demás. En Xu et al. (2015), para decidir qué ubicación debe recibir esta atención dura, las ponderaciones de atención generadas para cada ubicación espacial se trataron como probabilidades. Se elige una ubicación según estas probabilidades. Añadir este elemento estocástico a la red dificulta el entrenamiento, pero se encontró que funcionaba algo mejor que la atención suave.

Un estudio de 2014 utilizó aprendizaje por refuerzo para entrenar una red de atención dura para realizar el reconocimiento de objetos en condiciones desafiantes. El núcleo de este modelo es una red neuronal recurrente que tanto rastrea la información recibida a lo largo de múltiples "vistazos" realizados por la red como genera la ubicación del siguiente vistazo. Para cada vistazo, la red recibe una entrada similar a la fóvea (las áreas centrales se representan con alta resolución y la periferia con menor resolución) de un pequeño parche de la imagen. La red tiene que integrar la información obtenida de estos vistazos para encontrar y clasificar el objeto en la imagen. Esto es similar a la atención dura descrita anteriormente, excepto que la selección de una ubicación aquí determina qué parte de la imagen se muestrea a continuación (mientras que en el caso anterior determinaba cuál de las ubicaciones de imagen ya procesadas se pasaría al decodificador). Con el uso de estos vistazos, la red no está obligada a procesar toda la imagen, ahorrando recursos computacionales limitados. También puede ayudar cuando hay varios objetos presentes en la imagen y la red debe clasificar cada uno. Trabajos recientes han demostrado que añadir un paso de pre-entrenamiento mejora el rendimiento de la atención dura aplicada a imágenes complejas.

En muchos aspectos, la correspondencia entre la atención biológica y artificial es más fuerte cuando se trata de la atención espacial visual. Por ejemplo, esta forma de atención dura, donde se muestrean secuencialmente diferentes ubicaciones de la imagen para su posterior procesamiento, replica el proceso de sacadas y, por lo tanto, es similar a la atención visual manifiesta en la literatura de neurociencia y psicología. En la medida en que la atención suave re-pondera dinámicamente diferentes regiones de la representación de la imagen de la red sin ningún cambio en la entrada a la red, es similar a la atención espacial encubierta. Además, como el modo de aplicación para la atención suave implica el escalado multiplicativo de la actividad de todas las unidades en una ubicación específica, replica los hallazgos neuronales sobre la atención espacial encubierta.

La atención espacial suave se ha utilizado para otras tareas, incluyendo respuesta visual a preguntas y reconocimiento de acciones en videos. La atención dura también se ha utilizado para la segmentación de instancias y para la clasificación de grano fino cuando se aplica utilizando diferentes niveles de resolución de imagen.

Atención a Características Artificial

En el caso de la atención espacial suave, las ponderaciones son diferentes en diferentes ubicaciones espaciales de la representación de la imagen, pero son las mismas en todos los canales de características en esa ubicación. Es decir, la actividad de las unidades en la red que representan diferentes características visuales se modificará de la misma manera si representan la misma ubicación en el espacio de la imagen. La atención a características hace posible re-ponderar dinámicamente mapas de características individuales, creando un cambio espacialmente global en el procesamiento de características.

En Stollenga et al. (2014), una red neuronal convolucional está equipada con un mecanismo de atención basado en características. Después de que una imagen pasa a través de la arquitectura feedforward estándar, la actividad de la red se pasa a una política que determina cómo deben ponderarse los diferentes mapas de características en diferentes capas. Esta re-ponderación conduce a una actividad de red diferente, lo que a su vez conduce a diferentes re-ponderaciones. Después de que la red ha funcionado durante varios pasos de tiempo, la actividad en la capa final se utiliza para clasificar el objeto en la imagen. La política que determina los valores de ponderación se aprende mediante aprendizaje por refuerzo y se puede añadir a cualquier red neuronal convolucional pre-entrenada.

El modelo en Chen et al. (2017) combina atención a características y espacial para ayudar en la generación de subtítulos de imágenes. La actividad del paso feedforward de la red convolucional se pasa al mecanismo de atención junto con la palabra generada previamente para crear ponderaciones de atención para diferentes canales en cada capa de la CNN. Estas ponderaciones se utilizan para escalar la actividad, y luego un mecanismo de atención separado realiza el mismo procedimiento para generar ponderaciones espaciales. Tanto las ponderaciones de atención espacial como de características se generan y aplican a la red en cada punto temporal.

En el modelo en De Vries et al. (2017), el contenido de una pregunta se utiliza para controlar cómo una CNN procesa una imagen para la tarea de respuesta visual a preguntas. Específicamente, la actividad de una red de embedding de lenguaje se pasa a través de un perceptrón multicapa para producir los parámetros aditivos y multiplicativos para la normalización por lotes de cada canal en la CNN. Este procedimiento, denominado normalización por lotes condicional, funciona como una forma de atención a características dependiente de la pregunta.

Una forma diferente de re-ponderación dinámica de características aparece en las redes "squeeze-and-excitation". En esta arquitectura, las ponderaciones aplicadas a diferentes canales son una función no lineal de la actividad de los otros canales en la misma capa. Al igual que en la "auto-atención" descrita anteriormente, esto difiere en espíritu de enfoques más "descendentes" (top-down) donde las ponderaciones son una función de la actividad posterior en la red y/o están sesgadas por las necesidades del generador de salida. Biológicamente hablando, esta forma de interacción es más similar a las conexiones horizontales dentro de un área visual, que se sabe que realizan cómputos como la normalización divisiva.

En el estudio de la biología de la atención basada en características, generalmente se señala a los sujetos para que atiendan o busquen características visuales específicas. De esta manera, las características a atender se conocen de antemano y se relacionan con la subtarea específica en cuestión (por ejemplo, detección de una forma específica en un ensayo dado de una tarea general de detección de formas). Esto difiere de los casos anteriores de atención artificial a características, en los que no hay una señal externa que sesgue el procesamiento de la red antes de que esté disponible el conocimiento sobre la imagen específica. En cambio, la re-ponderación de características es una función de la imagen misma y está destinada a mejorar el rendimiento de la red en una tarea constante (tenga en cuenta que este también fue el caso para las formas de atención espacial artificial descritas).

La razón para usar un paradigma de señalización en estudios de atención biológica es que permite al experimentador controlar (y por lo tanto saber) dónde se coloca la atención. Sin embargo, está claro que incluso sin señalización explícita, nuestros cerebros toman decisiones sobre dónde colocar la atención constantemente; es probable que esto esté mediado por conexiones de retroalimentación locales y de largo alcance al sistema visual. Por lo tanto, aunque la estructura de la tarea difiere entre el estudio de la atención biológica a características y su uso en sistemas artificiales, esta diferencia puede ser solo superficial. Esencialmente, los sistemas artificiales están utilizando información de imagen feedforward para generar internamente señales atencionales descendentes (top-down) en lugar de recibir la información descendente en forma de una señal.

Dicho esto, algunos sistemas artificiales permiten la atención a características señalada externamente. Por ejemplo, establecer una probabilidad a priori sobre categorías en la red en Cao et al. (2015) la hace mejor para localizar la categoría específica. La red en Wang et al. (2014), aunque no convolucional, tiene un medio para sesgar la detección de categorías de objetos específicas también. Y en Lindsay y Miller (2018), se replicaron varios aspectos de rendimiento y neuronales de la atención biológica a características durante una tarea de detección de objetos señalada utilizando una CNN. En Luo et al. (2020), se exploraron los costos y beneficios de usar una forma de atención señalada en CNNs.

Como se mencionó anteriormente, el uso del escalado multiplicativo de la actividad está en línea con ciertos hallazgos de la atención visual biológica. Además, modular mapas de características completos por el mismo valor escalar está alineado con el hallazgo mencionado anteriormente de que la atención a características actúa de manera espacialmente global en el sistema visual.

Atención Multi-Tarea

El aprendizaje multi-tarea es un tema desafiante en machine learning. Cuando se le pide a una red que realice varias tareas diferentes, por ejemplo, una CNN que debe clasificar objetos, detectar bordes e identificar regiones salientes, el entrenamiento puede ser difícil ya que los pesos necesarios para realizar cada tarea individual pueden contradecirse entre sí. Una opción es tener un conjunto de parámetros específicos de la tarea que modulen la actividad de la red compartida de manera diferente para cada tarea. Aunque no siempre se le llama así, esto puede considerarse razonablemente una forma de atención, ya que altera flexiblemente el funcionamiento de la red.

En Maninis et al. (2019), una red feedforward compartida se entrena en todas las tareas múltiples, mientras que las conexiones de salto específicas de la tarea y los bloques squeeze-and-excitation se entrenan para modular esta actividad solo en su tarea específica. Esto permite que la red se beneficie de compartir el procesamiento común a todas las tareas, al tiempo que se especializa un poco en cada una.

Se utilizó un procedimiento similar en Rebuffi et al. (2017) para crear una red que realiza clasificación en múltiples dominios de imagen diferentes. Allí, el dominio podía identificarse a partir de la imagen de entrada, lo que permitía seleccionar automáticamente el conjunto de parámetros específicos de la tarea en tiempo de ejecución.

En Zhao et al. (2018), la misma imagen puede pasarse a la red y clasificarse según diferentes dimensiones (por ejemplo, si la persona en la foto está sonriendo o no, si es joven o mayor). Se utiliza la re-ponderación específica de la tarea de los canales de características para ejecutar estas diferentes clasificaciones.

El modelo en Strezoski et al. (2019) utiliza lo que podría interpretarse como una forma de atención a características dura para enrutar la información de manera diferente en distintas tareas. Se eligen máscaras binarias sobre los canales de características de forma aleatoria para cada tarea. Estas máscaras se aplican de manera específica para cada tarea durante el entrenamiento en todas las tareas y en tiempo de ejecución. Tenga en cuenta que en esta red no se aprenden parámetros atencionales específicos de la tarea, ya que estas máscaras están predeterminadas y fijas durante el entrenamiento. En cambio, la red aprende a utilizar las diferentes vías de información resultantes para realizar diferentes tareas.

En un trabajo reciente, se eliminó por completo la noción de parámetros específicos de la tarea. En cambio, las activaciones de una CNN feedforward se combinan con una entrada de tarea y se pasan a través de una segunda CNN para generar un conjunto completo de pesos moduladores. Estos pesos luego escalan la actividad de la red original de manera específica por unidad (implementando así tanto atención espacial como a características). El resultado es un único conjunto de pesos feedforward capaz de participar flexiblemente en múltiples tareas visuales.

Cuando la misma entrada se procesa de manera diferente según muchas tareas distintas, estas redes están implementando esencialmente una forma de cambio de tarea dentro de la modalidad que se basa en la atención a características. De esta manera, es quizás más similar a la prueba de Stroop descrita anteriormente.

Atención a la Memoria Artificial

Las redes neuronales profundas tienden a no tener memoria explícita y, por lo tanto, la atención a la memoria no se estudia. Sin embargo, las Neural Turing Machines son una arquitectura neuronal híbrida que incluye almacenes de memoria externos. La red, a través del entrenamiento, aprende a interactuar eficazmente con estos almacenes para realizar tareas como ordenar y repetir secuencias almacenadas. Facilitando esta interacción hay una forma de atención. Las memorias se almacenan como un conjunto de vectores. Para recuperar información de este almacén, la red genera un peso para cada vector y calcula una suma ponderada de las memorias. Para determinar estas ponderaciones, una red neuronal recurrente (que recibe entrada externa y relevante para la tarea) genera un vector y las memorias se ponderan de acuerdo con su similitud con este vector. Así, en cada punto temporal, la red puede acceder a memorias relevantes para el contexto.

Como se describió anteriormente, cómo el cerebro elige a qué memorias atender y luego atiende a ellas no está completamente claro. El uso de una métrica de similitud en este modelo significa que las memorias se recuperan basándose en su solapamiento con un vector de actividad producido, similar a los modelos de memoria asociativa en la literatura de neurociencia. Esto ofrece un mecanismo para la segunda pregunta, es decir, cómo se podría implementar la atención a la memoria en el cerebro. El vector de actividad que produce el modelo controla a qué memorias se atiende y la relación con la biología es menos clara aquí.

Ideas para el Futuro: Interacción entre Atención Artificial y Biológica

Como se ha demostrado, cierta inspiración de la biología ya ha dado lugar a varias instancias de atención en redes neuronales artificiales. Si bien la adición de tales mecanismos de atención ha llevado a aumentos apreciables en el rendimiento de estos sistemas, es evidente que todavía hay muchas formas en que se quedan cortos y existen oportunidades adicionales para una mayor inspiración. A corto plazo, esta inspiración probablemente se manifestará en forma de mejoras incrementales a sistemas artificiales especializados como los que existen actualmente. Sin embargo, la verdadera promesa de la IA inspirada en el cerebro debería ofrecer un agente más integrado y multipropósito que pueda participar de manera flexible en muchas tareas.

Mejorando el Rendimiento de la IA

Hay dos componentes en el estudio de cómo funciona la atención en el cerebro que pueden considerarse las dos caras de la misma moneda. La primera es la cuestión de cómo la atención mejora el rendimiento de la manera en que lo hace, es decir, cómo los cambios neuronales asociados con la atención hacen que el cerebro sea mejor en la realización de tareas. La segunda es cómo y por qué se despliega la atención de la manera en que lo hace: qué factores conducen a la selección de ciertos elementos o tareas para la atención y no otros.

Los neurocientíficos han dedicado mucho tiempo a investigar la primera pregunta. En gran parte, la aplicabilidad de estos hallazgos a los sistemas neuronales artificiales, sin embargo, puede no ser sencilla. El escalado multiplicativo de la actividad aparece tanto en sistemas biológicos como artificiales y es un medio eficaz para implementar la atención. Sin embargo, muchos de los efectos observados de la atención en el cerebro tienen sentido principalmente como un medio para aumentar la señal transportada por neuronas ruidosas y de disparo (spiking). Esto incluye una mayor sincronización entre neuronas y una menor variabilidad de disparo. Sin análogos para estos cambios en las redes neuronales profundas, es difícil inspirarse en ellos. Además, los procedimientos de entrenamiento para redes neuronales pueden determinar automáticamente los cambios en la actividad necesarios para mejorar el rendimiento en una tarea bien definida, por lo que las lecciones de los cambios biológicos pueden no ser tan relevantes.

Por otro lado, la observación de que la atención puede afectar características específicas del disparo, como la altura del potencial de acción, la tendencia a disparar en ráfagas y los tiempos de disparo precisos, puede indicar la utilidad de las redes de disparo (spiking networks). Específicamente, los modelos de disparo ofrecen más grados de libertad para que la atención controle y, por lo tanto, permiten que la atención tenga posiblemente impactos mayores y/o más matizados.

Observar la anatomía de la atención puede proporcionar ideas útiles a las personas que diseñan arquitecturas para sistemas artificiales. Por ejemplo, la atención visual parece modular la actividad con mayor fuerza en áreas visuales posteriores como V4, mientras que la atención auditiva puede modular la actividad mucho antes en la corriente de procesamiento. El nivel en el que debe actuar la atención podría, por lo tanto, ser una variable arquitectónica relevante. En esta línea, trabajos recientes han demostrado que eliminar la auto-atención de las capas tempranas de un modelo Transformer mejora su rendimiento en ciertas tareas de procesamiento de lenguaje natural y también hace que el modelo sea un mejor predictor de las señales de fMRI humanas durante el procesamiento del lenguaje.

La existencia de señalización transmodal, donde la atención señalada en una modalidad sensorial puede hacer que la atención se despliegue al mismo objeto o ubicación en otra modalidad, indica cierta cantidad de interacción directa entre diferentes sistemas sensoriales. Mientras que muchos modelos multimodales en machine learning utilizan flujos de procesamiento completamente separados que solo se combinan al final, permitir algunas conexiones horizontales entre diferentes flujos de entrada puede ayudar a coordinar su procesamiento.

La atención también interactúa con el tipo de adaptación que normalmente ocurre en el procesamiento sensorial. Generalmente, los modelos de redes neuronales no tienen mecanismos de adaptación, es decir, las neuronas no tienen medios para reducir su actividad si reciben la misma entrada durante múltiples pasos de tiempo. Dado que la adaptación ayuda a que los cambios y las anomalías destaquen, puede ser útil incluirla. En un modelo con adaptación, los mecanismos de atención deberían trabajar para reactivar las neuronas adaptadas si el estímulo repetido se considera importante.