El cerebro humano, con su asombrosa capacidad para aprender, adaptarse y procesar información, ha sido durante mucho tiempo una fuente de inspiración para la creación de máquinas inteligentes. En la búsqueda de dotar a las computadoras de habilidades más parecidas a las humanas, surgieron las Redes Neuronales Artificiales (RNA), un campo fundamental dentro de la inteligencia artificial y el aprendizaje automático que, sorprendentemente, también ofrece herramientas poderosas para la neurociencia.

Las RNA no son solo algoritmos complejos; son modelos computacionales diseñados para imitar la estructura y el funcionamiento de las redes neuronales biológicas que componen nuestro cerebro. Aunque no son réplicas exactas, capturan principios clave como la interconexión de unidades de procesamiento (neuronas artificiales) y la capacidad de aprender ajustando la fuerza de esas conexiones (pesos).

¿Qué son las Redes Neuronales Artificiales?

Una Red Neuronal Artificial es, en esencia, un sistema informático inspirado en la red de neuronas del cerebro humano. Su objetivo es permitir que una computadora "aprenda" de los datos y tome decisiones o realice predicciones de una manera similar a como lo haría un ser humano. A diferencia de los algoritmos tradicionales que siguen instrucciones explícitas paso a paso, las RNA aprenden a identificar patrones y relaciones complejas directamente de los datos que se les presentan.

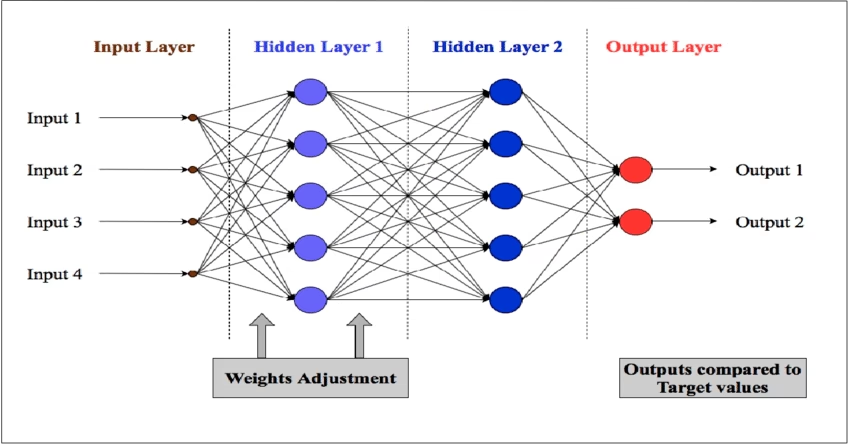

Estas redes están compuestas por unidades interconectadas, a menudo llamadas "neuronas" o "nodos", organizadas en capas. La estructura típica incluye una capa de entrada, una o más capas ocultas y una capa de salida. La información fluye a través de la red, siendo procesada en cada capa antes de llegar a la salida final.

Cómo Funcionan las Redes Neuronales Artificiales

El funcionamiento de una RNA se basa en la transmisión y transformación de información a través de sus nodos interconectados. Cada conexión entre nodos tiene un "peso" asociado, que representa la fuerza o importancia de esa conexión. Cuando un nodo recibe una señal de los nodos de la capa anterior, calcula una suma ponderada de estas entradas (cada entrada multiplicada por el peso de la conexión correspondiente).

Esta suma ponderada pasa luego a través de una "función de activación", que determina la salida del nodo. Esta función introduce no linealidad, permitiendo que la red aprenda patrones más complejos que los que permitiría un modelo lineal simple. La salida de un nodo se convierte en la entrada para los nodos de la siguiente capa, y este proceso se repite hasta llegar a la capa de salida.

La organización en capas es crucial. La capa de entrada recibe los datos brutos. Las capas ocultas realizan la mayor parte del procesamiento, transformando la representación de los datos de formas cada vez más abstractas. La capa de salida produce el resultado final, ya sea una clasificación, una predicción o alguna otra respuesta.

El Proceso de Aprendizaje: Entrenando la Red

La verdadera magia de las RNA reside en su capacidad de aprender. El aprendizaje se logra ajustando los pesos de las conexiones entre los nodos. Este proceso generalmente requiere una gran cantidad de datos, conocidos como conjunto de entrenamiento.

Durante el entrenamiento, la red procesa los datos de entrada y produce una salida. Esta salida se compara con la salida correcta esperada (si el entrenamiento es supervisado). La diferencia entre la salida de la red y la salida esperada se conoce como error. El objetivo del aprendizaje es minimizar este error.

El algoritmo más común para lograr esto es la backpropagation (retropropagación del error). Consiste en calcular cómo contribuyó cada peso al error total y luego ajustar los pesos en la dirección que reduce ese error. Este proceso iterativo, donde la red procesa datos, calcula el error y ajusta los pesos, se repite miles o millones de veces hasta que el rendimiento de la red es satisfactorio.

Cuando las RNA tienen muchas capas ocultas, se habla de aprendizaje profundo (Deep Learning). El aprendizaje profundo permite que las redes aprendan representaciones jerárquicas de los datos, extrayendo características de bajo nivel en las primeras capas y combinándolas para formar características de alto nivel en capas posteriores. Esto es particularmente efectivo para tareas complejas como el reconocimiento de imágenes o el procesamiento del lenguaje natural.

Un desafío clave en el entrenamiento es evitar el sobreajuste (overfitting), donde la red se vuelve demasiado especializada en los datos de entrenamiento y pierde la capacidad de generalizar a datos nuevos y no vistos. Esto se aborda utilizando conjuntos de validación y técnicas de regularización.

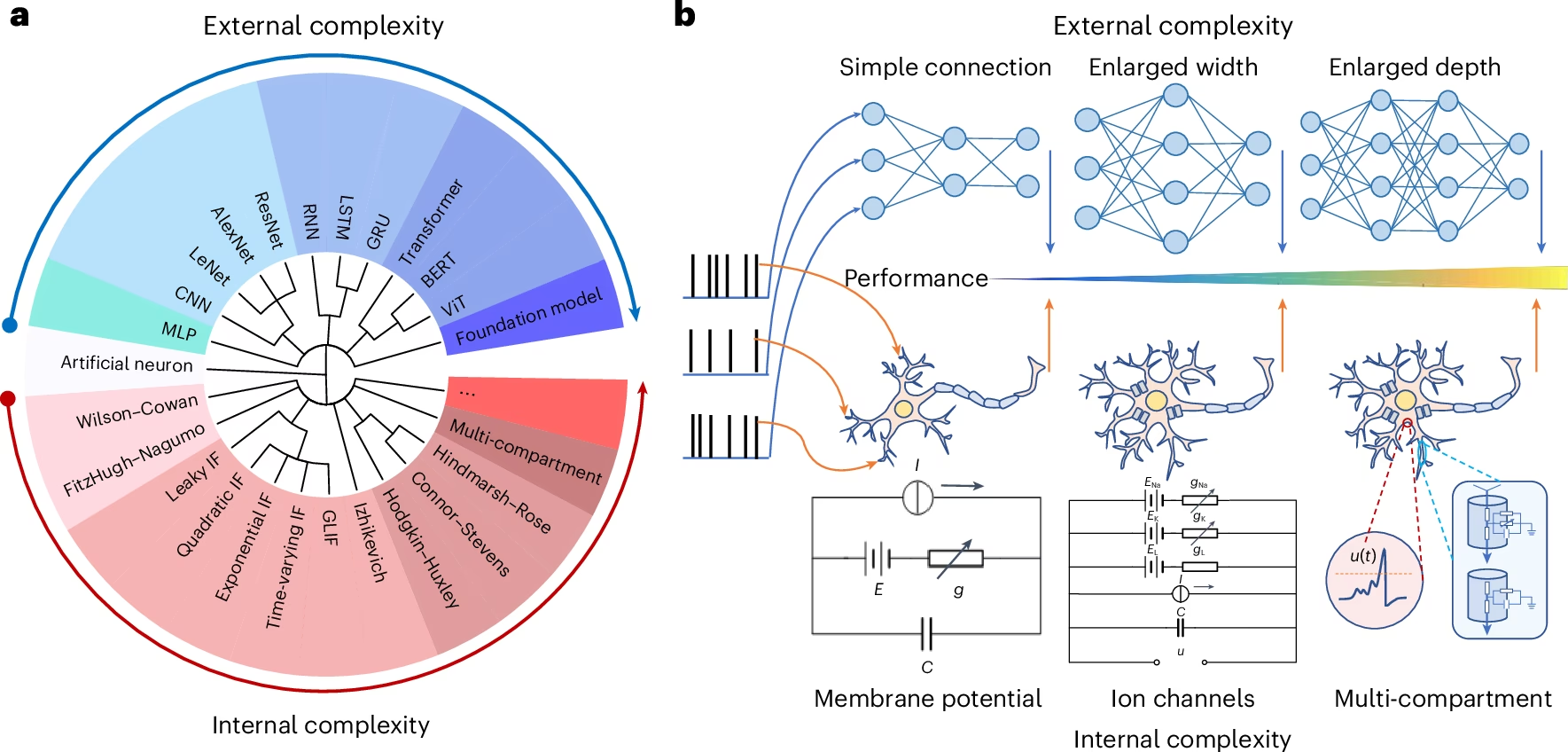

Evolución de las Redes Neuronales Artificiales

La historia de las RNA es larga y con altibajos. Los primeros conceptos surgieron en la década de 1940 y 1950, inspirados directamente por la neurociencia. El perceptrón, desarrollado por Frank Rosenblatt en 1958, fue un modelo temprano de una neurona artificial capaz de aprender.

Sin embargo, los límites de estos modelos simples llevaron a un período de menor interés. El resurgimiento clave ocurrió en la década de 1980 con el redescubrimiento y la aplicación efectiva del algoritmo de backpropagation por investigadores como Rumelhart, Hinton y Williams. Esto permitió entrenar redes con múltiples capas ocultas.

A pesar de este avance, las limitaciones computacionales y la falta de grandes conjuntos de datos frenaron su progreso durante años. El verdadero boom comenzó a principios de la década de 2010, impulsado por:

- La disponibilidad de enormes conjuntos de datos (Big Data).

- El aumento masivo de la capacidad de procesamiento, especialmente con el uso de GPUs (Unidades de Procesamiento Gráfico).

- El desarrollo de nuevas arquitecturas de red y técnicas de entrenamiento más eficientes.

Esta era del aprendizaje profundo ha llevado a resultados espectaculares en numerosas áreas, superando a menudo el rendimiento humano en tareas específicas.

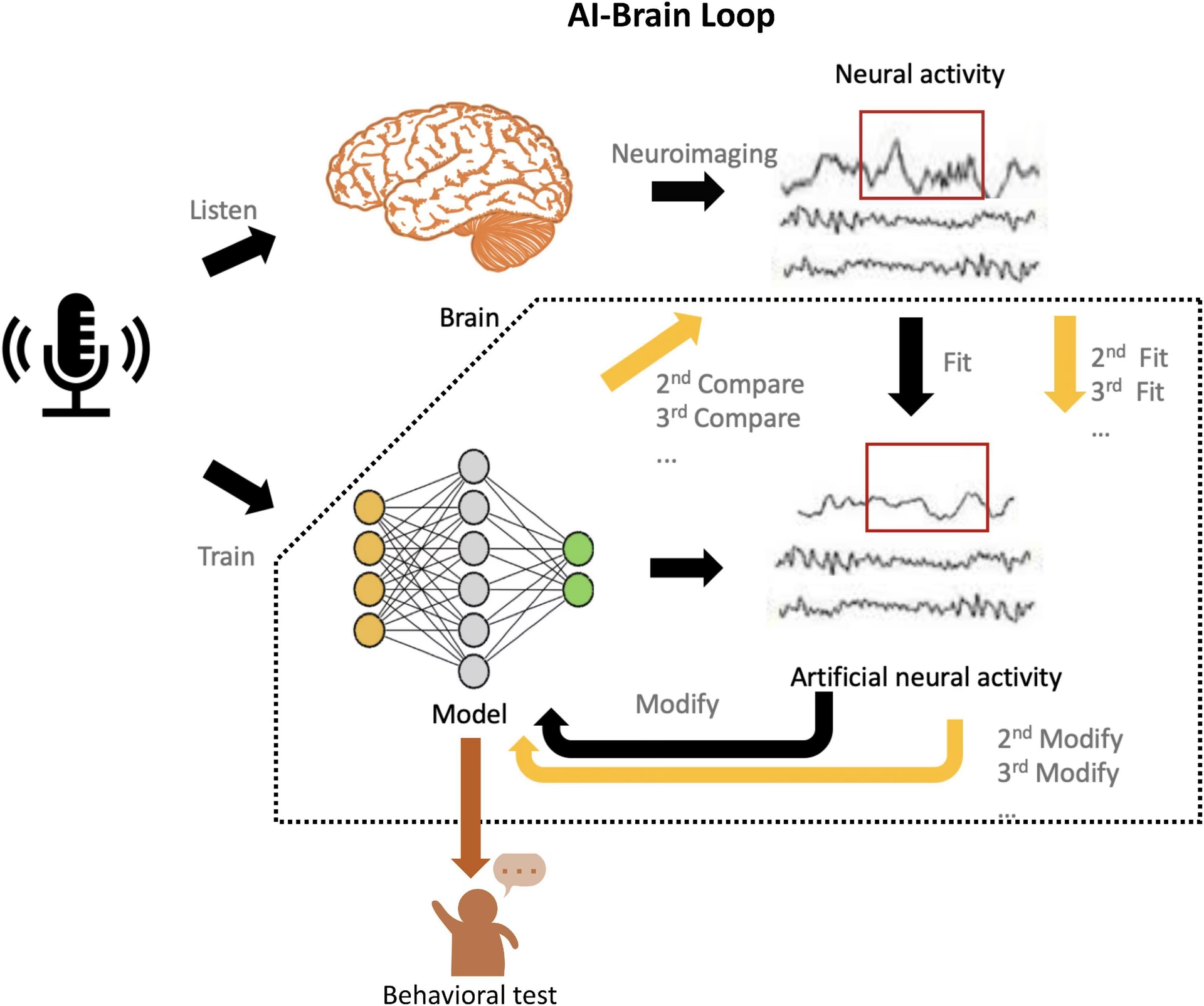

Redes Neuronales Artificiales en Neurociencia

Más allá de ser herramientas de IA, las RNA se han convertido en instrumentos valiosos para la investigación en neurociencia. Ofrecen nuevas formas de abordar preguntas complejas que los modelos tradicionales no pueden. Hay varias razones clave para su uso:

1. Análisis de Datos: Con la explosión de datos generados por neurotecnologías avanzadas (imágenes cerebrales, registros de actividad neuronal a gran escala, conectómica), las RNA son excelentes para tareas como segmentación de imágenes, seguimiento de comportamiento animal o estimación de tasas de disparo neuronal.

2. Modelado de Comportamientos y Actividad Neuronal Compleja: El cerebro realiza tareas increíblemente complejas. Modelar estas funciones con modelos matemáticos "construidos a mano" puede ser casi imposible. Las RNA, al ser entrenadas directamente en tareas conductuales (como discriminación visual), pueden generar modelos funcionales que se asemejan a la forma en que el cerebro podría resolver esos problemas. Pueden capturar la diversidad y complejidad de los patrones de actividad neuronal observados en áreas como la corteza prefrontal, que a menudo presentan selectividad mixta y difícil de interpretar con modelos simples.

3. Comprensión desde una Perspectiva de Optimización: El cerebro es un sistema biológico que ha evolucionado para realizar cómputos de manera robusta y eficiente. Las RNA, al ser entrenadas para optimizar una función objetivo (minimizar el error en una tarea) dadas ciertas restricciones (arquitectura, número de nodos), pueden ofrecer información sobre los principios de optimización que podrían haber moldeado los circuitos neuronales biológicos. ¿Por qué el cerebro está organizado de cierta manera? Quizás es el resultado de la optimización de una función computacional bajo presiones evolutivas.

Las RNA, por tanto, no solo se inspiran en el cerebro, sino que también se convierten en un campo de pruebas para entenderlo mejor, complementando los modelos biológicos y animales.

Imitando la Estructura y Procesamiento Cerebral

La analogía entre las RNA y el cerebro biológico es una de sus características más atractivas. Los nodos artificiales imitan a las neuronas, las conexiones con sus pesos imitan las sinapsis (donde las neuronas se comunican y la fuerza de la conexión puede cambiar, similar a la plasticidad sináptica). La organización en capas se asemeja a la estructura jerárquica que se encuentra en muchas áreas cerebrales, como el sistema visual, donde la información se procesa secuencialmente a través de diferentes regiones, extrayendo características de complejidad creciente en cada etapa.

Los científicos han descubierto que, al entrenar ciertas arquitecturas de RNA (como las redes neuronales convolucionales) en tareas visuales, las representaciones internas que desarrollan en sus capas se parecen sorprendentemente a los patrones de actividad registrados en diferentes áreas del córtex visual de primates, desde las características simples en las primeras capas (bordes, orientaciones) hasta los objetos complejos en las capas más profundas.

Aunque la analogía tiene límites (las neuronas biológicas son mucho más complejas que los nodos artificiales), esta similitud funcional y estructural parcial es lo que hace que las RNA sean modelos tan interesantes para los neurocientíficos computacionales.

Aplicaciones Clave de las RNA

Las RNA potencian una vasta gama de tecnologías actuales:

- Reconocimiento de Imágenes: Identificación de objetos, rostros (DeepFace de Facebook), clasificación de imágenes (Google Photos).

- Procesamiento del Lenguaje Natural: Traducción automática (Skype), análisis de sentimientos, chatbots.

- Reconocimiento de Voz: Asistentes virtuales (Siri, Alexa), transcripción automática.

- Sistemas de Recomendación: Sugerencias de productos (Amazon), videos (YouTube).

- Vehículos Autónomos: Percepción del entorno, toma de decisiones.

- Medicina: Diagnóstico por imagen, descubrimiento de fármacos.

En neurociencia, como se mencionó, se usan para análisis avanzado de datos, modelado de circuitos neuronales y simulación de funciones cognitivas.

Desafíos Actuales de las Redes Neuronales

A pesar de sus éxitos, las RNA enfrentan desafíos significativos:

1. Interpretabilidad: A menudo se les llama "cajas negras". Es difícil entender *por qué* una red tomó una decisión particular. Esto es problemático en aplicaciones críticas como la medicina o los vehículos autónomos, y también limita su utilidad como modelos explicativos en neurociencia (aunque se están desarrollando técnicas para hacerlas más interpretables).

2. Dependencia de Datos: Requieren vastos conjuntos de datos etiquetados para un entrenamiento efectivo, lo que puede ser costoso de obtener y plantea problemas de privacidad y sesgo si los datos no son representativos.

3. Recursos Computacionales: Entrenar modelos de aprendizaje profundo de vanguardia exige una potencia de cálculo considerable.

4. Robustez y Adversarios: Pueden ser vulnerables a pequeñas perturbaciones en los datos de entrada (ataques adversarios) que no afectarían a un humano.

Abordar estos desafíos es un área activa de investigación.

Preguntas Frecuentes sobre Redes Neuronales Artificiales

¿Qué diferencia hay entre una red neuronal artificial y una biológica?

Aunque inspiradas en las biológicas, las RNA son modelos matemáticos simplificados. Las neuronas biológicas son mucho más complejas en su funcionamiento, tipos y plasticidad. Las RNA imitan principios clave como la interconexión y el ajuste de fuerzas de conexión, pero no replican la biología a nivel molecular o celular detallado.

¿Por qué son útiles las ANNs para estudiar el cerebro?

Permiten modelar comportamientos y patrones de actividad neural complejos que son difíciles de capturar con modelos tradicionales. Ayudan a analizar grandes cantidades de datos neurocientíficos y ofrecen una perspectiva computacional (basada en la optimización) para entender por qué los circuitos cerebrales funcionan de cierta manera.

¿Qué es el "Deep Learning"?

Es un subcampo del aprendizaje automático que utiliza redes neuronales artificiales con múltiples (muchas) capas ocultas. La "profundidad" de la red le permite aprender representaciones de datos jerárquicas y complejas, lo que ha llevado a avances significativos en IA.

¿Cómo "aprenden" las ANNs?

Aprenden ajustando iterativamente los "pesos" de las conexiones entre sus nodos. Durante el entrenamiento, procesan datos, comparan su salida con la esperada, calculan el error y usan algoritmos como la backpropagation para modificar los pesos de manera que se reduzca el error en el futuro.

¿Qué desafíos tienen las ANNs?

Los principales desafíos incluyen la dificultad para interpretar cómo toman decisiones (la "caja negra"), su alta dependencia de grandes volúmenes de datos para el entrenamiento, los considerables recursos computacionales que requieren algunos modelos, y su vulnerabilidad a ciertos tipos de "ruido" o ataques en los datos de entrada.

Conclusión

Las Redes Neuronales Artificiales representan una de las áreas más emocionantes y de rápido crecimiento en la inteligencia artificial. Inspiradas por la maravilla del cerebro humano, no solo están transformando la tecnología, sino que también se están convirtiendo en herramientas indispensables para la neurociencia, ofreciendo nuevas vías para analizar datos, modelar la complejidad cerebral y explorar los principios computacionales que rigen la mente. A medida que la investigación continúa, la sinergia entre las RNA y la neurociencia promete desvelar aún más secretos sobre la computación, tanto en silicio como en tejido biológico.

Si quieres conocer otros artículos parecidos a Redes Neuronales Artificiales: Cerebro e IA puedes visitar la categoría Neurociencia.