Nuestro cerebro se enfrenta constantemente a un desafío fundamental: dar sentido a un mundo ruidoso, ambiguo e incompleto. La información que recibimos a través de nuestros sentidos nunca es perfecta. Las imágenes son borrosas o incompletas, los sonidos se distorsionan, las señales propioceptivas pueden ser imprecisas. A pesar de esta incertidumbre inherente, somos capaces de percibir el entorno con notable coherencia, tomar decisiones rápidas y aprender de nuevas experiencias. ¿Cómo lo logra el cerebro? Una teoría poderosa y cada vez más influyente postula que el cerebro opera como un sistema de inferencia probabilística, utilizando principios similares a los de la estadística bayesiana.

Este enfoque, conocido como el modelo bayesiano del cerebro o la inferencia bayesiana en neurociencia y cognición, sugiere que el cerebro no solo procesa datos sensoriales de forma lineal, sino que los combina activamente con sus propias expectativas o conocimientos previos sobre cómo funciona el mundo. Es una perspectiva que cambia radicalmente la forma en que entendemos procesos cognitivos tan diversos como la percepción, la toma de decisiones, el aprendizaje e incluso la interacción social.

Fundamentos de la Inferencia Bayesiana.

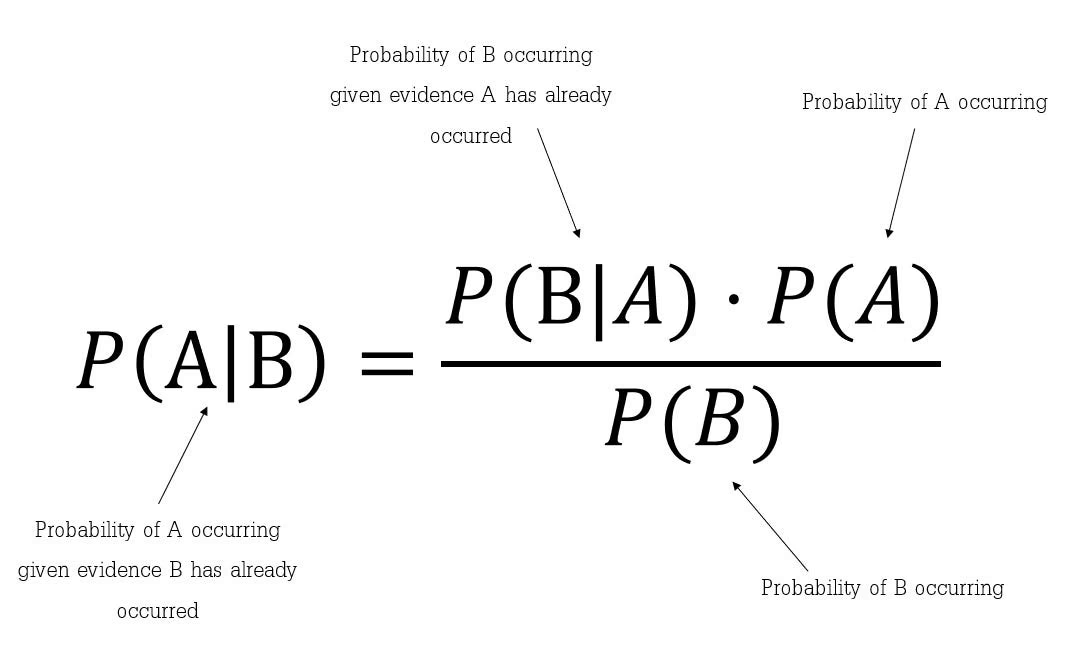

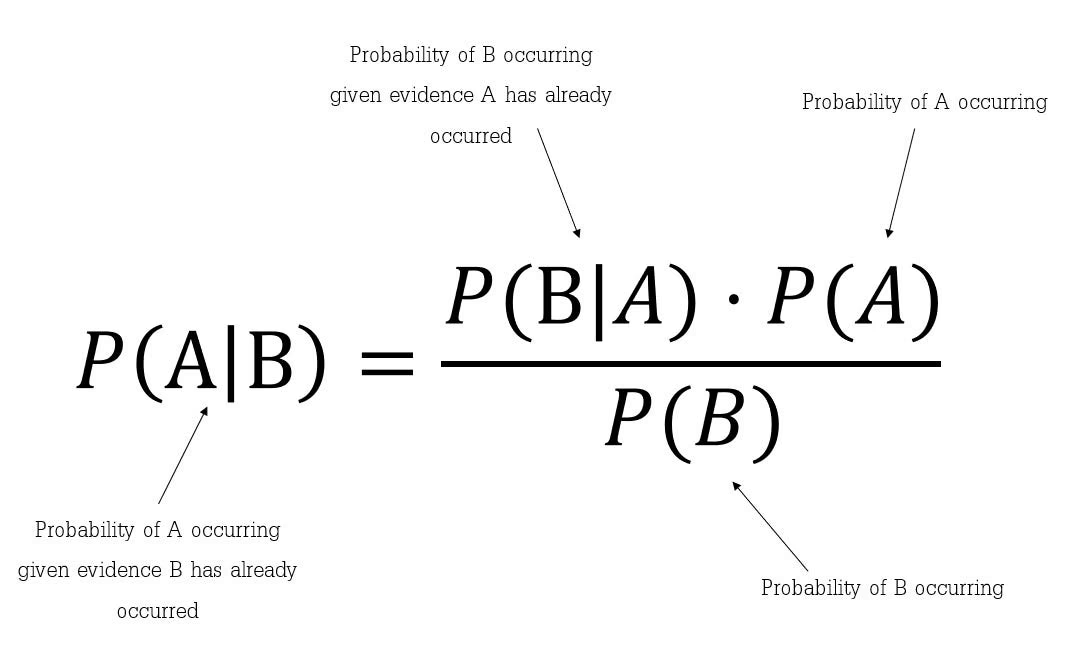

En el corazón de esta teoría se encuentra el Teorema de Bayes, una fórmula matemática simple pero profunda desarrollada por Thomas Bayes y Pierre-Simon Laplace. Este teorema describe cómo actualizar la probabilidad de una hipótesis a la luz de nueva evidencia. Formalmente, se expresa como:

P(H|E) = [P(E|H) * P(H)] / P(E)

Donde:

- P(H|E) es la probabilidad posterior: la probabilidad de que la hipótesis H sea cierta dadas las pruebas E. Esto es lo que queremos calcular: nuestra creencia actualizada.

- P(E|H) es la verosimilitud: la probabilidad de observar las pruebas E si la hipótesis H fuera cierta. ¿Qué tan bien encajan los datos con la hipótesis?

- P(H) es la probabilidad previa (o prior): la probabilidad inicial de que la hipótesis H sea cierta antes de ver las pruebas E. Representa nuestras creencias o conocimientos previos.

- P(E) es la probabilidad marginal de las pruebas E, que actúa como un factor de normalización para asegurar que las probabilidades posteriores sumen 1.

En esencia, el teorema dice que nuestra creencia actualizada en una hipótesis (la posterior) es proporcional a qué tan bien las nuevas pruebas encajan con esa hipótesis (la verosimilitud), ponderado por cuán probable considerábamos esa hipótesis inicialmente (la previa). Si las pruebas son muy probables bajo una hipótesis particular, y esa hipótesis ya era razonablemente probable de antemano, entonces nuestra creencia en esa hipótesis aumenta significativamente.

Consideremos un ejemplo simple, similar al mencionado en el texto de referencia sobre cognición: miras por la ventana en un día de verano y ves nubes grises (la evidencia E). Tienes varias hipótesis (H): que hará sol, que lloverá, o que hay un incendio forestal cercano. Tu probabilidad previa P(H) podría ser que los días soleados son más comunes que los lluviosos, y estos a su vez más comunes que los incendios forestales. La verosimilitud P(E|H) sería la probabilidad de ver nubes grises dado cada escenario: muy baja si hace sol, alta si llueve, y alta si hay un incendio. Aplicando el Teorema de Bayes, la probabilidad posterior P(H|E) de que llueva (dado que es un escenario plausible y las nubes grises encajan bien) será mayor que la de un incendio (que encaja bien con las nubes pero tiene una previa muy baja) o la de un día soleado (que tiene una previa alta pero encaja muy mal con las nubes grises).

El Cerebro como Máquina Bayesiana.

¿Cómo se traduce esto al funcionamiento cerebral? La hipótesis es que el cerebro realiza constantemente inferencias probabilísticas para estimar el estado del mundo. Cada vez que percibimos, decidimos o actuemos, estamos resolviendo un problema inverso: dados los datos sensoriales (las pruebas E), ¿cuál es la causa o el estado del mundo más probable (la hipótesis H) que generó esos datos? Esta es la esencia de un problema inductivo, donde los datos observados son insuficientes para estar completamente seguros de la causa subyacente.

El enfoque bayesiano es particularmente adecuado para estos problemas inductivos porque proporciona una solución óptima para actualizar creencias bajo incertidumbre. El cerebro, al enfrentarse a señales sensoriales ruidosas y ambiguas, no puede confiar únicamente en la evidencia actual. Debe integrar esta evidencia con lo que ya sabe o espera del mundo (sus probabilidades previas). La percepción, por ejemplo, no sería solo una lectura pasiva de los sentidos, sino un proceso activo de construcción de la realidad basado en la combinación de datos sensoriales y expectativas internas.

Esta perspectiva encaja bien con el nivel computacional del análisis propuesto por David Marr: ¿Cuál es el objetivo del sistema (el cerebro) y cuál es la lógica de la estrategia computacional utilizada? El objetivo es inferir el estado del mundo; la lógica es la inferencia probabilística, óptimamente capturada por el Teorema de Bayes.

Aplicaciones en Percepción y Acción.

La inferencia bayesiana ha demostrado ser una herramienta poderosa para explicar una amplia gama de fenómenos en la percepción y el control motor. Consideremos la percepción multisensorial. Cuando vemos y oímos a una persona hablar, ambas señales (visual y auditiva) pueden ser ruidosas. El cerebro las combina para formar una percepción unificada y más precisa. Un modelo bayesiano de inferencia causal multisensorial propone que el cerebro evalúa la probabilidad de que las señales provengan de una causa común (por ejemplo, una persona hablando) versus causas separadas (por ejemplo, una persona gesticulando y un sonido aleatorio). Basándose en las verosimilitudes de las señales bajo cada hipótesis y en las probabilidades previas de que ocurran estas situaciones, el cerebro infiere la causa más probable y combina las señales de manera óptima (generalmente ponderando más la señal más fiable) para formar una percepción integrada.

Este principio se extiende a otras áreas sensoriales y motoras. Por ejemplo, al alcanzar un objeto, el cerebro combina la información visual sobre la ubicación del objeto con la información propioceptiva sobre la posición de nuestro brazo y las expectativas previas sobre la física del movimiento. Las imprecisiones en cualquiera de estas fuentes se manejan probabilísticamente para calcular la trayectoria de movimiento más probable y eficiente. En tareas sensoriomotoras y motoras, los modelos bayesianos han explicado comportamientos complejos e incluso hallazgos contraintuitivos, demostrando cómo el cerebro optimiza el control bajo incertidumbre.

Bayes en la Cognición Superior.

Más allá de la percepción y la acción, el enfoque bayesiano se aplica a procesos cognitivos de orden superior. El aprendizaje, desde esta perspectiva, es un proceso de actualización de las probabilidades previas. A medida que adquirimos nueva evidencia (experiencias), nuestras creencias sobre cómo funciona el mundo se ajustan de acuerdo con el Teorema de Bayes. Esto explica cómo formamos categorías, aprendemos relaciones causales entre eventos, e incluso inferimos los estados mentales de otras personas (Teoría de la Mente).

En el aprendizaje de conceptos, por ejemplo, observamos ejemplos de una categoría (evidencia) y tratamos de inferir la regla o estructura subyacente que define esa categoría (hipótesis). Los modelos bayesianos sugieren que el cerebro considera múltiples reglas posibles, ponderándolas por su probabilidad previa (quizás favoreciendo reglas más simples) y por qué tan bien explican los ejemplos observados (verosimilitud).

Un concepto clave aquí es el uso de modelos generativos. Un modelo generativo especifica un proceso por el cual podrían haber surgido los datos observados. El cerebro, al parecer, podría tener modelos generativos internos del mundo. Por ejemplo, para entender el comportamiento de otra persona, podríamos usar un modelo generativo donde la persona primero elige una meta (una variable latente, no observada directamente) y luego planifica acciones para alcanzar esa meta (generando así el comportamiento observable). La inferencia bayesiana nos permite "invertir" este modelo: dadas las acciones observadas, ¿cuál es la meta más probable que la persona podría haber tenido, basándonos en nuestro conocimiento previo de las personas y sus posibles metas?

El uso de representaciones estructuradas (como gráficos causales o reglas lógicas) como hipótesis en estos modelos bayesianos ha sido fundamental para explicar fenómenos complejos en el aprendizaje y el razonamiento. El cerebro no solo aprende asociaciones simples, sino estructuras más ricas y complejas del mundo.

El Papel Crucial de las Creencias Previas (Priors).

Las probabilidades previas (priors) son un componente esencial de la inferencia bayesiana y, en el contexto del cerebro, representan lo que el sistema "ya sabe" o espera. Estos priors pueden reflejar diferentes cosas:

- Experiencia pasada: Regularidades estadísticas del entorno que el cerebro ha aprendido a lo largo de la vida.

- Sesgos innatos: Estructuras o predisposiciones cableadas evolutivamente que favorecen ciertas hipótesis sobre otras (por ejemplo, esperar que el mundo físico sea estable).

- Conocimiento general: Creencias de alto nivel sobre cómo funcionan las cosas.

Los priors guían la inferencia, especialmente cuando los datos sensoriales son débiles o ambiguos. Son la fuente de lo que en machine learning se llama "sesgos inductivos": factores distintos de los datos que influyen en la elección de una hipótesis. Al estudiar cómo las personas perciben o deciden en situaciones ambiguas, los investigadores pueden inferir algo sobre los priors que sus cerebros podrían estar utilizando.

Por ejemplo, si te muestran una imagen ambigua que podría ser un conejo o un pato, tu interpretación puede depender de tu prior. Si acabas de ver un documental sobre conejos, tu prior para "conejo" podría ser alto, inclinando tu percepción hacia esa interpretación. Estos priors no son fijos; se actualizan a través del aprendizaje bayesiano a medida que se acumula nueva evidencia.

¿Cómo Implementa el Cerebro Esto? Desafíos Algorítmicos.

Es altamente improbable que las neuronas realicen explícitamente los cálculos complejos de la fórmula de Bayes en cada instante. El desafío para la neurociencia algorítmica (el nivel de Marr que se centra en los procesos y representaciones neuronales) es entender cómo los circuitos neuronales implementan, o al menos aproximan, la inferencia bayesiana. La "conservación" observada en estudios tempranos, donde las personas actualizaban sus creencias más lentamente de lo que predice la fórmula ideal, podría ser una pista de estas aproximaciones algorítmicas.

Las investigaciones actuales exploran varios mecanismos neuronales candidatos. Algunas teorías sugieren que las poblaciones neuronales podrían representar distribuciones de probabilidad (no solo valores puntuales). Otras proponen que la inferencia bayesiana se aproxima mediante algoritmos de muestreo (como Cadenas de Markov Monte Carlo) o mediante métodos variacionales, que son computacionalmente más manejables. La relación con las redes neuronales artificiales también es un área activa de investigación; se ha demostrado que ciertos tipos de redes neuronales pueden realizar o aproximar la inferencia bayesiana.

El concepto de "racionalidad de recursos" (resource rationality) sugiere que el cerebro puede utilizar algoritmos que se desvían de la solución óptima bayesiana ideal si son más eficientes dados los recursos computacionales limitados del cerebro. Estas desviaciones sistemáticas del comportamiento perfectamente racional no invalidan necesariamente el enfoque bayesiano a nivel computacional, sino que pueden ofrecer valiosas pistas sobre las limitaciones y estrategias del cerebro a nivel algorítmico.

Evidencia Empírica y Predicciones.

Una de las fortalezas del modelo bayesiano es su capacidad para explicar una gran diversidad de fenómenos conductuales y hacer predicciones comprobables. Se ha utilizado para explicar desde cómo percibimos el movimiento aparente y las ilusiones sensoriales (como resultado de combinar datos ambiguos con priors fuertes) hasta cómo aprendemos idiomas o navegamos por entornos complejos. Los modelos bayesianos han explicado por qué las personas a veces muestran comportamientos que parecen "irracionales" desde una perspectiva lógica clásica, reinterpretándolos como inferencias racionales bajo supuestos o priors específicos. Además, los estudios han confirmado predicciones novedosas derivadas de estos modelos, por ejemplo, sobre cómo se combinan las señales sensoriales en diferentes condiciones de ruido.

Aunque mapear los algoritmos bayesianos a la actividad neuronal concreta sigue siendo un desafío, estudios recientes utilizando técnicas como fMRI y EEG están comenzando a identificar correlatos neuronales de las cantidades bayesianas, como la representación de la incertidumbre o la integración de priors y verosimilitudes en diferentes áreas cerebrales.

Comparando Enfoques: Bayesiano vs. Reglas Rígidas.

Para ilustrar la diferencia, consideremos cómo un sistema (sea un robot o el cerebro) podría identificar un objeto parcialmente oculto o visto en condiciones de poca luz. Un sistema basado en reglas rígidas podría intentar identificar el objeto buscando un conjunto fijo de características definitorias. Si esas características no son claramente visibles debido a la oclusión o el ruido, el sistema fallaría en la identificación o haría una suposición aleatoria. Un enfoque bayesiano, en cambio, combinaría la información parcial y ruidosa disponible (la verosimilitud) con su conocimiento previo sobre qué objetos son probables en ese contexto (el prior). Si el objeto parcial se ve en una cocina, el prior para "tostadora" o "taza" sería alto, mientras que el prior para "gorila" sería muy bajo. Incluso si la evidencia visual es débil, la combinación con el prior fuerte permitiría al sistema inferir con alta probabilidad que se trata de una tostadora o una taza. Este enfoque es inherentemente más robusto a la incertidumbre y la ambigüedad, lo que lo hace plausible como principio organizador del procesamiento cerebral.

Preguntas Frecuentes sobre el Cerebro Bayesiano.

Aquí respondemos algunas preguntas comunes sobre esta perspectiva:

¿Realmente el cerebro realiza cálculos matemáticos complejos como la regla de Bayes?

No se cree que las neuronas hagan explícitamente multiplicaciones o divisiones de la fórmula. La idea es que el sistema neuronal en su conjunto se comporta *como si* estuviera realizando inferencias bayesianas, es decir, llega a resultados que son consistentes con las predicciones del modelo bayesiano ideal. La implementación neuronal probablemente implica mecanismos de aproximación que logran un resultado similar.

¿De dónde provienen las probabilidades previas (priors) en el cerebro?

Los priors son una combinación de aprendizaje y posiblemente factores innatos. El cerebro aprende las regularidades estadísticas del entorno a lo largo de la vida, ajustando sus expectativas. Algunos priors básicos, como los relacionados con la estabilidad del mundo físico, podrían estar incorporados evolutivamente.

¿Puede el modelo bayesiano explicar los errores cognitivos o sesgos humanos?

Sí, a menudo puede. Las desviaciones del comportamiento bayesiano óptimo pueden explicarse por varias razones dentro del marco: el uso de priors subóptimos (que no reflejan con precisión la realidad), la aplicación de algoritmos de inferencia aproximada que introducen sesgos computacionales, o limitaciones en la representación de las distribuciones de probabilidad.

¿Hay evidencia neural directa de la inferencia bayesiana en el cerebro?

Aunque no se ha encontrado un "neurona de Bayes", la investigación actual está identificando correlatos neuronales. Por ejemplo, la actividad de ciertas poblaciones neuronales parece codificar la verosimilitud de la evidencia, mientras que otras áreas podrían representar los priors o la probabilidad posterior. También se están investigando los mecanismos neuronales que podrían subyacer a la integración de esta información.

Conclusión.

La visión del cerebro como una máquina bayesiana proporciona un marco unificador poderoso para comprender cómo manejamos la incertidumbre en la percepción, la cognición y la acción. Aunque la implementación neuronal exacta sigue siendo un área de investigación activa, el enfoque bayesiano ofrece una explicación racional de por qué el cerebro procesa la información de la manera en que lo hace, combinando de manera óptima los datos sensoriales ruidosos con sus expectativas internas. Esta perspectiva subraya la importancia de la investigación multidisciplinaria, fusionando la estadística, la informática, la psicología y la neurociencia para desentrañar los principios fundamentales de la computación cerebral.

Si quieres conocer otros artículos parecidos a El Cerebro Bayesiano: Cómo Infiere puedes visitar la categoría Neurociencia.