Apache Spark se ha consolidado como una tecnología fundamental en el mundo del Big Data y la analítica. Aprender Spark abre un universo de oportunidades en procesamiento de datos, aprendizaje automático y más. Ya seas un principiante o busques profundizar tus habilidades, esta guía te acompañará a través de los pasos esenciales para dominar Apache Spark y responder a la gran pregunta: ¿es realmente difícil de aprender?

- ¿Por Qué Deberías Aprender Apache Spark?

- ¿Qué Tan Difícil Es Aprender Spark Realmente?

- Tu Ruta Estructurada para el Aprendizaje de Apache Spark

- Recursos Clave para Acelerar Tu Viaje con Spark

- Spark vs. Hadoop MapReduce: Una Ventaja Clave

- El Impacto de Spark en la Industria y Tu Carrera

- Preguntas Frecuentes sobre Aprender Spark

¿Por Qué Deberías Aprender Apache Spark?

Antes de sumergirnos en el 'cómo', es crucial entender el 'por qué'. Aprender Spark es una inversión valiosa por múltiples razones:

- Alto Rendimiento: Spark procesa datos en memoria, lo que lo hace significativamente más rápido que sistemas tradicionales basados en disco como Hadoop MapReduce. Esta capacidad de procesamiento en memoria es una de sus mayores ventajas.

- Facilidad de Uso: Ofrece APIs de alto nivel para programar en lenguajes populares como Java, Scala, Python y R. Esto lo hace accesible para una amplia gama de desarrolladores y científicos de datos, permitiéndoles interactuar con grandes conjuntos de datos de manera más intuitiva.

- Versatilidad: Spark es un motor unificado capaz de manejar diversas tareas de procesamiento de datos dentro de un único framework. Esto incluye procesamiento por lotes (batch processing), procesamiento de flujos en tiempo real (real-time stream processing), aprendizaje automático (machine learning) y procesamiento de grafos (graph processing).

- Comunidad y Adopción Industrial: Apache Spark cuenta con una comunidad vibrante y activa y es ampliamente adoptado por líderes de la industria. Esto garantiza su relevancia, soporte continuo y un flujo constante de nuevas características y mejoras.

Estas características lo convierten en una herramienta indispensable para cualquiera que trabaje o aspire a trabajar con grandes volúmenes de datos.

¿Qué Tan Difícil Es Aprender Spark Realmente?

La percepción sobre la dificultad de aprender Spark varía considerablemente. Algunas fuentes sugieren que dominarlo puede llevar meses o incluso un año, mientras que otras afirman que es “ultra fácil” si se sigue un enfoque estructurado. La verdad, como suele ocurrir, se encuentra en un punto intermedio y depende en gran medida de tu experiencia previa y del nivel de dominio que desees alcanzar.

Para quienes ya tienen experiencia en programación y conceptos básicos de procesamiento de datos, aprender los fundamentos de Spark puede ser moderadamente desafiante pero manejable. La curva de aprendizaje inicial puede sentirse empinada al familiarizarse con nuevos conceptos como RDDs, DataFrames o la arquitectura distribuida.

Si eres completamente nuevo en la programación o en el mundo del Big Data, el desafío será mayor, ya que deberás aprender no solo Spark, sino también un lenguaje de programación compatible (como Python) y los principios del procesamiento distribuido. Sin embargo, la buena noticia es que Spark está diseñado para ser más amigable que sus predecesores.

La clave, según los expertos, no es esperar la perfección. Puedes empezar a trabajar con Spark y considerarte un "Spark developer" incluso después de invertir una cantidad relativamente pequeña de tiempo (se mencionan 40 horas: 20 de lectura/tutoriales y 20 de práctica). Tus primeras líneas de código pueden no ser las mejores, pero la práctica constante (miles de líneas de código) es lo que realmente consolida el conocimiento y mejora la habilidad. No necesitas aprender "todo" de golpe; puedes empezar con un enfoque de "justo lo necesario" e ir construyendo sobre esa base.

Tu Ruta Estructurada para el Aprendizaje de Apache Spark

Para abordar el aprendizaje de Spark de manera efectiva y mitigar la percepción de dificultad, es fundamental seguir un camino bien definido. Aquí presentamos un enfoque paso a paso:

Paso 1: Domina un Lenguaje de Programación

Spark soporta varios lenguajes, pero los más comunes son Java, Scala, Python y R. Si ya conoces alguno, tienes una ventaja. Si no, Python es altamente recomendado para principiantes debido a su sintaxis clara y su amplia adopción en el ámbito de los datos. Dedica tiempo a aprender los fundamentos del lenguaje elegido y practica escribiendo programas básicos.

Paso 2: Comprende los Fundamentos de Big Data

Apache Spark opera en entornos de Big Data, por lo que entender conceptos clave como computación distribuida, sistemas de almacenamiento de datos distribuidos (como HDFS) y los principios detrás de los frameworks de procesamiento de datos es esencial. Familiarizarte con Hadoop, aunque no sea estrictamente necesario para usar Spark, puede proporcionar un contexto valioso.

Paso 3: Configura Tu Entorno de Desarrollo

Necesitas un lugar para ejecutar código Spark. Las opciones incluyen:

- Ejecución local en tu máquina.

- Configurar un clúster Spark (más avanzado).

- Usar herramientas simplificadas como el modo standalone de Apache Spark, la edición comunitaria de Databricks (altamente recomendada para empezar) o contenedores Docker.

Comenzar con una configuración local o Databricks CE es ideal para los primeros pasos.

Paso 4: Sumérgete en los Conceptos Clave de Spark Core

Aquí es donde aprendes el corazón de Spark. Los conceptos fundamentales incluyen:

- Resilient Distributed Datasets (RDDs): Aunque las APIs más nuevas como DataFrames son más comunes, entender los RDDs es crucial para comprender cómo Spark maneja la tolerancia a fallos y la distribución de datos.

- Arquitectura de Spark: Aprende sobre el programa driver, el gestor de clúster (cluster manager) y los nodos worker. Comprende cómo Spark distribuye tareas y gestiona recursos en un clúster.

- APIs de Spark: Explora las APIs de alto nivel como DataFrame y Dataset para procesamiento de datos estructurados. Estas APIs son más optimizadas y fáciles de usar para muchas tareas. También conoce la API de bajo nivel RDD para casos que requieran más control.

- Ejecución de Spark: Entiende la evaluación perezosa (lazy evaluation), las transformaciones (transformations) y las acciones (actions). Conceptos como el shuffling (intercambio de datos entre nodos), el particionamiento de datos y el linaje (graph de operaciones) son vitales para optimizar el rendimiento.

Paso 5: Explora el Ecosistema de Spark

Spark es más que solo Spark Core. Su ecosistema ofrece bibliotecas para diversas necesidades:

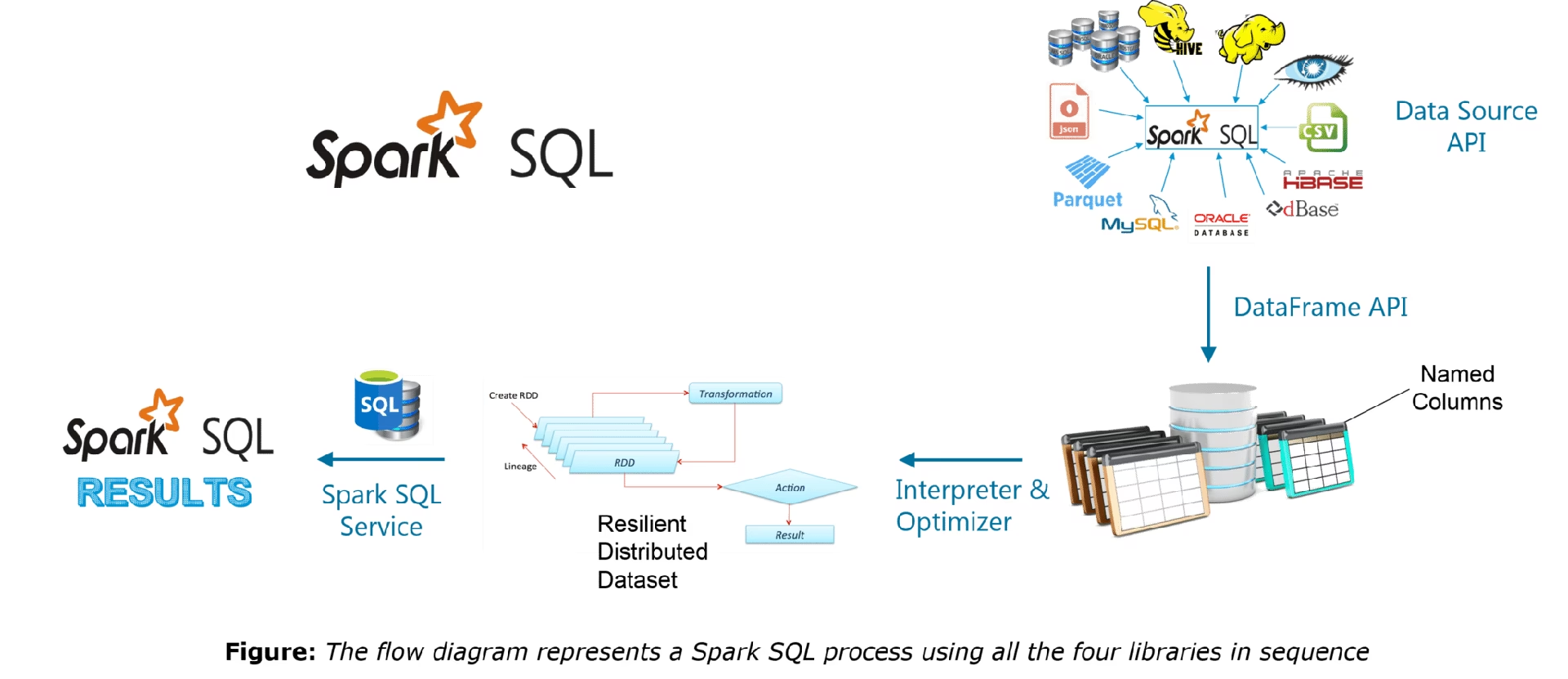

- Spark SQL: Para trabajar con datos estructurados usando consultas SQL y conectarse a fuentes de datos externas.

- Spark Streaming (o Structured Streaming): Para procesar datos en tiempo real o micro-lotes.

- MLlib: La biblioteca de aprendizaje automático de Spark, que ofrece algoritmos y utilidades para tareas como clasificación, regresión, clustering y sistemas de recomendación.

- GraphX: Para procesamiento y análisis de grafos.

Familiarizarte con estas bibliotecas ampliará tu capacidad para resolver una variedad de problemas con Spark.

Paso 6: Trabaja en Proyectos del Mundo Real

La teoría es importante, pero la práctica es donde realmente se solidifica el aprendizaje. Comienza con proyectos pequeños y ve aumentando la complejidad. Procesar y analizar grandes conjuntos de datos, construir pipelines de datos o implementar algoritmos de ML te ayudará a aplicar lo aprendido y a construir un portafolio.

Recursos Clave para Acelerar Tu Viaje con Spark

Existen numerosos recursos para ayudarte en tu aprendizaje. Aquí destacamos algunos de los más útiles mencionados:

- Databricks Community Edition: Una plataforma gratuita que te permite experimentar con Spark en un entorno gestionado por los creadores de Spark.

- Documentación Oficial de Databricks y Apache Spark: Son fuentes autorizadas y completas de información.

- Tutoriales de Python: Si eliges Python, recursos como W3 Schools pueden ayudarte con los fundamentos del lenguaje.

- YouTube: Canales con tutoriales y explicaciones visuales de conceptos de Spark.

- GitHub: Explora repositorios con código de ejemplo y proyectos de Spark.

- Comunidades Online: Plataformas como Quora, Reddit (subreddits de Apache Spark), y grupos de LinkedIn son excelentes para hacer preguntas, encontrar discusiones y aprender de la experiencia de otros.

- Plataformas de Proyectos Prácticos: Sitios que ofrecen proyectos guiados de principio a fin pueden ser invaluables para ganar experiencia práctica.

Spark vs. Hadoop MapReduce: Una Ventaja Clave

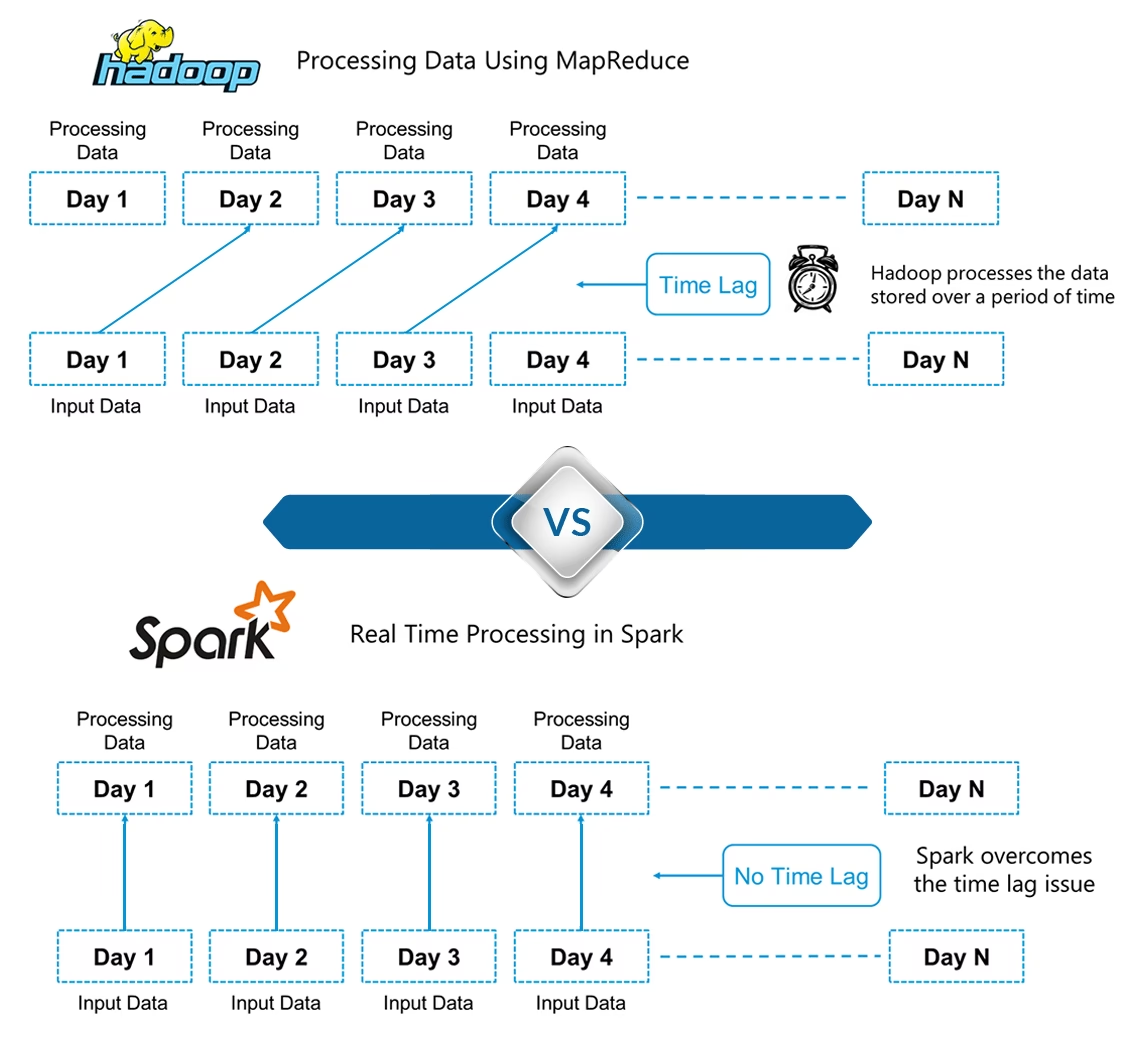

Para entender el atractivo de Spark, es útil compararlo brevemente con su predecesor, Hadoop MapReduce. La diferencia fundamental radica en cómo manejan los datos durante el procesamiento:

| Característica | Apache Spark | Hadoop MapReduce |

|---|---|---|

| Procesamiento | En memoria | Basado en disco |

| Velocidad | Significativamente más rápido (hasta 100x en memoria) | Más lento debido a operaciones de I/O de disco frecuentes |

| Iteraciones | Eficiente para tareas iterativas (ML, grafos) | Ineficiente para tareas iterativas (requiere escribir a disco entre pasos) |

| APIs | APIs de alto nivel (DataFrame, Dataset) y RDD | API de bajo nivel (Map/Reduce) |

Esta diferencia fundamental en el procesamiento (en memoria vs. disco) es la razón principal del alto rendimiento de Spark y por qué se ha convertido en la opción preferida para muchas cargas de trabajo modernas de Big Data y analítica.

El Impacto de Spark en la Industria y Tu Carrera

La adopción empresarial de Apache Spark ha crecido exponencialmente. Ya no es solo un componente del ecosistema Hadoop, sino una tecnología de Big Data independiente y dominante. Empresas de diversos sectores lo utilizan para tareas críticas, desde la analítica de datos masivos hasta el procesamiento de transmisiones en tiempo real. Un ejemplo notable es Netflix, que lo emplea para procesar terabytes de datos diarios y mejorar la experiencia del usuario.

Esta creciente adopción se traduce directamente en una alta demanda de profesionales con habilidades en Spark. La escasez de expertos cualificados ha llevado a que los desarrolladores y científicos de datos con experiencia en Spark sean muy solicitados y, consecuentemente, perciban salarios atractivos. Si buscas una carrera prometedora en el ámbito del Big Data, aprender Spark es una de las mejores decisiones que puedes tomar actualmente.

Preguntas Frecuentes sobre Aprender Spark

Abordemos algunas preguntas comunes que surgen al considerar aprender Apache Spark:

¿Cuánto tiempo lleva aprender Spark?

El tiempo varía según tu experiencia previa y el nivel de maestría. Para principiantes con nociones básicas de programación, entender los fundamentos puede tomar unas pocas semanas. Sin embargo, para ser realmente competente y dominar conceptos avanzados y optimizaciones, se necesitan varios meses o incluso un año de aprendizaje y práctica constante.

¿Es muy difícil aprender Spark?

La dificultad depende de tu base y tus objetivos. Para quienes tienen experiencia en programación y datos, los conceptos básicos son manejables. Las características avanzadas y la optimización pueden ser desafiantes y requieren dedicación. Pero, como se mencionó, un enfoque estructurado y la práctica hacen que sea mucho más accesible de lo que parece inicialmente.

¿Puede cualquiera aprender Spark?

Sí, cualquiera con la motivación y la disposición para aprender los conceptos necesarios (programación, Big Data) puede aprender Spark. No importa tu rol actual (probador de software, DBA, desarrollador ETL, etc.), las APIs de alto nivel facilitan la entrada.

¿Cuándo puedo considerarme un desarrollador Spark?

Podrías empezar a considerarte un desarrollador Spark una vez que hayas pasado tiempo aprendiendo los fundamentos y hayas comenzado a escribir código para construir pipelines de datos o realizar análisis. Inicialmente serás un principiante, pero la experiencia se construye con la práctica. No esperes a ser un experto para empezar a aplicar tus conocimientos y llamarte así.

¿Necesito aprender Scala o Python a fondo antes de empezar con Spark?

Necesitas tener un conocimiento funcional de uno de los lenguajes soportados, siendo Python una excelente opción para empezar si no tienes experiencia previa. No necesitas ser un experto en el lenguaje desde el principio; puedes aprender lo básico y profundizar a medida que trabajas con Spark. La práctica con Spark te ayudará a mejorar tus habilidades en el lenguaje.

¿Debo aprender Hadoop también?

No es estrictamente necesario para usar Spark, ya que Spark puede ejecutarse de forma independiente o en otros gestores de clúster como Mesos o Kubernetes. Sin embargo, entender los conceptos de Hadoop (especialmente HDFS y YARN) proporciona un contexto valioso, ya que Spark a menudo se integra o ejecuta sobre infraestructura Hadoop existente. Empezar con Spark y luego explorar Hadoop es un camino viable.

En definitiva, aprender Apache Spark es un objetivo alcanzable que requiere dedicación, un enfoque estructurado y, sobre todo, mucha práctica. No te dejes intimidar por la magnitud del Big Data. Con los recursos adecuados y una ruta clara, puedes dominar esta poderosa herramienta y abrirte camino en uno de los campos tecnológicos más demandados.

Si quieres conocer otros artículos parecidos a Aprender Apache Spark: ¿Es Difícil? puedes visitar la categoría Neurociencia.