Durante décadas, la psicología científica ha estado marcada por una división fundamental, como señaló Cronbach en 1957: por un lado, el estudio de los mecanismos cognitivos generales (cómo funciona la mente para todos) y, por otro, el estudio de las diferencias individuales en capacidades como la inteligencia (por qué algunas personas son mejores que otras). A pesar de los avances, esta brecha persiste, con investigadores de ambos campos raramente interactuando. Sin embargo, existe una necesidad creciente de integrar estas dos perspectivas para obtener una comprensión completa de la mente humana. Un enfoque prometedor para lograr esta unificación es el modelo de red de la inteligencia.

Este modelo no solo busca explicar las diferencias individuales, sino también los mecanismos subyacentes que dan lugar a esas diferencias y cómo estas capacidades se desarrollan a lo largo del tiempo. Al ver la inteligencia no como una entidad monolítica o un simple factor subyacente, sino como un sistema complejo de habilidades interconectadas que interactúan entre sí, podemos empezar a construir una teoría unificada que aborde tanto el 'cómo funciona' como el 'por qué varían'.

- La Persistencia de la División: El Legado de Cronbach

- El Dominio del Factor 'g': Ventajas y Críticas

- Modelos Alternativos: Muestreo y Mutualismo

- El Modelo de Red Unificado: Integrando Explicaciones

- Psicometría de Redes: Un Nuevo Enfoque para la Medición

- Redes y Desarrollo Cognitivo: ¿Continuo o Discreto?

- Preguntas Frecuentes sobre el Modelo de Red de la Inteligencia

La Persistencia de la División: El Legado de Cronbach

La división propuesta por Cronbach sigue siendo sorprendentemente relevante hoy en día. Es común que un psicólogo se especialice en mecanismos cognitivos sin una formación profunda en psicometría o desarrollo, y viceversa. Los congresos y revistas especializadas en cognición (como Cognition o Journal of Mathematical Psychology) a menudo operan de forma independiente de aquellos centrados en la inteligencia y las diferencias individuales (como Intelligence o Structural Equation Modeling). La razón principal de esta separación radica en que las preguntas que abordan son distintas. Un experto puede explicar perfectamente cómo resolvemos problemas aritméticos sin tener idea de por qué algunos lo hacen mejor que otros. De manera similar, conocer una fuente importante de diferencias individuales en una habilidad (como la práctica en el ajedrez) dice poco sobre el mecanismo subyacente de cómo se juega al ajedrez.

Esta división ha llevado a errores significativos. Un ejemplo clásico es la interpretación del factor g. El hecho de que las puntuaciones en diferentes tests de inteligencia correlacionen positivamente y puedan modelarse con un factor general no implica que exista un único 'módulo de inteligencia' en el cerebro. Otro error común es usar medidas diseñadas para detectar diferencias experimentales (entre condiciones) como instrumentos para evaluar habilidades individuales, lo cual requiere mucha mayor fiabilidad.

Cronbach era optimista sobre la unificación, pero para lograrla, se necesitan modelos que describan el proceso dentro de los individuos (el mecanismo) y que, además, incluyan supuestos sobre las fuentes de variación individual. Necesitamos modelos cognitivos que expliquen cómo se resuelven problemas, por ejemplo, y que al mismo tiempo postulen cómo una capacidad como la memoria de trabajo influye en el rendimiento general y varía entre personas.

El Dominio del Factor 'g': Ventajas y Críticas

Uno de los modelos más influyentes en el estudio de las diferencias individuales es el factor g (inteligencia general) propuesto por Charles Spearman. La idea básica es que las correlaciones positivas entre las puntuaciones de diferentes tests cognitivos se deben a un factor subyacente común. Este enfoque, basado en el análisis factorial, se ha extendido a muchas otras áreas de la psicología diferencial (personalidad, psicopatología, etc.).

Las ventajas de este enfoque son notables. Primero, el modelado de variables latentes está muy desarrollado estadísticamente. Existen modelos sofisticados (unifactoriales, multifactoriales, jerárquicos) que pueden estimarse con software accesible, permitiendo evaluar el ajuste del modelo, compararlo con otros, y analizar propiedades de las medidas como la invarianza. Segundo, es una técnica de reducción de datos muy útil. Permite resumir múltiples medidas observadas en un conjunto limitado de variables latentes cuando estas medidas correlacionan positivamente (el llamado 'positive manifold', el fenómeno empírico más importante en la investigación de habilidades cognitivas). Tercero, es un enfoque práctico. Dado que es difícil crear instrumentos psicológicos de alta validez y fiabilidad perfecta, el enfoque de variables latentes permite que la cantidad compense la calidad: múltiples medidas subóptimas, si se relacionan con el constructo real, pueden dar una estimación precisa del valor de la variable latente.

Sin embargo, la principal desventaja del enfoque de variables latentes es la dificultad para interpretar la variable latente. ¿Qué es exactamente 'g'? ¿Es poder mental, tamaño cerebral, memoria de trabajo, velocidad de procesamiento? Esta pregunta ha sido en gran medida evitada o respondida de forma insatisfactoria. Algunos adoptan una postura pragmática (g predice el éxito educativo y laboral), otros una postura estadística (no es necesario tomar posición sobre su estatus ontológico). Sin embargo, no explicar cómo 'g' causa las puntuaciones en los tests, cómo opera en el cerebro o cómo se desarrolla es una limitación seria.

Además, es crucial distinguir entre modelos latentes reflectivos y formativos. En un modelo reflectivo, la variable latente causa las puntuaciones observadas (ej. la temperatura causa las lecturas de varios termómetros). En un modelo formativo, la variable latente es un índice que resume variables observadas (ej. un índice económico resume el éxito de varias empresas). El modelo de factor g se interpreta generalmente como reflectivo, pero sin una hipótesis clara sobre la naturaleza causal de 'g', esta interpretación es problemática. Los modelos formativos, aunque posibles, simplemente resumen correlaciones sin explicarlas causalmente. Esto nos lleva a buscar explicaciones alternativas para el 'positive manifold'.

Modelos Alternativos: Muestreo y Mutualismo

Existen explicaciones alternativas para las correlaciones positivas entre tests cognitivos que no se basan en un único factor causal subyacente:

- El Modelo de Muestreo: Propuesto originalmente por Thorndike y Thomson, y reintroducido por Bartholomew, Deary, y Lawn, y más recientemente por Kovacs y Conway. Este modelo sugiere que las correlaciones positivas surgen porque cualquier par de tests cognitivos inevitablemente comparten algunos procesos básicos subyacentes. La superposición en estos procesos compartidos resulta en correlaciones positivas. En esencia, el 'positive manifold' sería un artefacto de medición: si pudiéramos crear tests que midieran un único atributo sin solapamiento, las correlaciones desaparecerían. Aunque criticado, este modelo es difícil de descartar, ya que crear tests puramente unidimensionales parece imposible.

- El Modelo de Mutualismo: Introducido por Van der Maas y colegas, este modelo se basa en la idea de que las capacidades cognitivas forman una red donde el crecimiento o mejora en una habilidad tiene un efecto recíproco y positivo en otras habilidades. Durante el desarrollo cognitivo, las diferentes capacidades (como memoria de trabajo, razonamiento, vocabulario) crecen no solo de forma autónoma, sino también influenciándose mutuamente. Por ejemplo, una mejor habilidad lingüística puede facilitar el razonamiento, y un mejor razonamiento puede enriquecer el vocabulario. Este modelo, formalizado matemáticamente (a menudo usando ecuaciones de dinámicas de población), puede explicar el 'positive manifold' incluso con interacciones débiles. Lo más notable es que un modelo de mutualismo con interacciones uniformes puede generar la misma matriz de covarianza que un modelo de factor único con cargas factoriales iguales.

El modelo de mutualismo, aunque inicialmente simplista, tiene la gran ventaja de ser un modelo de procesos que opera a nivel del individuo y que puede generar patrones de datos que se observan a nivel de diferencias individuales (las correlaciones positivas). Además, puede explicar otros fenómenos como la estructura jerárquica de la inteligencia, la baja predictibilidad de la inteligencia temprana y el aumento de la heredabilidad de 'g' con la edad.

El Modelo de Red Unificado: Integrando Explicaciones

Es probable que todas estas explicaciones (factor 'g', muestreo, mutualismo) jueguen algún papel en la inteligencia general. La crítica al factor g es su falta de especificidad causal. La crítica al muestreo se basa en ciertas observaciones empíricas (aunque discutidas). La crítica al mutualismo se centra en el momento en que aparece el 'positive manifold' y si siempre puede ser explicado por interacciones.

Considerando estas perspectivas, Van der Maas y colegas propusieron un modelo de red unificado que integra elementos de las tres explicaciones. En este modelo:

- El mutualismo forma el núcleo, describiendo las interacciones recíprocas entre diferentes habilidades cognitivas (nodos de la red).

- Los efectos multiplicadores (modelo de Dickens) se incorporan permitiendo que algunas de las interacciones pasen a través del ambiente (ej. una mejor habilidad lleva a más oportunidades de práctica, lo que mejora aún más la habilidad). Esto explica la interacción gen-ambiente y efectos como el Flynn (aumento generacional del CI) y el Jensen (mayor heredabilidad y carga de 'g' para tests cristalizados).

- El muestreo se incluye a nivel de la medición, asumiendo que los tests manifiestos no miden una única habilidad, sino que 'muestrean' de múltiples habilidades de la red simultáneamente, lo que introduce otra fuente de covariación entre los tests.

- La centralidad de ciertos procesos cognitivos (ej. memoria de trabajo) se modela asumiendo que algunos nodos tienen más conexiones o conexiones más fuertes con otros nodos. Estos procesos centrales mostrarán naturalmente altas correlaciones con el factor 'g' extraído del análisis factorial.

Este modelo unificado es una "teoría formal" ('feory', no 'veory'), lo que significa que sus supuestos son explícitos y sus predicciones pueden verificarse analítica o numéricamente. Es un modelo desarrollista que opera a nivel del individuo pero explica fenómenos a nivel de grupo (diferencias individuales), integrando así las dos disciplinas de Cronbach.

Psicometría de Redes: Un Nuevo Enfoque para la Medición

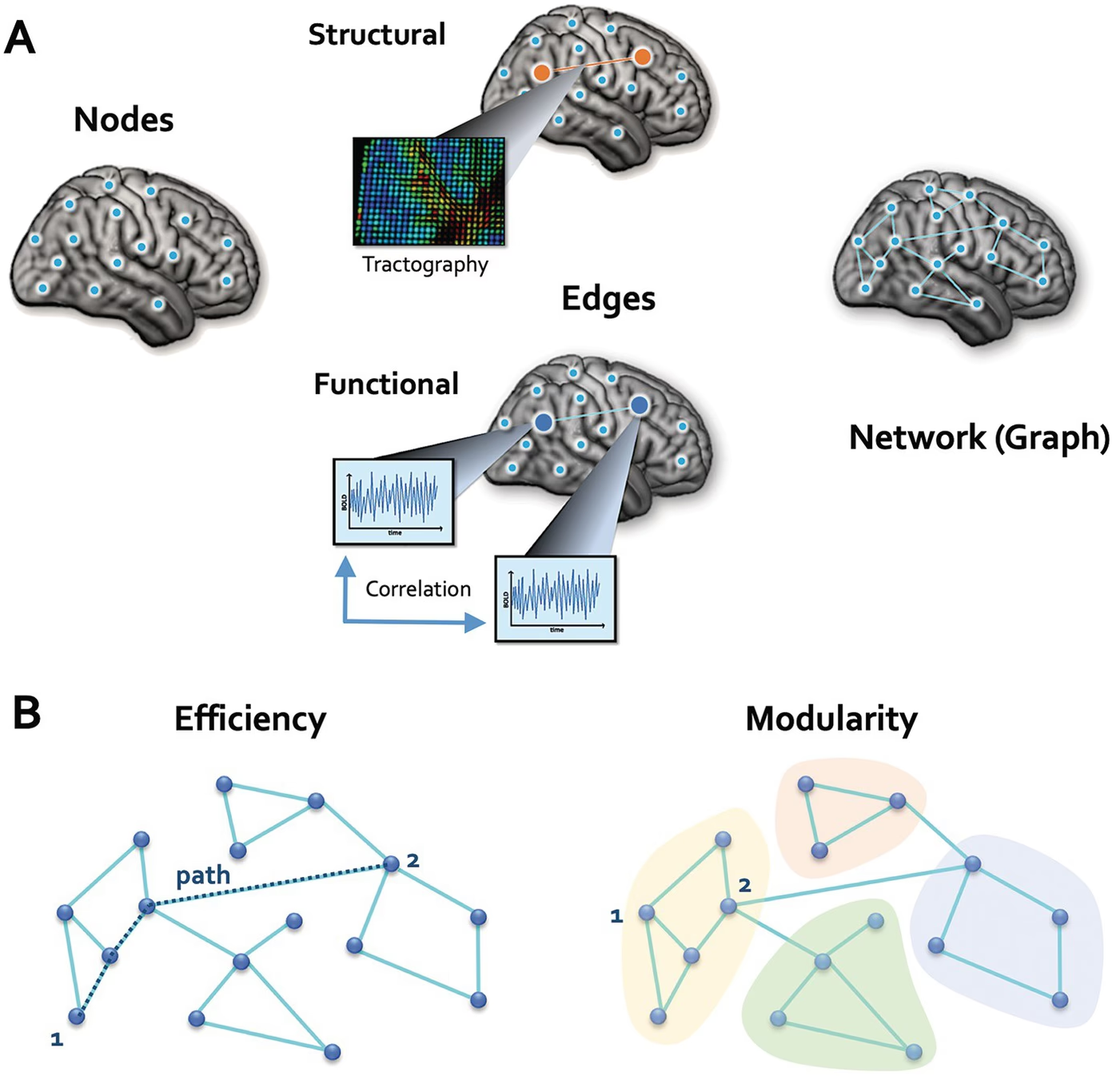

El estudio de sistemas complejos ha llevado al desarrollo de la ciencia de redes, que recientemente ha ganado popularidad en psicología, especialmente en psicología clínica y social, y ahora en inteligencia. La hipótesis central de la psicometría de redes es que los comportamientos observados (habilidades cognitivas, síntomas, actitudes) co-ocurren no por una causa común latente, sino debido a que emergen de una red de factores psicológicos y biológicos interactuantes.

Modelos como el Modelo Gráfico Gaussiano (GGM) para datos continuos o el modelo de Ising para datos binarios se utilizan para representar estas redes. Estos modelos permiten visualizar y analizar la estructura de las interacciones entre las variables observadas. Lo interesante es que se han establecido vínculos formales entre estos modelos de red y los modelos psicométricos tradicionales, como el análisis factorial y la Teoría de Respuesta al Ítem (TRI).

Esta equivalencia formal es muy importante. Permite reinterpretar modelos psicométricos establecidos desde una perspectiva de procesos individuales (la red) y ofrece nuevas técnicas de análisis. Es el puente crucial entre los modelos de mecanismos (redes) y los métodos estadísticos para analizar diferencias individuales (psicometría de redes).

Redes y Desarrollo Cognitivo: ¿Continuo o Discreto?

Una de las ideas más fascinantes que surge de la conexión entre los modelos de red y la psicometría es la capacidad de explicar por qué el desarrollo cognitivo y las diferencias individuales a veces parecen continuos (cambios graduales, variables latentes continuas como el CI) y otras veces parecen discretos (cambios abruptos, etapas, variables latentes categóricas).

Muchos modelos de red, incluyendo el modelo de Ising, exhiben transiciones de fase. Esto significa que, bajo ciertas condiciones, el sistema puede cambiar abruptamente de un estado estable a otro, de manera similar a cómo el agua cambia de líquido a gas. En psicología, esto podría manifestarse como un cambio repentino en la comprensión o la habilidad, reminiscente de las etapas piagetianas.

El modelo de Ising, utilizado originalmente para explicar el magnetismo, describe partículas binarias conectadas en una red donde las partículas con conexión positiva tienden a estar en el mismo estado. Este modelo es formalmente equivalente a una versión multivariada de la TRI logística de 2 parámetros. En esta equivalencia, un parámetro clave del modelo de Ising, la 'temperatura' (relacionada con la fuerza de las conexiones en la red), se relaciona con la discriminación del ítem en la TRI. A baja 'temperatura' (conexiones fuertes), las respuestas tienden a sincronizarse (todas correctas o todas incorrectas), llevando a una distribución bimodal de la habilidad latente, lo cual es consistente con la existencia de tipos o clases latentes. A alta 'temperatura' (conexiones débiles), las respuestas son más aleatorias, resultando en una distribución unimodal y continua de la habilidad latente.

Esto implica que la misma red de procesos psicológicos puede dar lugar a diferencias individuales que se manifiestan como un rasgo continuo o como tipos discretos, dependiendo de la fuerza de las interacciones entre los componentes de la red. El cambio entre un estado de desarrollo continuo y uno discreto no depende de un mecanismo fundamentalmente diferente, sino de un cambio en un parámetro (como la fuerza de conexión o la 'temperatura') que puede variar gradualmente.

Modelos de red más complejos pueden capturar aún mejor la naturaleza del desarrollo. Aunque el modelo unificado actual asume que todos los nodos (habilidades) están presentes desde el principio, un modelo más realista del desarrollo debería incluir la aparición de nuevos nodos (nuevos conocimientos, nuevas habilidades) y la reorganización de las conexiones existentes con el tiempo. Estos modelos dinámicos, que describen cómo los mecanismos cognitivos interactúan y evolucionan, ofrecen una poderosa lente para comprender no solo las diferencias individuales en la inteligencia, sino también su compleja trayectoria de desarrollo.

Preguntas Frecuentes sobre el Modelo de Red de la Inteligencia

Aquí respondemos algunas preguntas comunes sobre este enfoque:

- ¿Qué es exactamente el factor 'g'? Según el modelo de red, el factor g no es necesariamente una única causa subyacente en el cerebro, sino una propiedad emergente de las interacciones positivas entre las diferentes habilidades cognitivas que forman la red. Es un resumen estadístico de las correlaciones, no una entidad causal per se en este modelo.

- ¿Cómo difiere el modelo de red del modelo de factor 'g'? Mientras que el modelo de factor g describe las diferencias individuales en términos de un factor latente (descriptivo), el modelo de red describe la inteligencia en términos de un sistema dinámico de habilidades interconectadas que interactúan causalmente (mecanicista y desarrollista). El modelo de red busca explicar *cómo* se generan las correlaciones y *cómo* se desarrolla la inteligencia, algo que el modelo de factor g no hace.

- ¿Puede cambiar la inteligencia según el modelo de red? Sí, el modelo de red es inherentemente dinámico y desarrollista. El crecimiento y la interacción de las habilidades dentro de la red, influenciados por el ambiente (efectos multiplicadores) y la práctica, implican que la inteligencia es plástica y puede cambiar a lo largo del tiempo.

- ¿Qué papel juegan la genética y el ambiente? En el modelo unificado, la genética y el ambiente influyen en las capacidades límite de cada habilidad (nodo) y en las interacciones entre ellas (efectos multiplicadores). Esto explica cómo las influencias genéticas y ambientales se entrelazan y cómo su impacto puede cambiar con la edad.

- ¿Qué es la psicometría de redes? Es un campo que aplica conceptos y métodos de la ciencia de redes para analizar datos psicológicos. En lugar de buscar causas latentes comunes, modela las relaciones directas (interacciones) entre variables observadas (habilidades, síntomas, etc.), proporcionando una nueva forma de medir y comprender los constructos psicológicos y sus dinámicas.

En conclusión, el modelo de red de la inteligencia, especialmente en su forma unificada, representa un avance significativo. Al integrar explicaciones basadas en el mutualismo, los efectos multiplicadores, el muestreo y la centralidad de procesos, y al establecer vínculos formales con la psicometría, este enfoque ofrece una teoría coherente y mecanicista que puede cerrar la histórica brecha entre el estudio de la cognición y el de las diferencias individuales, proporcionando una visión más rica y dinámica de qué es y cómo se desarrolla la inteligencia humana.

Si quieres conocer otros artículos parecidos a La Inteligencia como Red: Un Modelo Unificado puedes visitar la categoría Neurociencia.