Cada evento sensorial desencadena una cascada de actividad a través de una amplia población de células nerviosas, distribuida tanto dentro como a través de diferentes áreas corticales. La pregunta fundamental en la neurociencia de sistemas es cómo estas neuronas colaboran para construir una representación coherente de nuestro entorno sensorial. A lo largo del tiempo, se han propuesto diversas teorías para explicar este fenómeno, y gracias a los recientes avances en las técnicas de registro de actividad multi-neuronal, los investigadores están comenzando a poner a prueba las predicciones de estas teorías de codificación de población.

El estudio de cómo grupos de neuronas codifican información es un campo vibrante. Se han desarrollado varios marcos conceptuales para abordar esta cuestión. Entre ellos se encuentran los vectores de población, los decodificadores lineales y la inferencia Bayesiana. Cada uno ofrece una perspectiva diferente sobre cómo la actividad colectiva de las neuronas puede ser interpretada por el resto del cerebro para guiar el comportamiento y la percepción. Aunque el concepto de vector de población fue uno de los primeros en ser explorado, particularmente en el estudio de la corteza motora, investigaciones más recientes se han centrado en la flexibilidad y el poder de otros métodos como los decodificadores lineales y la inferencia Bayesiana para explicar fenómenos complejos como la toma de decisiones perceptuales y el reconocimiento de objetos en la corteza visual.

- Más Allá del Vector de Población Simple

- Decodificadores Lineales: Descifrando la Representación Sensorial

- Inferencia Bayesiana y Códigos de Población Probabilísticos

- La Reducción de Dimensionalidad como Herramienta de Análisis

- Tabla Comparativa de Enfoques de Codificación/Decodificación

- Preguntas Frecuentes (FAQ)

Más Allá del Vector de Población Simple

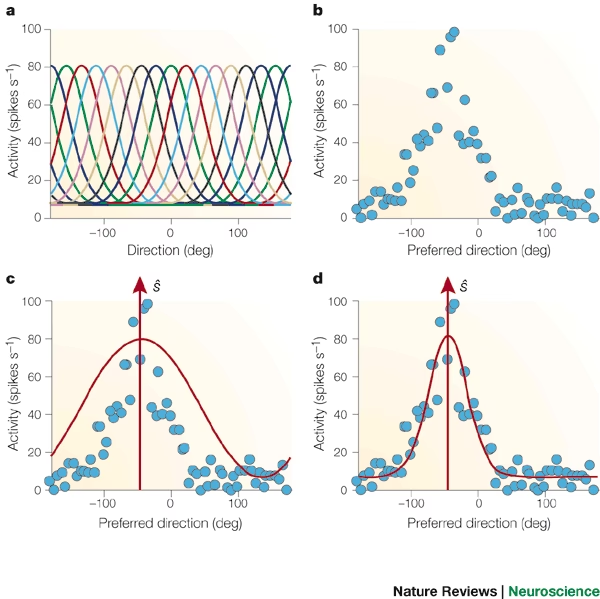

Una forma de pensar sobre cómo la actividad neuronal representa información es a través de un código de población. El concepto inicial de vector de población, aunque influyente, tiene ciertas características que lo distinguen de enfoques más modernos como el decodificador lineal. La principal diferencia radica en cómo se trata a las neuronas individuales. En un enfoque de vector de población, a menudo se asigna una 'etiqueta' a cada neurona, como su orientación preferida en la corteza visual o su dirección de movimiento preferida en la corteza motora. La representación global se construye combinando estas etiquetas ponderadas por la actividad de cada neurona.

Sin embargo, los decodificadores lineales adoptan una perspectiva diferente. No requieren que las neuronas individuales tengan una etiqueta clara o una función de sintonización simple y bien definida (como una curva en forma de campana a una variable específica del estímulo). Esta propiedad confiere a los decodificadores lineales un rango de aplicación más amplio que los vectores de población tradicionales. Por ejemplo, en áreas corticales superiores como la corteza temporal inferior (corteza IT), las neuronas responden a objetos complejos y no tienen sintonizaciones simples a características básicas como la orientación. En este contexto, asignar una 'orientación preferida' u otra etiqueta simple a cada neurona no sería útil.

Decodificadores Lineales: Descifrando la Representación Sensorial

Los decodificadores lineales ofrecen una poderosa herramienta para entender cómo la actividad de una población neuronal puede ser transformada en una decisión o una representación del estímulo. Conceptualmente, la actividad de una población de N neuronas en un momento dado puede ser vista como un punto, o un vector, en un espacio de N dimensiones. Un decodificador lineal esencialmente encuentra la mejor manera de 'proyectar' este punto desde el espacio de alta dimensión (N) a un espacio de menor dimensión que sea más relevante para la tarea en cuestión, como identificar un estímulo o tomar una decisión binaria (sí/no).

Este enfoque se ha aplicado con éxito para explorar la representación sensorial en áreas visuales de alto nivel. Por ejemplo, Gochin y colaboradores (1994) utilizaron decodificadores lineales para estudiar la actividad en la corteza IT. Registraron simultáneamente la actividad de varias neuronas mientras presentaban una variedad de imágenes de objetos reales y abstractos. Dado que las neuronas de la corteza IT no tienen las sintonizaciones simples observadas en áreas visuales más tempranas, el enfoque de decodificador lineal, que no depende de etiquetas predefinidas para las neuronas, fue particularmente adecuado. Al ajustar un decodificador lineal a los datos de respuesta neuronal, los investigadores pudieron recuperar la imagen original con una precisión significativamente superior al azar, sugiriendo que un mecanismo similar podría subyacer a la transformación de las representaciones de objetos en la corteza IT en el reconocimiento de objetos.

Una propiedad fascinante de los decodificadores lineales aplicados a las respuestas de las neuronas de la corteza IT es su similitud intrigante con nuestra experiencia diaria de reconocer objetos. Somos capaces de identificar objetos con precisión a partir de imágenes que pueden variar enormemente debido a factores como la posición del objeto en el campo visual, el tamaño o la iluminación. Nuestro sistema visual parece aprender la asociación entre un objeto y ciertas imágenes, y luego generalizar esta asociación a nuevas imágenes nunca antes vistas. De manera similar a esta habilidad humana, se ha demostrado que un decodificador lineal ajustado a las respuestas de las neuronas de la corteza IT puede recuperar con éxito la categoría y la identidad de un objeto incluso después de que la imagen haya sido alterada por traslación o expansión (Hung et al., 2005). Esto refuerza la idea de que un mecanismo similar a un decodificador lineal podría ser fundamental para la transformación de la representación del objeto por las neuronas de la corteza IT en el acto de reconocimiento de objetos.

Inferencia Bayesiana y Códigos de Población Probabilísticos

La toma de decisiones perceptuales está inherentemente ligada a la incertidumbre. A menudo, nos enfrentamos a múltiples opciones potencialmente correctas sin conocer la verdad absoluta. En estas situaciones, el cerebro debe utilizar la información sensorial disponible para inferir la verdad de la manera más precisa posible. Este proceso de inferencia puede formalizarse utilizando los principios de la inferencia estadística, particularmente el Teorema de Bayes.

El Teorema de Bayes establece una relación precisa entre la probabilidad de un estímulo sensorial (s) y la respuesta de una población neuronal (r = {r1, r2, ..., rN}): P(s|r) = [P(r|s) * P(s)] / P(r). En este contexto, P(s|r) es la probabilidad posterior, que representa la probabilidad de que el estímulo sea 's' dada la respuesta neuronal 'r'. Esto es lo que el proceso de decisión necesita determinar para elegir el 's' con la mayor probabilidad. P(r|s) es la verosimilitud (likelihood), la probabilidad de obtener la respuesta 'r' dado que el estímulo real era 's'. P(s) es la probabilidad previa (prior), que refleja el conocimiento o las expectativas sobre el estímulo 's' antes de recibir la información sensorial. P(r) es la probabilidad marginal de la respuesta, que a menudo se omite en el cálculo porque es constante para una respuesta 'r' dada y no depende del estímulo 's', lo que lleva a la relación de proporcionalidad: P(s|r) ∝ P(r|s) * P(s).

En muchas tareas de decisión perceptual, la probabilidad previa P(s) se establece como uniforme (es decir, todas las opciones de estímulo son igualmente probables de antemano), lo que simplifica aún más la relación a P(s|r) ∝ P(r|s). Bajo esta condición, la inferencia óptima del estímulo 's' dada la respuesta 'r' se logra encontrando el 's' que maximiza la verosimilitud P(r|s). Determinar el pico de la distribución de verosimilitud se convierte así en la solución estadísticamente óptima para la inferencia.

Sorprendentemente, una inferencia estadísticamente óptima es teóricamente posible incluso con un modelo tan simple como un decodificador lineal, siempre que se cumplan ciertas condiciones sobre la variabilidad neuronal. Específicamente, si la variabilidad de las neuronas individuales sigue una distribución de Poisson (o similar) y si la variabilidad de la población neuronal es independiente entre las neuronas, entonces el logaritmo de la verosimilitud P(r|s) es una combinación lineal de la respuesta de la población r. La predicción clave es que las funciones de sintonización de cada neurona (fi(s)) determinarían los pesos óptimos para esta combinación lineal: log(P(r|s)) = Σi=1N log(fi(s)) * ri.

Una forma directa de poner a prueba esta predicción es comparar la precisión de la inferencia utilizando los pesos predichos por este modelo Bayesiano basado en las funciones de sintonización individual frente a otros decodificadores lineales donde los pesos se ajustan directamente a partir de los datos de respuesta neuronal. Un estudio reciente (Graf et al., 2011) realizó precisamente esta prueba utilizando respuestas poblacionales registradas en la corteza visual primaria (V1). Contrariamente a la predicción del modelo Bayesiano simple, encontraron que el decodificador lineal con pesos ajustados a los datos superó significativamente al modelo Bayesiano en la precisión de la inferencia de la orientación del estímulo. Mientras que el decodificador ajustado podía inferir orientaciones separadas por solo 5 grados con una precisión de aproximadamente el 85%, el modelo Bayesiano solo alcanzaba alrededor del 70% de precisión.

Los resultados de este estudio sugieren que la respuesta de la población en la corteza visual se desvía de las suposiciones simplificadoras del modelo Bayesiano básico. En particular, la variabilidad correlacionada entre las neuronas de la población parece ser un factor crucial. El decodificador lineal con pesos ajustados fue capaz de adaptarse con éxito a la estructura de correlación existente en los datos, lo que le permitió lograr una mayor precisión. Esto subraya la importancia de registrar las respuestas de la población ensayo a ensayo para capturar y utilizar estas correlaciones, ya que un simple conjunto de grabaciones pareadas en sesiones separadas no sería suficiente para ajustar adecuadamente los pesos que tengan en cuenta la estructura de correlación de la población completa. La precisión superior del decodificador lineal ajustado implica que el mecanismo cerebral de toma de decisiones podría estar teniendo en cuenta activamente las correlaciones en la actividad de la corteza visual, en lugar de basarse únicamente en las propiedades de sintonización individuales de las neuronas, para lograr el mejor rendimiento posible.

El marco Bayesiano, sin embargo, es muy general y aplicable a una amplia gama de situaciones. Por ejemplo, puede extenderse a casos donde más de una población de neuronas representa el mismo estímulo sensorial. Estas diferentes poblaciones podrían proporcionar información parcialmente redundante pero también única al mecanismo de decisión. Una propuesta (Ma et al., 2006) sugiere que la solución a cómo combinar esta información es sumar las respuestas de las neuronas correspondientes en las diferentes poblaciones. Argumentan que la respuesta resultante de la población combinada, en su conjunto, representa implícitamente la distribución de probabilidad posterior. Demostraron que esta suma es ventajosa, ya que el pico de la distribución posterior representada está más cerca de la verdad del estímulo que el pico representado por cualquiera de las dos poblaciones por separado. En este modelo, las probabilidades no se calculan explícitamente mediante un decodificador lineal, sino que la distribución de probabilidad posterior está codificada directamente en el patrón de actividad de la población. Ma y colaboradores denominaron a este esquema de codificación el "código de población probabilístico", distinguiéndolo de los modelos de decodificación lineal explícita.

Los códigos de población probabilísticos y los decodificadores lineales no son necesariamente mutuamente excluyentes. Es posible que ambos mecanismos operen en diferentes niveles o etapas del procesamiento neural involucrado en las decisiones perceptuales. El código de población probabilístico, tal como fue propuesto, aún requiere ser probado directamente con datos experimentales; una prueba rigurosa implicaría el registro simultáneo de la actividad de al menos tres poblaciones neuronales que tengan correspondencias funcionales entre sus neuronas.

La Reducción de Dimensionalidad como Herramienta de Análisis

Como se mencionó anteriormente, una de las diferencias clave entre un decodificador lineal y el vector de población es que el decodificador lineal no requiere "etiquetas" predefinidas para las neuronas. Esto le permite aplicarse a poblaciones neuronales donde las sintonizaciones individuales no son simples o claras, como en la corteza IT. En el frente de un decodificador lineal, la representación geométrica de la actividad sensorial es un punto o vector en un espacio N-dimensional, donde N es el número de neuronas. El decodificador entonces proyecta este punto a un espacio de menor dimensión. Esta reducción de dimensionalidad es un enfoque muy útil para simplificar y hacer más manejable la reconstrucción o interpretación del estímulo a partir de la actividad neuronal.

El ejemplo conceptual de un decodificador lineal proyectando puntos (respuestas) de un espacio de 2 dimensiones (un plano) a un espacio de 1 dimensión (un eje) para separar categorías (como en una tarea de clasificación binaria) ilustra claramente este concepto. La proyección reduce las dimensiones manteniendo la información crucial para la tarea (la separabilidad de las categorías).

Una técnica similar para la reducción de dimensionalidad es el Análisis de Componentes Principales (PCA). La diferencia principal entre PCA y un decodificador lineal (cuando se usa para reducción de dimensionalidad) es el criterio que utilizan para encontrar la proyección. Mientras que un decodificador lineal ajusta la proyección para maximizar la reconstrucción del estímulo o la separabilidad de categorías (dependiendo de la tarea para la que se entrene), PCA determina la proyección basándose únicamente en la distribución de la nube de puntos en el espacio N-dimensional original. PCA identifica los ejes (componentes principales) a lo largo de los cuales la variabilidad de los datos es máxima. Es decir, encuentra la proyección que mejor captura la estructura de varianza de los datos, no necesariamente la que mejor codifica la información del estímulo.

A pesar de esta diferencia, PCA es una herramienta poderosa para visualizar y analizar la dinámica de las respuestas neuronales poblacionales. Utilizando PCA, se ha demostrado que la respuesta de las neuronas de la corteza IT evoluciona en un patrón particular a lo largo del tiempo después de la presentación de un estímulo visual. Durante los primeros 50 ms de la respuesta, la nube de puntos que representa las respuestas de la población se separa principalmente por categoría (por ejemplo, caras vs. no caras) (Matsumoto et al., 2005). Todas las respuestas correspondientes a la misma categoría forman un grupo apretado de puntos, lo que indica que la población en esta fase temprana diferencia la categoría general del estímulo, pero no su identidad específica dentro de esa categoría.

Hacia los 50 ms posteriores de la respuesta, cada una de estas nubes apretadas comienza a dispersarse. Esta dispersión sugiere que la respuesta de la población ahora es capaz de diferenciar la identidad específica del estímulo (por ejemplo, la cara del individuo A vs. la del individuo B). Este retraso en la diferenciación de la identidad específica proporciona una posible explicación neuronal de por qué el reconocimiento de objetos parece ocurrir en dos etapas: primero reconocemos la categoría general del objeto (un proceso más rápido), y luego discernimos la identidad específica a partir de detalles más finos (un proceso ligeramente más lento). En la fase temprana de la respuesta, las respuestas de la población son muy similares para las diversas identidades dentro de la misma categoría, lo que hace difícil trazar límites que separen identidades individuales. Estos límites solo pueden trazarse de manera efectiva cuando la nube de puntos se separa en la fase posterior de la respuesta (Matsumoto et al., 2005).

Este ejemplo de la población de la corteza IT demuestra cuán poderosa es la reducción de dimensionalidad como herramienta para analizar la dinámica de la respuesta de la población neuronal. La reducción de dimensionalidad también ha revelado transiciones interesantes en las señales relacionadas con el movimiento en la corteza motora, que es precisamente donde el concepto de vector de población fue concebido originalmente (Churchland et al., 2012, 2010). Es probable que la aplicación de técnicas de reducción de dimensionalidad, junto con otros métodos de análisis de población, abra nuevas vías para comprender las complejas computaciones que tienen lugar en diversos circuitos corticales.

Tabla Comparativa de Enfoques de Codificación/Decodificación

Para clarificar las diferencias entre algunos de los conceptos discutidos basados en el texto:

| Concepto | Descripción General (Basado en el Texto) | Uso de Etiquetas Neuronales (Ej: Orientación Preferida) | Aplicación Principal en Texto | Manejo de Correlaciones | Objetivo Principal (En el Contexto Dado) |

|---|---|---|---|---|---|

| Vector de Población | Un tipo de código de población | Sí, requiere etiquetas | Originado en análisis de corteza motora; contrastado con decodificadores lineales en IT | No explícitamente discutido como ventaja | Representación o decodificación (implícito) |

| Decodificador Lineal | Proyecta actividad N-dimensional a menor dimensión | No requiere etiquetas | Reconocimiento de objetos en IT; Decodificación de orientación en V1; Herramienta de reducción de dimensionalidad | Puede adaptarse si se ajusta a los datos (Graf et al.) | Reconstrucción de estímulo; Clasificación; Reducción de dimensionalidad |

| Inferencia Bayesiana (Modelo simple) | Formalismo estadístico para inferencia P(s|r) | Utiliza funciones de sintonización (etiquetas implícitas) | Explicación de decisiones perceptuales | Asume independencia para simplicidad; falla con correlaciones (Graf et al.) | Inferir el estímulo más probable dada la respuesta |

| Código de Población Probabilístico | Población representa implícitamente P(s|r) | No explícitamente discutido cómo maneja etiquetas | Propuesta teórica para combinar información de múltiples poblaciones | No explícitamente discutido cómo maneja correlaciones (en el texto) | Representar la distribución de probabilidad posterior |

| Análisis de Componentes Principales (PCA) | Técnica de reducción de dimensionalidad | No requiere etiquetas | Análisis de dinámica de respuesta en IT y corteza motora | Basado en la estructura de varianza de la población (incluyendo correlaciones) | Capturar la máxima varianza en menor dimensión; Visualizar estructura de datos |

Preguntas Frecuentes (FAQ)

¿Qué es la codificación de población?

Es un concepto fundamental en neurociencia que postula que la información sobre un estímulo o una acción está representada no por la actividad de una sola neurona, sino por el patrón de actividad colectiva de un gran número de neuronas.

¿Cómo se diferencia un vector de población de un decodificador lineal según el texto?

La principal diferencia mencionada es que un vector de población a menudo requiere asignar 'etiquetas' a las neuronas (como su preferencia por una característica específica), mientras que un decodificador lineal no necesita estas etiquetas predefinidas, lo que le da una mayor flexibilidad para aplicar en áreas donde las neuronas tienen sintonizaciones complejas.

¿Qué es la inferencia Bayesiana en el contexto de la percepción?

Es un marco estadístico que describe cómo el cerebro podría combinar la información sensorial ruidosa (verosimilitud) con el conocimiento previo (probabilidad previa) para llegar a una conclusión (probabilidad posterior) sobre el estímulo o la situación en el mundo, especialmente en tareas de decisión bajo incertidumbre.

¿Por qué el modelo Bayesiano simple basado en sintonizaciones individuales falló en el estudio de Graf et al.?

El estudio encontró que un modelo Bayesiano simple que asumía independencia entre las neuronas no lograba la misma precisión que un decodificador lineal ajustado a los datos. Esto se atribuyó a la presencia de variabilidad correlacionada significativa entre las neuronas en la corteza visual, algo que el modelo Bayesiano simple no tenía en cuenta, pero a lo que el decodificador ajustado sí podía adaptarse.

¿Cómo ayuda la reducción de dimensionalidad a entender la actividad neuronal?

La reducción de dimensionalidad es una técnica que permite simplificar la visualización y el análisis de patrones complejos en la actividad de grandes poblaciones neuronales (que existen en un espacio de muchas dimensiones). Permite identificar las dimensiones más importantes o informativas en las que varía la actividad, revelando estructuras o dinámicas subyacentes, como la separación de categorías u identidades a lo largo del tiempo.

¿Qué reveló la reducción de dimensionalidad sobre el reconocimiento de objetos en la corteza IT?

Aplicando PCA, se observó que la actividad de la población de neuronas en la corteza IT primero se agrupa por categoría de objeto (en la fase temprana de la respuesta) y luego se dispersa para diferenciar identidades específicas dentro de la categoría (en la fase posterior). Esto sugiere un proceso de reconocimiento en dos etapas, primero la categoría general y luego los detalles finos.

Los avances en las técnicas de registro multi-neuronal en la última década han abierto la puerta a la verificación experimental de las teorías de códigos de población. Como hemos visto, marcos como los decodificadores lineales y la inferencia Bayesiana ofrecen poderosas explicaciones sobre cómo el cerebro procesa la información sensorial y toma decisiones. La capacidad de analizar grandes conjuntos de datos neuronales utilizando técnicas como la reducción de dimensionalidad está revelando la compleja dinámica temporal de estas representaciones. Aunque la comprensión completa aún está en desarrollo, la convergencia de nuevas teorías, herramientas analíticas y datos experimentales sugiere que estamos al alcance de desentrañar los misterios de la codificación de información en las vastas redes neuronales del cerebro.

Si quieres conocer otros artículos parecidos a Codificación de Población en Neurociencia puedes visitar la categoría Neurociencia.